本文原文链接

尼恩:LLM大模型学习圣经PDF的起源

在40岁老架构师 尼恩的读者交流群(50+)中,经常性的指导小伙伴们改造简历。

经过尼恩的改造之后,很多小伙伴拿到了一线互联网企业如得物、阿里、滴滴、极兔、有赞、希音、百度、网易、美团的面试机会,拿到了大厂机会。

然而,其中一个成功案例,是一个9年经验 网易的小伙伴,当时拿到了一个年薪近80W的大模型架构offer,逆涨50%,那是在去年2023年的 5月。

不到1年,小伙伴也在团队站稳了脚跟,成为了名副其实的大模型 应用 架构师。

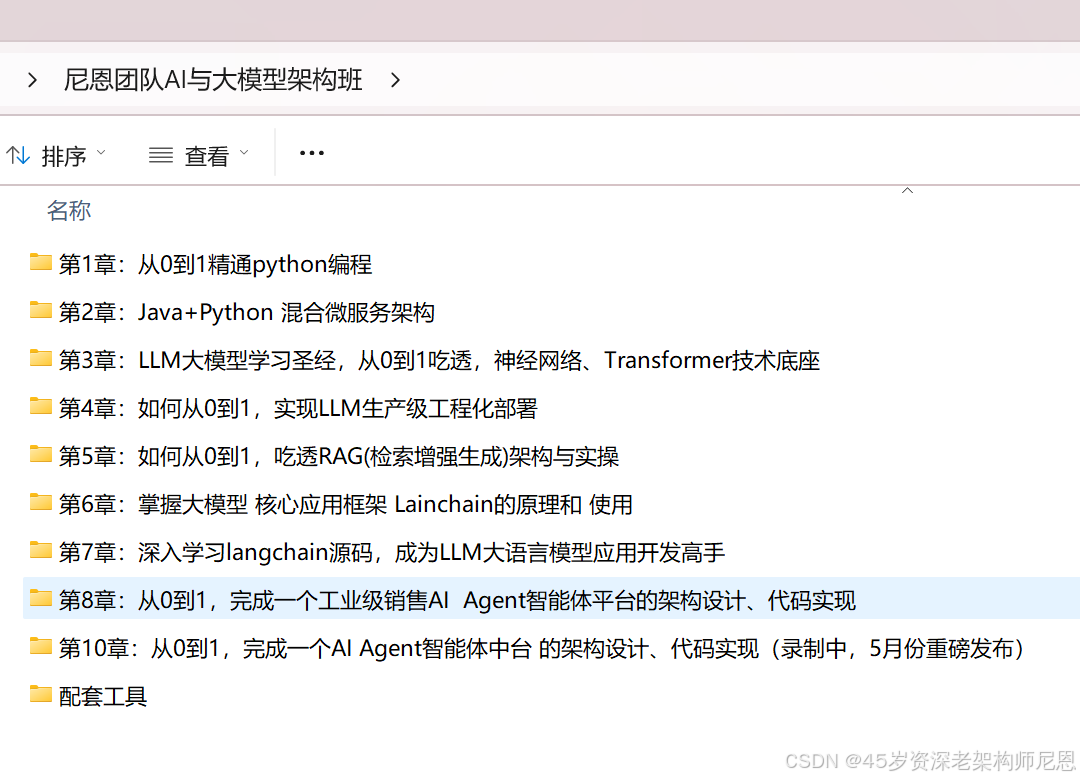

接下来,尼恩架构团队,通过 梳理一个《LLM大模型学习圣经》 帮助更多的人做LLM架构,拿到年薪100W, 这个内容体系包括下面的内容:

-

《LLM大模型学习圣经:从0到1精通RAG架构,基于LLM+RAG构建生产级企业知识库》

-

《LLM大模型学习圣经:从0到1吃透大模型的顶级架构》

-

《LLM 智能体 学习圣经:从0到1吃透 LLM 智能体 的架构 与实操》

-

《LLM 智能体 学习圣经:从0到1吃透 LLM 智能体 的 中台 架构 与实操》

以上学习圣经 的 配套视频, 2025年 5月份之前发布。

1 火爆天际的 DeepSeek 与 模型蒸馏技术

最近大火的深度求索DeepSeek-V3模型仅用557万美元的训练费用,就达到了顶尖模型的效果。

国外独立评测机构Artificial Analysis在测试后声称,DeepSeek-V3超越了迄今为止所有开源模型。

DeepSeek-V3的训练仅使用2048个H800 GPU,总训练GPU卡时为2788千小时(其中预训练为2664千小时)。

与之相对比,根据黄仁勋在GTC2024上的演讲内容,GPT-4 MoE使用8000个H100训练了90天,合计约为17280千卡时,相当于DeepSeek-V3的6.2倍。

DeepSeek-V3训练提效的原因主要包括:低精度计算、小参数量和高质量数据等。

据DeepSeek-V3的技术文档,该模型使用蒸馏技术(Distillation)生成的高质量数据提升了训练效率。

模型蒸馏是一种知识迁移技术,其核心在于将一个大规模、预训练的教师模型(Teacher Model)所蕴含的知识传递给一个规模较小的学生模型(Student Model)。

其目标是打造一个在性能上与大型模型相近,但计算资源消耗大幅降低的紧凑模型,恰似把一部厚重的百科全书浓缩成一本轻便实用的口袋指南,在精简的同时确保关键信息不流失

火爆天际的 DeepSeek团队发布的DeepSeek-R1,其670B参数的大模型通过强化学习与蒸馏技术,成功将能力迁移至7B参数的轻量模型DeepSeek-R1-7B中,各方面超越了非推理模型如 GPT-4o-0513。

DeepSeek-R1-14B 在所有评估指标上超过了 QwQ-32BPreview,而 DeepSeek-R1-32B 和 DeepSeek-R1-70B 在大多数基准测试中显著超过了 o1-mini。

在人工智能领域,大型语言模型(如GPT-4、DeepSeek-R1)凭借数千亿级参数,展现出卓越的推理与生成能力。然而,其庞大的计算需求与高昂的部署成本,严重限制了其在移动设备、边缘计算等场景的应用

对于大多数实际应用案例来说,特定任务中性能最好的模型往往过于庞大、缓慢或昂贵,但它们具有优秀的性能,这来自于它们的规模和在大量训练数据上进行预训练的能力。

相反,小型模型虽然速度更快、计算要求更低,但在准确性、精细度和知识容量方面却不及参数更多的大型模型

DeepSeek 蒸馏后的模型超越同规模传统模型,甚至接近OpenAI的顶尖小模型OpenAI-o1-mini。

这些结果展示了蒸馏的强大潜力。知识蒸馏已经成为一种重要的技术手段

下面45岁老架构师,由浅入深 带大家了解一下 知识蒸馏的 底层原理。当然,这个需要大家具备 神经网络和 Transform架构的基础知识, 如果不了解,请大家看看尼恩的介绍视频。

《 由浅入深,帮大家从0到1,彻底的理解 神经网络和 Transform架构的基础知识》

另外,尼恩架构团队的顶级 AI 架构视频, 已经基本录制完成,即将 全面发布,

这个版本的视频, 为大家 打造一个 从资深架构视角 讲的 大语言 模型 架构视频, 而不是 算法视角 的LLM视频。

2 什么是知识蒸馏?

知识蒸馏是一种机器学习技术,目的是将预先训练好的大型模型(即 “教师模型”)的学习成果转移到较小的 "学生模型 "中。

在深度学习中,它被用作模型压缩和知识转移的一种形式,尤其适用于大规模深度神经网络。

知识蒸馏的本质是知识迁移,模仿教师模型的输出分布,使学生模型继承其泛化能力与推

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?