苹果公司透露了他们通过深度学习让Siri的发音更加自然的内幕。

\\iPhone用户使用自然语言向Siri提问,Siri也通过语音回答问题。Siri可以使用21种语言回答问题,遍布全球36个国家。在2017年WWDC大会上,苹果宣布了iOS 11上的Siri将使用最新的文本语音引擎。2017年8月,苹果的机器学习期刊透露了他们是如何让Siri的发音更加自然的。

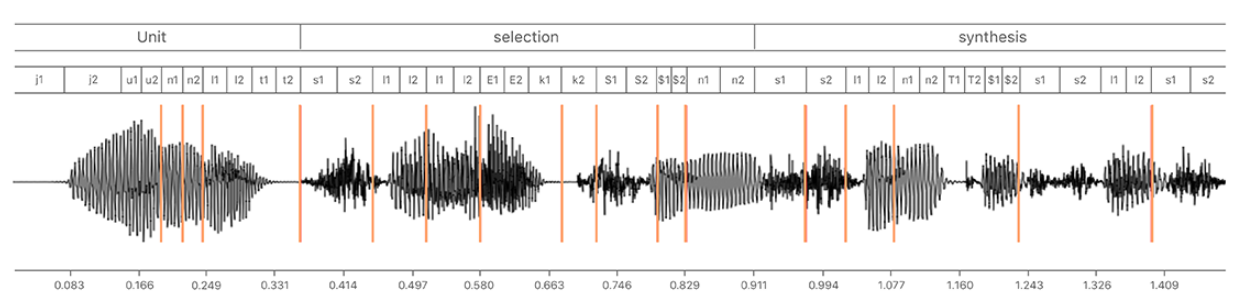

\\iPhone上的语音是通过拼接预先录制的人类语音来生成的。先录制几个小时的语音,再把它们拆分成单词,然后再把单词拆成最基本的元素:音素。在生成句子的时候,系统会选择合适的音素,再把它们拼接在一起。

\\

为音素选择合适的录音是一件很有挑战性的事情。每一个音素都要与发音相匹配,也要与相邻的其他音素相匹配。旧系统只有几种录音,音素的来源很有限,所以听起来有点不自然。于是苹果决定使用深度学习来确定声音单元在句子中的各种属性。

\\

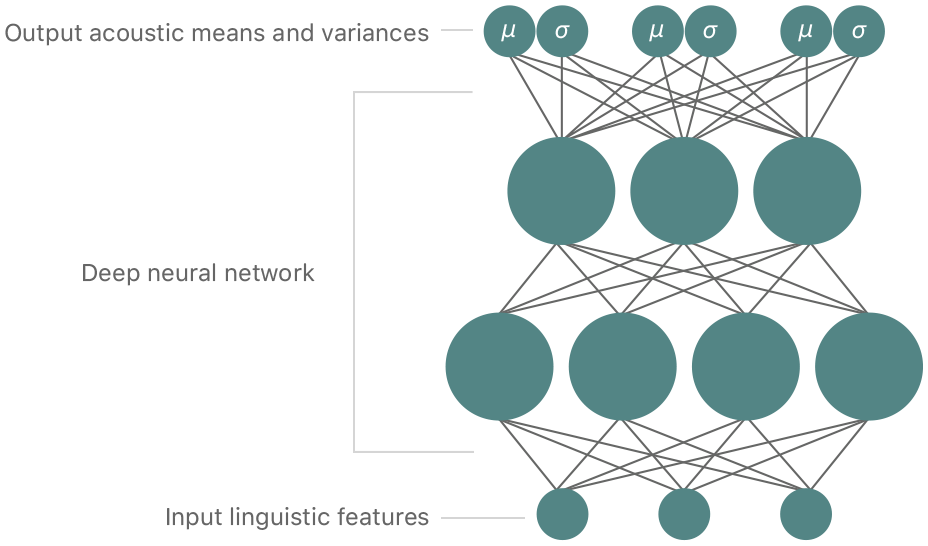

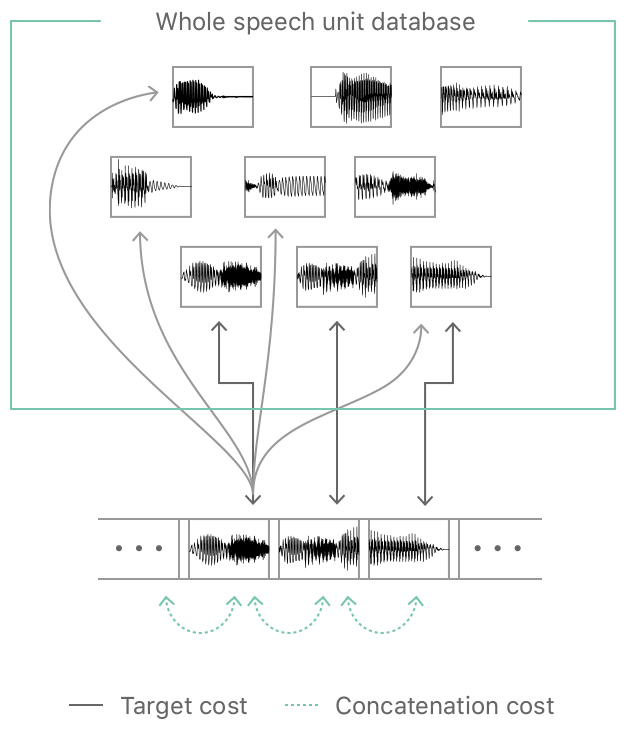

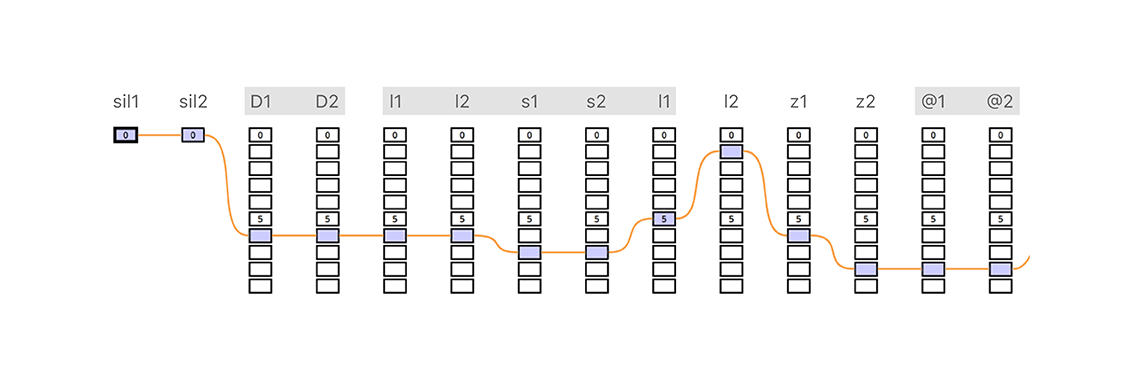

每一台iOS设备都包含了一个小型的预录音素数据库。每一份数据都包含了音频属性:声音频谱的音高和音长。一个经过训练的“深度混合密度网络(deep mixture density network)”用于预测每一个音素在句子中的特征。苹果设计了一个成本函数来训练这个网络,着重考虑到两个方面的问题:如何让音素与发音相匹配以及如何让它与句子相融合。

\\

在通过“Viterbi”算法从数据库里找到需要的数据后,系统会选出最佳的音素组合,把它们拼接起来,然后播放出声音。

\\

另一种方式是生成声波,而不是拼接预录的声音。2016年9月,Alphabets Deepmind发布了WaveNet引擎,可以基于电脑生成文本语音。它的不足是速度很慢,就算使用最快的台式电脑也需要很长时间才能完成合成任务。所以,Siri不会在短时间使用合成语音代替录制语音。

\\查看英文原文:Apple Reveals the Inner Workings of Siri's New Intonation

苹果公司采用深度学习技术改进Siri的发音效果,通过拼接预录语音的方式生成自然流畅的回答。利用深度混合密度网络预测音素特征,并通过Viterbi算法选择最佳组合。

苹果公司采用深度学习技术改进Siri的发音效果,通过拼接预录语音的方式生成自然流畅的回答。利用深度混合密度网络预测音素特征,并通过Viterbi算法选择最佳组合。

5605

5605

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?