2024 年版re:Invent刚刚在拉斯维加斯结束。正如预期的那样,人工智能是本次会议的焦点,其中 Amazon Nova 和新版本的 Sagemaker 是最重要的亮点。然而,最令社区兴奋的公告是 Amazon Aurora DSQL 的预览版,这是一种具有主动-主动高可用性的无服务器分布式 SQL 数据库。

此次会议标志着马特·加曼 (Matt Garman) 作为 AWS 首席执行官首次发表主题演讲,而现任亚马逊首席执行官安迪·贾西 (Andy Jassy) 则重返拉斯维加斯的舞台,介绍 Amazon Nova 基础模型。值得注意的是,今年的发布模式不同寻常,Werner Vogels 的主题演讲期间没有发布任何公告。

从 20 年前加入亚马逊的原因开始,沃纳转而重点讲了关于“简单性”的六堂课。他以分布式系统为中心,深入研究了时间戳及其在解决构建分布式数据库的同步挑战中的作用。同一天,维尔纳发布了他对 2025 年及以后的科技预测。 AWS 首席工程师 Rajesh Pandey评论道:

维尔纳的主题演讲确实发人深省。 “简单性”可能是我从 re:Invent 中得到的最有影响力的概念(...)他在管理复杂性的同时保持操作简单性的框架是无价的。

以下是对今年影响计算、数据库、存储、机器学习和开发的主要公告的回顾。 InfoQ 很快将作为单独的新闻报道报道这些和其他更新。

计算

Garman 强调了 Amazon ARM 处理器 Graviton 的广泛采用。他指出,Graviton 实例现在所占的 EC2 使用量比 2019 年(即五年前)的 EC2 使用总量还要多,但没有提供具体数字。然而,今年没有发布新的主要 ARM 版本,Graviton4仍然是最新版本。

Trainium2 实例专为 AI/ML 训练和推理而设计,现已普遍上市,云提供商声称 Apple、Adobe 和 Qualcomm 已经在使用它们进行训练时实现了最佳性价比。 AWS 高级客户经理 Anthony Charbonnier强调:

虽然名称暗示“只是”升级,但实际上远不止于此。每个 TRN2 芯片可提供高达 1.3 petaflop(密集 FP8)和 96GB 的 HBM3e 内存容量,并支持 2.9 TB/秒的 HBM 带宽。这是巨大的!除了 16 个 Trainium2 芯片之外,每个 Trn2 实例还具有 192 个 vCPU、2 TiB 内存和 3.2 Tbps 的 Elastic Fabric Adapter (EFA) v3。

通过与 NeuroLink 连接,EC2 Trm2 UltraServer提供多达 64 个 Tranium2 芯片和高达 83.2 FP8 petaflops。

数据库

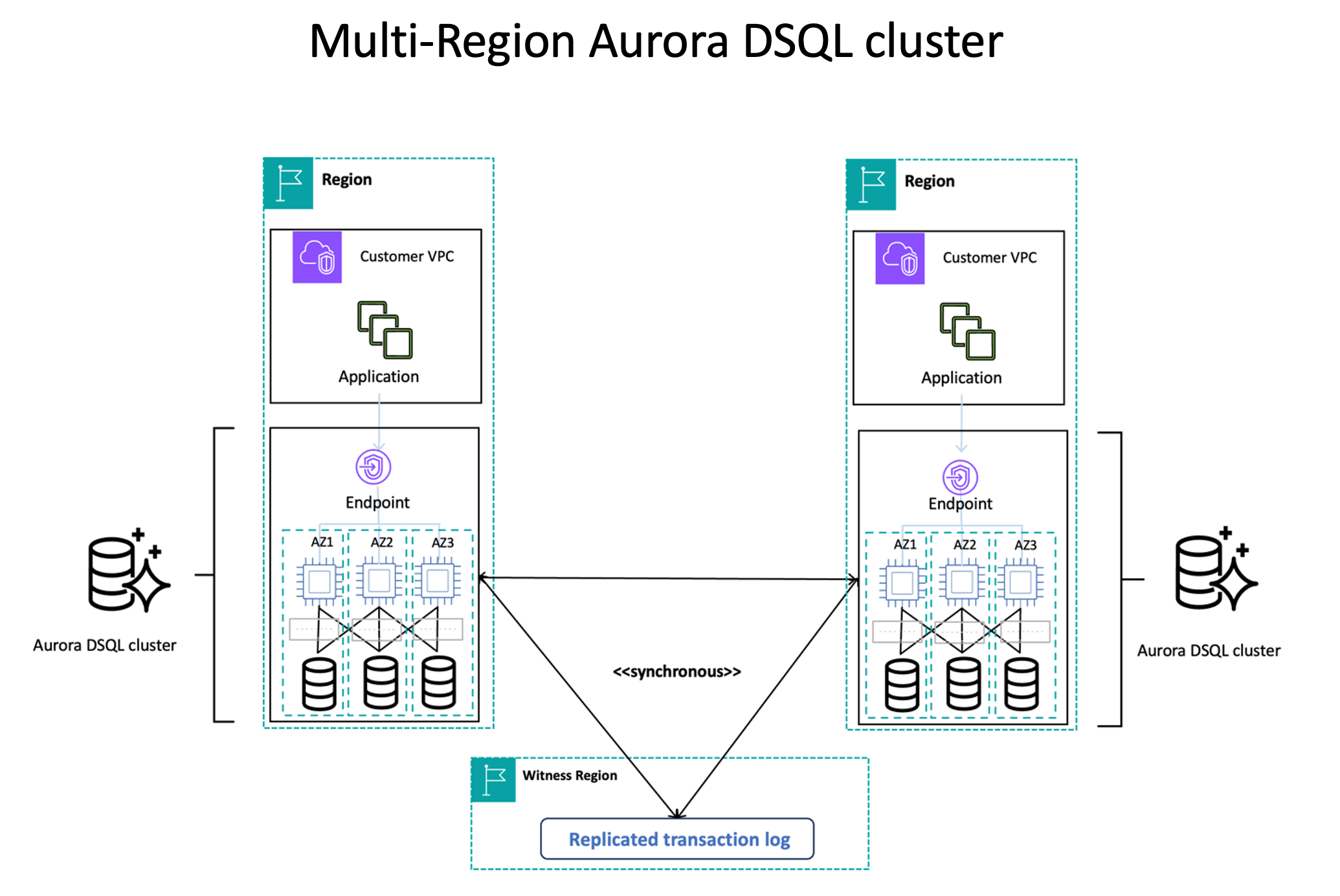

Aurora DSQL推出了无服务器分布式 SQL 数据库,声称具有无限规模、99.99% 的单区域可用性和 99.999% 的多区域双活可用性。亚马逊声称,通过将事务逻辑与存储层分离,并以强一致性处理事务,与 Google Cloud Spanner 相比,新的 PostgreSQL 兼容数据库的读写速度提高了 4 倍。

来源:AWS 博客

DataChef 和 AWS Hero 的云工程师 Rehan Van Der Merwe 总结了 DSQL与其他托管选项的比较,并写道:

Aurora DSQL 承诺提供一个可扩展到零的 OLTP 数据库,同时还具有用于强大查询的 OLAP 功能。这就像拥有一辆可以在 3 秒内从 0 加速到 60 的汽车,而且还有一个足以容纳沙发的后备箱。

并非社区中的每个人都同意。与 Aurora DSQL 类似,Dynamo DB 引入了全局表的多区域强一致性预览。MemoryDB多区域现已全面上线,提供跨区域、Valkey和Redis兼容的内存数据库。

贮存

在第一次主题演讲期间宣布新的Amazon S3 Tables 存储桶时,社区中普遍存在这样的观点:“ S3 正在成为数据湖屋吗? ”。由于 S3 中表格数据的巨大增长,事实上的开放标准 Apache Parquet 以及客户拥有数十亿个 Parquet 文件,Apache Iceberg 已成为多年来访问数据的方式。

AWS 的答案是针对分析工作负载的存储优化解决方案,声称与标准 S3 存储相比,Apache Iceberg 表的查询性能提高了 3 倍,每秒事务处理量提高了 10 倍。罗氏公司数据与分析工程经理 Rahul Chakraborty写道:

AWS S3 Tables 代表了云存储领域的重大进步,将 S3 的灵活性与 Apache Iceberg 的结构化数据管理功能融为一体。 (...) Databricks 和 Snowflake 如何应对这一新发展值得关注!

由于元数据使数据更容易被发现,Amazon S3 元数据是一个新选项,现已提供预览版,可自动更新 S3 上的对象元数据。新功能旨在管理、识别和使用 S3 数据进行业务分析和实时推理应用程序。阅读InfoQ 上的更多内容。

随着 AWS淘汰许多 Snow 便携式设备,新的AWS 数据传输终端(目前仅在洛杉矶和纽约提供)允许客户依靠具有高吞吐量连接的安全物理位置更快地上传到云。上传速度高达 400 Gbps,按小时定价。爱尔兰航空数据平台负责人 Paul Power评论道:

这是一个介于加速上传和 AWS Snowball 之间的有趣产品。我记得当实习生时,我把备份磁带带到异地的保险箱里。有些事情发生了变化,有些事情保持不变。

机器学习

机器学习和人工智能是会议的主要议题,有超过 800 场演讲。与关系数据库或分析一样,安迪·贾西 (Andy Jassy) 的愿景是,不会有任何一个法学硕士能够“统治世界”。他宣布推出 Amazon Nova,这是一组仅在 Amazon Bedrock 上提供的新基础模型,并声称“具有行业领先的性价比”。

Nova Micro、Nova Lite 和 Nova Pro 已成为通用型号,接受文本、图像或视频输入并生成文本输出。 Nova Premier 是亚马逊最强大的多模式模型,预计将于 2025 年第一季度推出。图像生成模型Nova Canvas和视频生成模型 Nova Reel 也已发布,但尚未上市。 Datasette 的创建者和 Django Web 框架的共同创建者Simon Willison完成了对新法学硕士的早期分析,写道:

试用这些型号后,我的初步印象是它们主要与 Google Gemini 系列竞争。它们非常便宜——Nova Micro 甚至比以前最便宜的型号 Gemini 1.5 Flash-8B 还要便宜——可以处理相当大的上下文,而两个较大的型号可以处理图像、视频和 PDF。 (...) 通过这个版本,我认为亚马逊可能已经在顶级模型提供商中赢得了一席之地。

Bedrock 模型蒸馏(将知识从大型复杂模型转移到较小的模型)、Bedrock 自动推理检查(防止 LLM 幻觉中的事实错误)以及Bedrock 多智能体协作是生成 AI 领域的其他重要补充。

这家云提供商推出了所谓的“下一代”Amazon SageMaker,这是一个基于云的机器学习平台,旨在将数据工程、分析和生成人工智能统一在一个具有增强功能的工作室中。此外,新的SageMaker Lakehouse集成了 S3 数据湖和 Redshift 仓库,通过开放的 Apache Iceberg API 在单个数据副本上实现统一分析和 AI/ML。

发展

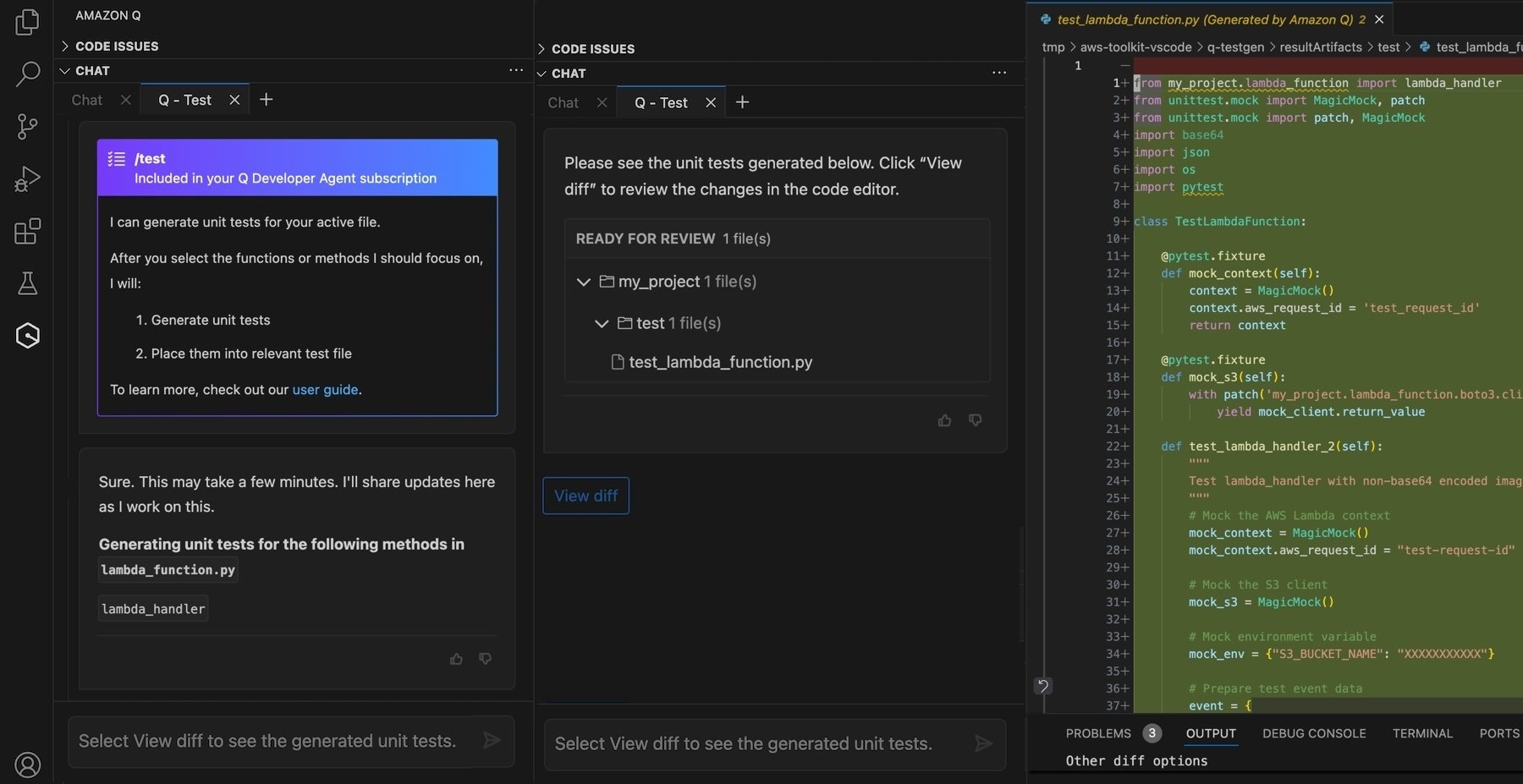

Amazon Q是一款由人工智能驱动的软件开发助手,在首次发布一年后进行了改进,其代理功能包括生成文档、代码审查和单元测试。虽然最早的功能主要以 Java 为中心,但今年的发布目标是针对 .NET、大型机和 VMware 工作负载的转换功能。

来源:AWS 博客

回顾

这个版本与过去的版本相比如何?虽然有很多令人兴奋和前景光明的新服务,但亚马逊利用主题演讲来庆祝AWS Lambda、Amazon ECS和Amazon Aurora的 10 周年。最大超大规模平台的三大支柱首次在 2014 年会议上亮相,这是一项难以比拟的壮举。

AWS 编辑团队在一篇文章中总结了AWS re:Invent 2024 中的重要公告。PostNL 的首席工程师Luc van Donkersgoed在 aws-news.com 上提供了精选的 re:Invent 源。 CyberArk 首席软件架构师 Ran Isenberg 撰写了无服务器要点总结。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?