前提知道

volatile 的数组只针对数组的引用(也不是数组元素的引用)具有 volatile 的语义,而不是它的元素”。 所以如果有其他线程对这个数组的元素进行写操作,那 么当前线程来读的时候不一定能读到最新的值。

可参考:https://blog.youkuaiyun.com/u010454030/article/details/80800098?utm_medium=distribute.pc_relevant.none-task-blog-BlogCommendFromBaidu-2.control&depth_1-utm_source=distribute.pc_relevant.none-task-blog-BlogCommendFromBaidu-2.control我也转载了它

但我的理解是ConcurrentHashMap中的table并不是用volatile修饰,所以需要getObjectVolatile

记录:n<<1 ==》n*2

n >>> 3 ==》n/8

n - (n >>> 2)==》n*3/4

sc >>> RESIZE_STAMP_SHIFT 高位到低位

rs << RESIZE_STAMP_SHIFT 低位到高位

源码分析

put 方法第一阶段 初始化数组

put 方法第二阶段 addCount

put 方法第三阶段 helpTransfer

put 方法第四阶段 不是第一个put,当链表长度大于8会变红黑树

从put(K key, V value)方法入手

public V put(K key, V value) {

return putVal(key, value, false);

}

/** Implementation for put and putIfAbsent */

final V putVal(K key, V value, boolean onlyIfAbsent) {

if (key == null || value == null) throw new NullPointerException();

//计算key的hash值

int hash = spread(key.hashCode());

//记录链表长度

int binCount = 0;

//for自旋

for (Node<K,V>[] tab = table;;) {

Node<K,V> f; int n, i, fh;

if (tab == null || (n = tab.length) == 0)

//数组为空则进行初始化

tab = initTable();

//i = (n - 1) & hash的意思是key的hash 值对应的数组下标得到第一个节点;tabAt()以

//volatile 读的方式来读取 table 数组中的元素,保证每次拿到的数据都是最新的,f-》first

else if ((f = tabAt(tab, i = (n - 1) & hash)) == null) {

/*假如在上面这段代码中存在两个线程,在不加锁的情况下:线程 A 成功执行 casTabAt 操作

后,随后的线程 B 可以通过 tabAt 方法立刻看到 table[i]的改变。原因如下:线程 A 的

casTabAt 操作,具有 volatile 读写相同的内存语义,根据 volatile 的 happens-before 规

则:线程 A 的 casTabAt 操作,一定对线程 B 的 tabAt 操作可见*/

if (casTabAt(tab, i, null,

new Node<K,V>(hash, key, value, null)))

break; // no lock when adding to empty bin

}

======================put 方法第三阶段======================

//如果对应的节点存在,判断这个节点的 hash 是不是等于 MOVED(-1),说明当前节点是

ForwardingNode 节点,意味着有其他线程正在进行扩容,那么当前现在直接帮助它进行扩容,因此调用 helpTransfer方法

else if ((fh = f.hash) == MOVED)

tab = helpTransfer(tab, f);

==========================put 方法第四阶段======================

else {//进入到这个分支,说明 f 是当前 nodes 数组对应位置节点的头节点,并且不为空

V oldVal = null;

synchronized (f) {

if (tabAt(tab, i) == f) {//给对应的头结点加锁

if (fh >= 0) {//头结点的 hash 值大于 0,说明是链表

binCount = 1; //用来记录链表的长度

for (Node<K,V> e = f;; ++binCount) {//遍历链表

K ek;

//如果发现相同的 key,则判断是否需要进行值的覆盖

if (e.hash == hash &&

((ek = e.key) == key ||

(ek != null && key.equals(ek)))) {

oldVal = e.val;

if (!onlyIfAbsent)//默认情况下,直接覆盖旧的值

e.val = value;

break;

}

//一直遍历到链表的最末端,直接把新的值加入到链表的最后面

Node<K,V> pred = e;

if ((e = e.next) == null) {

pred.next = new Node<K,V>(hash, key,

value, null);

break;

}

}

}

//如果当前的 f 节点是一颗红黑树

else if (f instanceof TreeBin) {

Node<K,V> p;

binCount = 2;

//则调用红黑树的插入方法插入新的值

if ((p = ((TreeBin<K,V>)f).putTreeVal(hash, key,

value)) != null) {

oldVal = p.val;//同样,如果值已经存在,则直接替换

if (!onlyIfAbsent)

p.val = value;

}

}

}

}

/*判断链表的长度是否已经达到临界值 8. 如果达到了临界值,这个时候会根据当前数组的长度

来决定是扩容还是将链表转化为红黑树。也就是说如果当前数组的长度小于 64,就会先扩容。

否则,会把当前链表转化为红黑树*/

if (binCount != 0) {//说明上面在做链表操作

if (binCount >= TREEIFY_THRESHOLD)//如果链表长度已经达到临界值 8 就需要把链表转换为树结构

treeifyBin(tab, i);

if (oldVal != null)//如果 val 是被替换的,则返回替换之前的值

return oldVal;

break;

}

}

}

addCount(1L, binCount);

return null;

}====================================put 方法第三阶段 helpTransfer======================

去协助扩容

如果对应的节点存在,判断这个节点的 hash 是不是等于 MOVED(-1),说明当前节点是 ForwardingNode 节点, 意味着有其他线程正在进行扩容,那么当前现在直接帮助它进行扩容,因此调用 helpTransfer 方法

/**

* Helps transfer if a resize is in progress.

*/

final Node<K,V>[] helpTransfer(Node<K,V>[] tab, Node<K,V> f) {

Node<K,V>[] nextTab; int sc;

// 判断此时是否仍然在执行扩容,nextTab=null 的时候说明扩容已经结束了

if (tab != null && (f instanceof ForwardingNode) &&

(nextTab = ((ForwardingNode<K,V>)f).nextTable) != null) {

int rs = resizeStamp(tab.length);//生成扩容戳

while (nextTab == nextTable && table == tab &&

(sc = sizeCtl) < 0) {//说明扩容还未完成的情况下不断循环来尝试将当前

线程加入到扩容操作中

//下面部分的整个代码表示扩容结束,直接退出循环

//transferIndex<=0 表示所有的 Node 都已经分配了线程

//sc=rs+MAX_RESIZERS 表示扩容线程数达到最大扩容线程数

//sc >>> RESIZE_STAMP_SHIFT !=rs, 如果在同一轮扩容中,那么 sc 无符号

右移比较高位和 rs 的值,那么应该是相等的。如果不相等,说明扩容结束了

//sc==rs+1 表示扩容结束

if ((sc >>> RESIZE_STAMP_SHIFT) != rs || sc == rs + 1 ||

sc == rs + MAX_RESIZERS || transferIndex <= 0)

break;//跳出循环

if (U.compareAndSwapInt(this, SIZECTL, sc, sc + 1)) {//在低 16 位

上增加扩容线程数

transfer(tab, nextTab);//帮助扩容

break;

}

}

return nextTab;//返回新的数组

}

return table;

}====================================put 方法第三阶段 helpTransfer======================

===================================put 方法第四阶段=================================

treeifyBin在 putVal 的最后部分,有一个判断,如果链表长度大于 8,那么就会触发扩容或者红黑树的 转化操作

/**

* Replaces all linked nodes in bin at given index unless table is

* too small, in which case resizes instead.

*/

private final void treeifyBin(Node<K,V>[] tab, int index) {

Node<K,V> b; int n, sc;

if (tab != null) {

if ((n = tab.length) < MIN_TREEIFY_CAPACITY)//tab 的长度是不是小于 64,

如果是,则执行扩容

tryPresize(n << 1);

else if ((b = tabAt(tab, index)) != null && b.hash >= 0) {//否则,将

当前链表转化为红黑树结构存储

synchronized (b) {// 将链表转换成红黑树

if (tabAt(tab, index) == b) {

TreeNode<K,V> hd = null, tl = null;

for (Node<K,V> e = b; e != null; e = e.next) {

TreeNode<K,V> p =

new TreeNode<K,V>(e.hash, e.key, e.val,

null, null);

if ((p.prev = tl) == null)

hd = p;

else

tl.next = p;

tl = p;

}

setTabAt(tab, index, new TreeBin<K,V>(hd));

}

}

}

}

}tryPresize

/**

* Tries to presize table to accommodate the given number of elements.

*

* @param size number of elements (doesn't need to be perfectly accurate)

*/

private final void tryPresize(int size) {

//对 size 进 行修复 ,主 要目 的是防 止传 入的 值不是 一个 2 次幂的 整数 ,然后通过tableSizeFor 来将入参转化为离该整数最近的 2 次幂

int c = (size >= (MAXIMUM_CAPACITY >>> 1)) ? MAXIMUM_CAPACITY :

tableSizeFor(size + (size >>> 1) + 1);

int sc;

while ((sc = sizeCtl) >= 0) {

Node<K,V>[] tab = table; int n;

//下面这段代码和 initTable 是一样的,如果 table 没有初始化,则开始初始化

if (tab == null || (n = tab.length) == 0) {

n = (sc > c) ? sc : c;

if (U.compareAndSwapInt(this, SIZECTL, sc, -1)) {

try {

if (table == tab) {{//这段代码和 addCount 后部分代码是一样的,做辅助扩容操作

@SuppressWarnings("unchecked")

Node<K,V>[] nt = (Node<K,V>[])new Node<?,?>[n];

table = nt;

sc = n - (n >>> 2);

}

} finally {

sizeCtl = sc;

}

}

}

else if (c <= sc || n >= MAXIMUM_CAPACITY)

break;

else if (tab == table) {

int rs = resizeStamp(n);

if (sc < 0) {

Node<K,V>[] nt;

if ((sc >>> RESIZE_STAMP_SHIFT) != rs || sc == rs + 1 ||

sc == rs + MAX_RESIZERS || (nt = nextTable) == null ||

transferIndex <= 0)

break;

if (U.compareAndSwapInt(this, SIZECTL, sc, sc + 1))

transfer(tab, nt);

}

else if (U.compareAndSwapInt(this, SIZECTL, sc,

(rs << RESIZE_STAMP_SHIFT) + 2))

transfer(tab, null);

}

}

}===================================put 方法第四阶段=================================

initTable

初始化数组

sizeCtl

-1 代表正在初始化

-N 代表有 N-1 有二个线程正在进行扩容操作,这里不是简单的理解成 n 个线程,sizeCtl 就 是-N,这块后续在讲扩容的时候会说明

0 标识 Node 数组还没有被初始化,

正数代表初始化或者下一次扩容的大小

private final Node<K,V>[] initTable() {

Node<K,V>[] tab; int sc;

while ((tab = table) == null || tab.length == 0) {、

if ((sc = sizeCtl) < 0)

//sizeCTl < 0 即-1 ,其他线程抢占了初始化,直接让出时间片

Thread.yield(); // lost initialization race; just spin

//通过 cas 操作,将 sizeCtl 替换为-1,标识当前线程抢占到了初始化资格

else if (U.compareAndSwapInt(this, SIZECTL, sc, -1)) {

try {

if ((tab = table) == null || tab.length == 0) {

//初始化数组,长度为 16,或者初始化在构造 ConcurrentHashMap 的时候传入的长度

int n = (sc > 0) ? sc : DEFAULT_CAPACITY;

@SuppressWarnings("unchecked")

Node<K,V>[] nt = (Node<K,V>[])new Node<?,?>[n];

//将这个node数组赋值给 table

table = tab = nt;

//计算下次扩容的大小,实际就是当前容量的 0.75倍,这里使用了右移来计算

sc = n - (n >>> 2);

}

} finally {

//设置 sizeCtl 为 sc, 如果默认是 16 的话,那么这个时候sc=16*0.75=12

sizeCtl = sc;

}

break;

}

}

return tab;

}tabAt();虽然 table 数组本身是增加了 volatile 属性,但是“volatile 的数组只针对数组的引用具有 volatile 的语义,而不是它的元素”。 所以如果有其他线程对这个数组的元素进行写操作,那 么当前线程来读的时候不一定能读到最新的值。

//U-》sun.misc.Unsafe

static final <K,V> Node<K,V> tabAt(Node<K,V>[] tab, int i) {

return (Node<K,V>)U.getObjectVolatile(tab, ((long)i << ASHIFT) + ABASE);

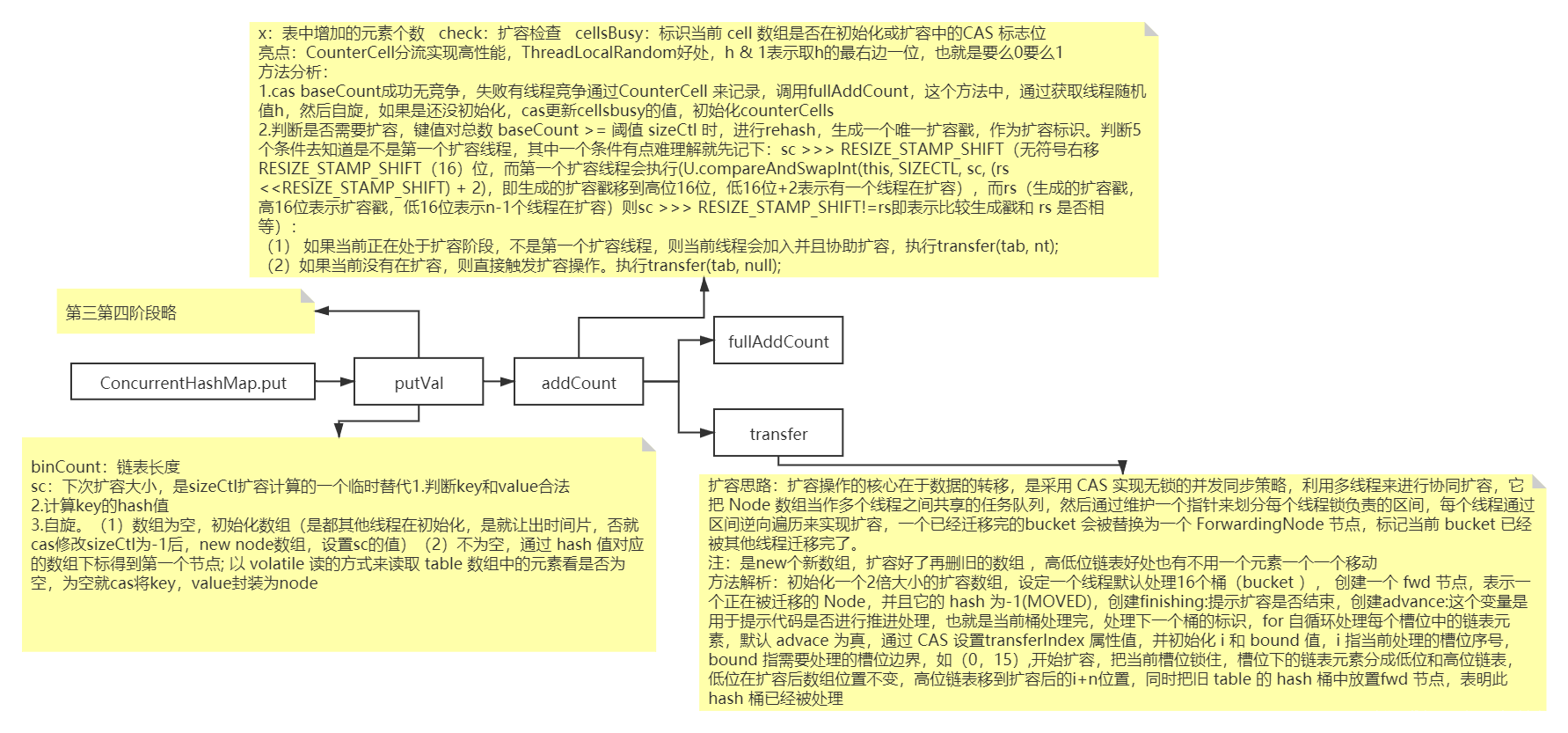

}addCount(1L, binCount); 1L-》x,binCount-》check

通过addCount来增加ConcurrentHashMap中的元素个数, 并且还会可能触发扩容操作

1. 高并发下的扩容(键值对总数 baseCount >= 阈值 sizeCtl 时,进行 rehash)

2. 如何保证 addCount 的数据安全性以及性能(CounterCell [] 数组 分流)

放入第一个元素时binCount=0,x 表示这次需要在表中增加的元素个数,check 参数表示是否需要进行扩容检查,大于等于 0 都需要进行检查

CounterCell [] 数组很关键,是分流的体现

private transient volatile int cellsBusy; // 标识当前 cell 数组是否在初始化或扩容中的

CAS 标志位

/**

* Table of counter cells. When non-null, size is a power of 2.

*/

private transient volatile CounterCell[] counterCells; // counterCells 数组,总数

值的分值分别存在每个 cell 中@ sun.misc.Contended static final class CounterCell

{

volatile long value;

CounterCell(long x)

{

value = x;

}

}

//看到这段代码就能够明白了,CounterCell 数组的每个元素,都存储一个元素个数,而实际我们调用

size 方法就是通过这个循环累加来得到的

//又是一个设计精华,大家可以借鉴; 有了这个前提,再会过去看 addCount 这个方法,就容易理解一些

了

final long sumCount()

{

CounterCell[] as = counterCells;

CounterCell a;

long sum = baseCount;

if(as != null)

{

for(int i = 0; i < as.length; ++i)

{

if((a = as[i]) != null) sum += a.value;

}

}

return sum;

}问:为什么需要if (as == null || (m = as.length - 1) < 0 || (a = as[ThreadLocalRandom.getProbe() & m]) == null || !(uncontended = U.compareAndSwapLong(a, CELLVALUE, v = a.value, v + x)))这三个判断,随机取数组中的元素和修改这个元素有什么意义

private final void addCount(long x, int check) {

CounterCell[] as; long b, s;

/*判断 counterCells 是否为空,

1. 如果为空,就通过 cas 操作尝试修改 baseCount 变量,对这个变量进行原子累加操

作(做这个操作的意义是:如果在没有竞争的情况下,仍然采用 baseCount 来记录元素个数)

2. 如果 cas 失败说明存在竞争,这个时候不能再采用 baseCount 来累加,而是通过CounterCell

来记录

*/

if ((as = counterCells) != null ||

!U.compareAndSwapLong(this, BASECOUNT, b = baseCount, s = b + x)) {

CounterCell a; long v; int m;

boolean uncontended = true; //是否冲突标识,默认为没有冲突

/*计数表为空 || 计数表 || 从计数表中随机取出一个数组的位置为空 || 通过 CAS 修

改CounterCell 随机位置的值,如果修改失败说明出现并发情况(Random 在线程并发的时候

会有性能问题以及可能会产生相同的随机数,ThreadLocalRandom.getProbe 可以解决这个

问题,并且性能要比 Random 高)*/

if (as == null || (m = as.length - 1) < 0 ||

(a = as[ThreadLocalRandom.getProbe() & m]) == null ||

!(uncontended =

U.compareAndSwapLong(a, CELLVALUE, v = a.value, v + x))) {

fullAddCount(x, uncontended);

return;

}

)//链表长度小于等于 1,不需要考虑扩容

if (check <= 1)

return;

//统计 ConcurrentHashMap 元素个数

s = sumCount();

}

if (check >= 0) { //如果 binCount>=0,标识需要检查扩容

Node<K,V>[] tab, nt; int n, sc;

//s 标识集合大小,满足以下开始扩容

//集合大小大于或等于扩容阈值(默认值的 0.75) && table 不为空 && table 的长度小于最大容量

while (s >= (long)(sc = sizeCtl) && (tab = table) != null &&

(n = tab.length) < MAXIMUM_CAPACITY) {

//生成一个唯一的扩容戳

int rs = resizeStamp(n);

if (sc < 0) {

//sc<0,也就是 sizeCtl<0,说明已经有别的线程正在扩容了

//这 5 个条件只要有一个条件为 true,说明当前线程不能帮助进行此次的扩容,

直接跳出循环

//sc >>> RESIZE_STAMP_SHIFT!=rs 表示比较高 RESIZE_STAMP_BITS 位

生成戳和 rs 是否相等,相同

//sc=rs+1 表示扩容结束

//sc==rs+MAX_RESIZERS 表示帮助线程线程已经达到最大值了

//nt=nextTable -> 表示扩容已经结束

//transferIndex<=0 表示所有的 transfer 任务都被领取完了,没有剩余的

hash 桶来给自己自己好这个线程来做 transfer

if ((sc >>> RESIZE_STAMP_SHIFT) != rs || sc == rs + 1 ||

sc == rs + MAX_RESIZERS || (nt = nextTable) == null ||

transferIndex <= 0)

break;

if (U.compareAndSwapInt(this, SIZECTL, sc, sc + 1))

transfer(tab, nt);

}

else if (U.compareAndSwapInt(this, SIZECTL, sc,

(rs << RESIZE_STAMP_SHIFT) + 2))

transfer(tab, null);

s = sumCount();

}

}

}===============================扩容戳 resizeStamp()================================

/**

* Returns the stamp bits for resizing a table of size n.

* Must be negative when shifted left by RESIZE_STAMP_SHIFT.

*/

static final int resizeStamp(int n) {

return Integer.numberOfLeadingZeros(n) | (1 << (RESIZE_STAMP_BITS - 1));

}Integer.numberOfLeadingZeros 这个方法是返回无符号整数 n 最高位非 0 位前面的 0 的个数。

比如 10 的二进制是 0000 0000 0000 0000 0000 0000 0000 1010

那么这个方法返回的值就是 28 根据 resizeStamp 的运算逻辑,我们来推演一下,

假如 n=16,那么 resizeStamp(16)=32796 转化为二进制是 [0000 0000 0000 0000 1000 0000 0001 1100]

接着再来看,当第一个线程尝试进行扩容的时候,会执行下面这段代码 U.compareAndSwapInt(this, SIZECTL, sc, (rs << RESIZE_STAMP_SHIFT) + 2)

rs 左移 16 位,相当于原本的二进制低位变成了高位 1000 0000 0001 1100 0000 0000 0000 0000

然后再+2 =1000 0000 0001 1100 0000 0000 0000 0000+10=1000 0000 0001 1100 0000 0000 0000 0010

高 16 位代表扩容的标记、低 16 位代表并行扩容的线程数

好处:

1.先在 CHM 中是支持并发扩容的,也就是说如果当前的数组需要进行扩容操作,可以 由多个线程来共同负责

2.可以保证每次扩容都生成唯一的生成戳,每次新的扩容,都有一个不同的 n,这个生成 戳就是根据 n 来计算出来的一个数字,n 不同,即扩容标记不同,这个数字也不同,

问:➢ 第一个线程尝试扩容的时候,为什么是+2

答:因为 1 表示初始化,2 表示一个线程在执行扩容,而且对 sizeCtl 的操作都是基于位运算的, 所以不会关心它本身的数值是多少,只关心它在二进制上的数值,而 sc + 1 会在 低 16 位上加 1。

===============================扩容戳================================

==============================扩容 transfer()=========================

/**

* Moves and/or copies the nodes in each bin to new table. See

* above for explanation.

*/

/*

1、fwd:这个类是个标识类,用于指向新表用的,其他线程遇到这个类会主动跳过这个类,因

为这个类要么就是扩容迁移正在进行,要么就是已经完成扩容迁移,也就是这个类要保证线

程安全,再进行操作。

2、advance:这个变量是用于提示代码是否进行推进处理,也就是当前桶处理完,处理下一个

桶的标识

3、finishing:这个变量用于提示扩容是否结束用的

*/

private final void transfer(Node<K,V>[] tab, Node<K,V>[] nextTab) {

int n = tab.length, stride;

/*将 (n>>>3 相当于 n/8) 然后除以 CPU 核心数。如果得到的结果小于 16,那么就使用 16

这里的目的是让每个 CPU 处理的桶一样多,避免出现转移任务不均匀的现象,如果桶较少的话,

默认一个 CPU(一个线程)处理 16 个桶,也就是长度为 16 的时候,扩容的时候只会有一

个线程来扩容*/

if ((stride = (NCPU > 1) ? (n >>> 3) / NCPU : n) < MIN_TRANSFER_STRIDE)

stride = MIN_TRANSFER_STRIDE; // subdivide range

//nextTab 未初始化,nextTab 是用来扩容的 node 数组

if (nextTab == null) { // initiating

try {

@SuppressWarnings("unchecked")

//新建一个 n<<1(原来2倍) 原始 table 大小的 nextTab,也就是 32

Node<K,V>[] nt = (Node<K,V>[])new Node<?,?>[n << 1];

nextTab = nt; //赋值给 nextTab

} catch (Throwable ex) { // try to cope with OOME

sizeCtl = Integer.MAX_VALUE; //扩容失败,sizeCtl 使用 int 的最大值

return;

}

nextTable = nextTab; //更新成员变量

transferIndex = n; //更新转移下标,表示转移时的下标

}

int nextn = nextTab.length; //新的 tab 的长度

/* 创建一个 fwd 节点,表示一个正在被迁移的 Node,并且它的 hash 值为-1(MOVED),也就是

前面我们在讲 putval 方法的时候,会有一个判断 MOVED 的逻辑。它的作用是用来占位,表

示原数组中位置 i 处的节点完成迁移以后,就会在 i 位置设置一个 fwd 来告诉其他线程这

个位置已经处理过了*/

ForwardingNode<K,V> fwd = new ForwardingNode<K,V>(nextTab);

/*首次推进为 true,如果等于 true,说明需要再次推进一个下标(i--),反之,如果是false,

那么就不能推进下标,需要将当前的下标处理完毕才能继续推进*/

boolean advance = true;

//判断是否已经扩容完成,完成就 return,退出循环

boolean finishing = false; // to ensure sweep before committing nextTab

/*通过 for 自循环处理每个槽位中的链表元素,默认 advace 为真,通过 CAS 设置

transferIndex 属性值,并初始化 i 和 bound 值,i 指当前处理的槽位序号,bound 指需要处

理的槽位边界,先处理槽位 15 的节点;

*/

for (int i = 0, bound = 0;;) {

/* 这个循环使用 CAS 不断尝试为当前线程分配任务,直到分配成功或任务队列已经被全部分配完

毕, 如果当前线程已经被分配过 bucket 区域, 那么会通过--i 指向下一个待处理 bucket 然

后退出该循环*/

Node<K,V> f; int fh;

while (advance) {

int nextIndex, nextBound;

//--i 表示下一个待处理的 bucket,如果它>=bound,表示当前线程已经分配过bucket 区域

if (--i >= bound || finishing)

advance = false;

//表示所有 bucket 已经被分配完毕

else if ((nextIndex = transferIndex) <= 0) {

i = -1;

advance = false;

}

//通过 cas 来修改 TRANSFERINDEX,为当前线程分配任务,处理的节点区间为

//(nextBound,nextIndex)->(0,15)

else if (U.compareAndSwapInt

(this, TRANSFERINDEX, nextIndex,

nextBound = (nextIndex > stride ?

nextIndex - stride : 0))) {

bound = nextBound;

i = nextIndex - 1;

advance = false;

}

}

===================扩容结束以后的退出机制==================================

//i<0 说明已经遍历完旧的数组,也就是当前线程已经处理完所有负责的 bucket

if (i < 0 || i >= n || i + n >= nextn) {

int sc;

if (finishing) { //如果完成了扩容

nextTable = null; //删除成员变量

table = nextTab; //更新 table 数组

sizeCtl = (n << 1) - (n >>> 1); //更新阈值(32*0.75=24)

return;

}

/* sizeCtl 在迁移前会设置为 (rs << RESIZE_STAMP_SHIFT) + 2 ,然后,每增加一

个线程参与迁移就会将 sizeCtl 加 1, 这里使用 CAS 操作对 sizeCtl 的低 16 位进

行减 1,代表做完了属于自己的任务*/

if (U.compareAndSwapInt(this, SIZECTL, sc = sizeCtl, sc - 1)) {

/*第一个扩容的线程,执行 transfer 方法之前,会设置 sizeCtl =(resizeStamp(n)

<< RESIZE_STAMP_SHIFT) + 2)后续帮其扩容的线程,执行 transfer 方法之前,会设

置 sizeCtl = sizeCtl+1 每一个退出 transfer 的方法的线程,退出之前,会设置

sizeCtl = sizeCtl-1 那么最后一个线程退出时:必然有 sc == (resizeStamp(n) <<

RESIZE_STAMP_SHIFT) + 2),即 (sc - 2) == resizeStamp(n) <<

RESIZE_STAMP_SHIFT 如果 sc - 2 不等于标识符左移 16 位。如果他们相等了,说明

没有线程在帮助他们扩容了。也就是说,扩容结束了。*/

/*每存在一个线程执行完扩容操作,就通过 cas 执行 sc-1。接着判断(sc-2)

!=resizeStamp(n) << RESIZE_STAMP_SHIFT ; 如果相等,表示当前为整个扩容操作的

最后一个线程,那么意味着整个扩容操作就结束了;如果不想等,说明还得继续这么做的

目的,一方面是防止不同扩容之间出现相同的 sizeCtl,另外一方面,还可以避免

sizeCtl 的 ABA 问题导致的扩容重叠的情况*/

if ((sc - 2) != resizeStamp(n) << RESIZE_STAMP_SHIFT)

return;

// 如果相等,扩容结束了,更新 finising 变量

finishing = advance = true;

// 再次循环检查一下整张表

i = n; // recheck before commit

}

}

// 如果位置 i 处是空的,没有任何节点,那么放入刚刚初始化的 ForwardingNode ”空节点“

else if ((f = tabAt(tab, i)) == null)

advance = casTabAt(tab, i, null, fwd);

//表示该位置已经完成了迁移,也就是如果线程 A 已经处理过这个节点,那么线程 B 处理这

//个节点时,hash 值一定为 MOVED

else if ((fh = f.hash) == MOVED)

advance = true; // already processed

else {

synchronized (f) {//对数组该节点位置加锁,开始处理数组该位置的迁移工作

if (tabAt(tab, i) == f) {//再做一次校验

Node<K,V> ln, hn;//ln 表示低位, hn 表示高位;接下来这段代码的作用是把链表拆分成两部分,0 在低位,1 在高位。实际就是 lowNode 和 HighNode,分别保存 hash 值的第 x位为 0 和不等于0 的节点

if (fh >= 0) {

int runBit = fh & n;//通过 fn&n 可以把这个链表中的元素分为两类,A 类是 hash 值的第 X 位为 0,B 类是 hash 值的第 x 位为不等于 0,最终要达到的目的是,A 类的链表保持位置不动,B 类的链表为 14+16(扩容增加的长度)=30

Node<K,V> lastRun = f;

//遍历当前 bucket 的链表,目的是尽量重用 Node 链表尾部的一部分

for (Node<K,V> p = f.next; p != null; p = p.next) {

int b = p.hash & n;

if (b != runBit) {

runBit = b;

lastRun = p;

}

}

if (runBit == 0) {//如果最后更新的 runBit 是 0,设置低位节点

ln = lastRun;

hn = null;

}

else {//否则,设置高位节点

hn = lastRun;

ln = null;

}

//构造高位以及低位的链表

for (Node<K,V> p = f; p != lastRun; p = p.next) {

int ph = p.hash; K pk = p.key; V pv = p.val;

if ((ph & n) == 0)

ln = new Node<K,V>(ph, pk, pv, ln);

else

hn = new Node<K,V>(ph, pk, pv, hn);

}

setTabAt(nextTab, i, ln);//将低位的链表放在 i 位置也就是不动

setTabAt(nextTab, i + n, hn);//将高位链表放在 i+n 位置

setTabAt(tab, i, fwd);// 把旧 table 的 hash 桶中放置转发节点,

//表明此 hash 桶已经被处理

advance = true;

}

//红黑树的扩容

else if (f instanceof TreeBin) {

TreeBin<K,V> t = (TreeBin<K,V>)f;

TreeNode<K,V> lo = null, loTail = null;

TreeNode<K,V> hi = null, hiTail = null;

int lc = 0, hc = 0;

for (Node<K,V> e = t.first; e != null; e = e.next) {

int h = e.hash;

TreeNode<K,V> p = new TreeNode<K,V>

(h, e.key, e.val, null, null);

if ((h & n) == 0) {

if ((p.prev = loTail) == null)

lo = p;

else

loTail.next = p;

loTail = p;

++lc;

}

else {

if ((p.prev = hiTail) == null)

hi = p;

else

hiTail.next = p;

hiTail = p;

++hc;

}

}

ln = (lc <= UNTREEIFY_THRESHOLD) ? untreeify(lo) :

(hc != 0) ? new TreeBin<K,V>(lo) : t;

hn = (hc <= UNTREEIFY_THRESHOLD) ? untreeify(hi) :

(lc != 0) ? new TreeBin<K,V>(hi) : t;

setTabAt(nextTab, i, ln);

setTabAt(nextTab, i + n, hn);

setTabAt(tab, i, fwd);

advance = true;

}

}

}

}

}

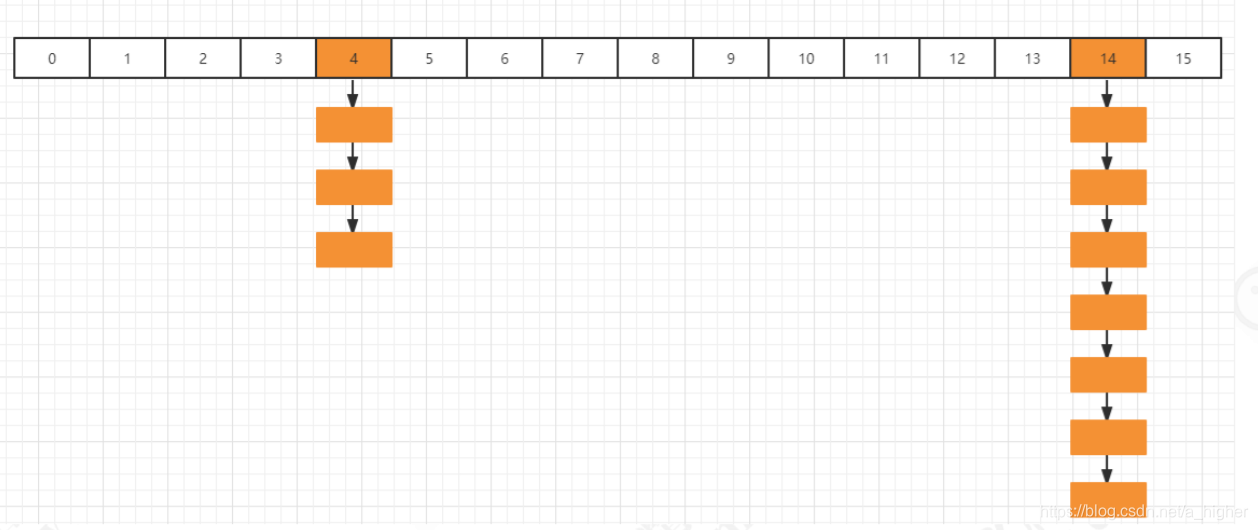

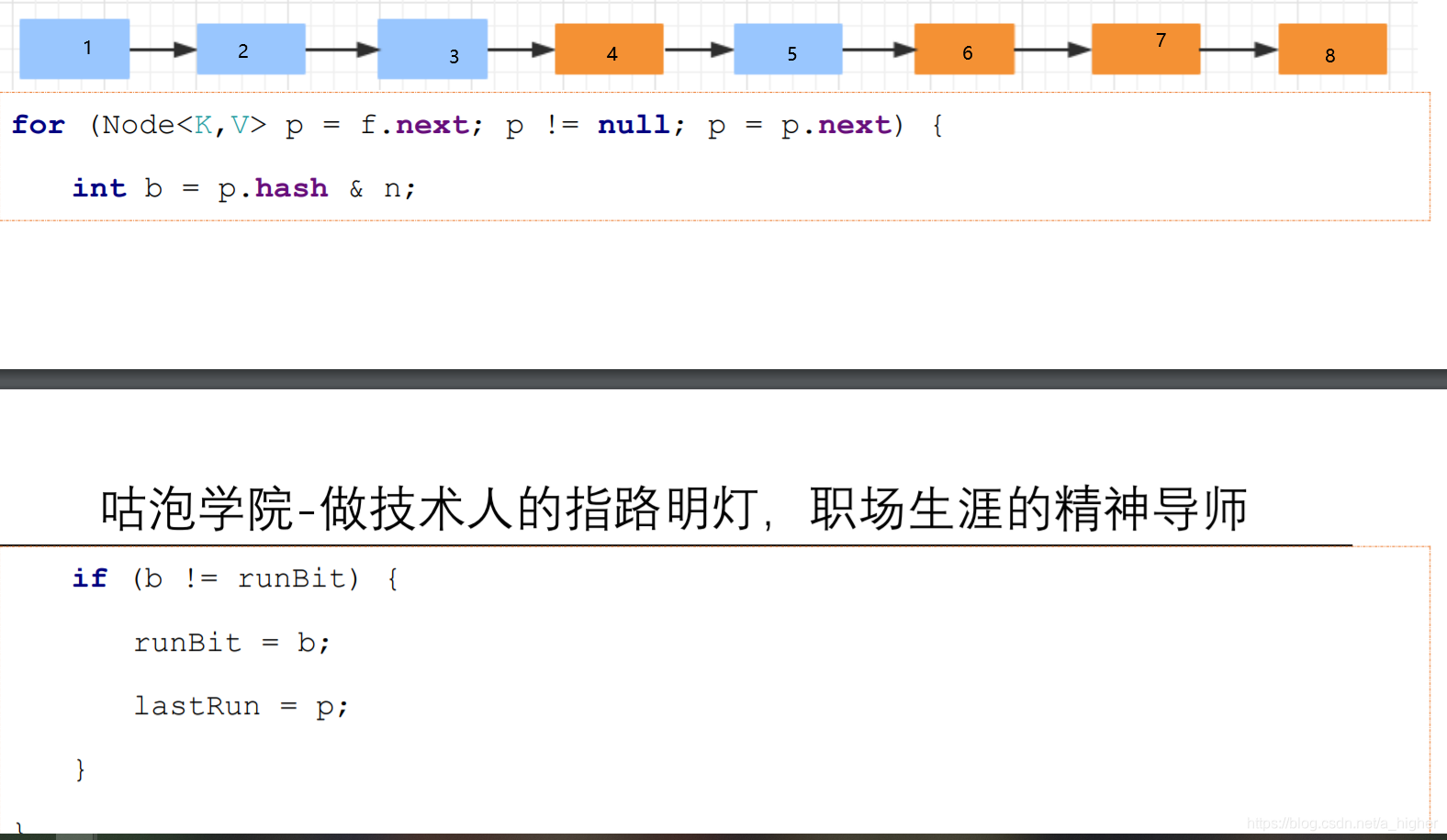

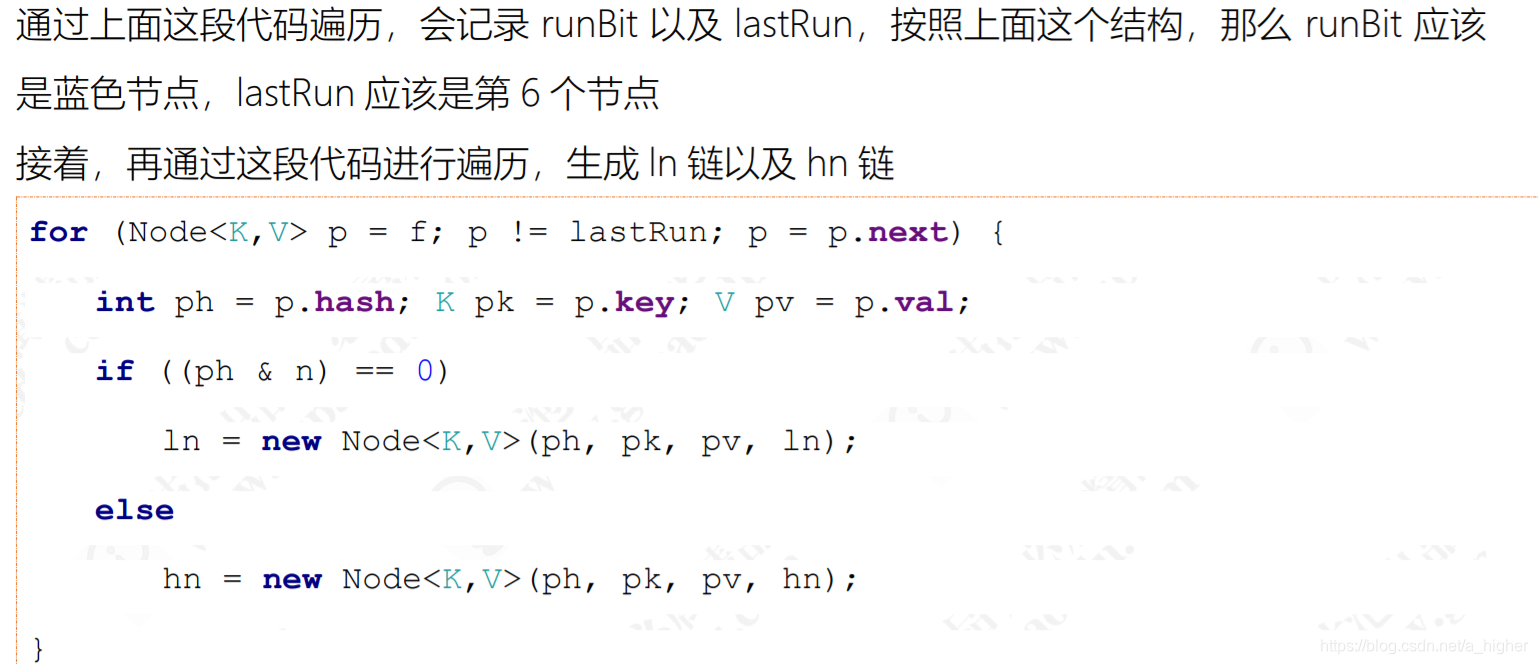

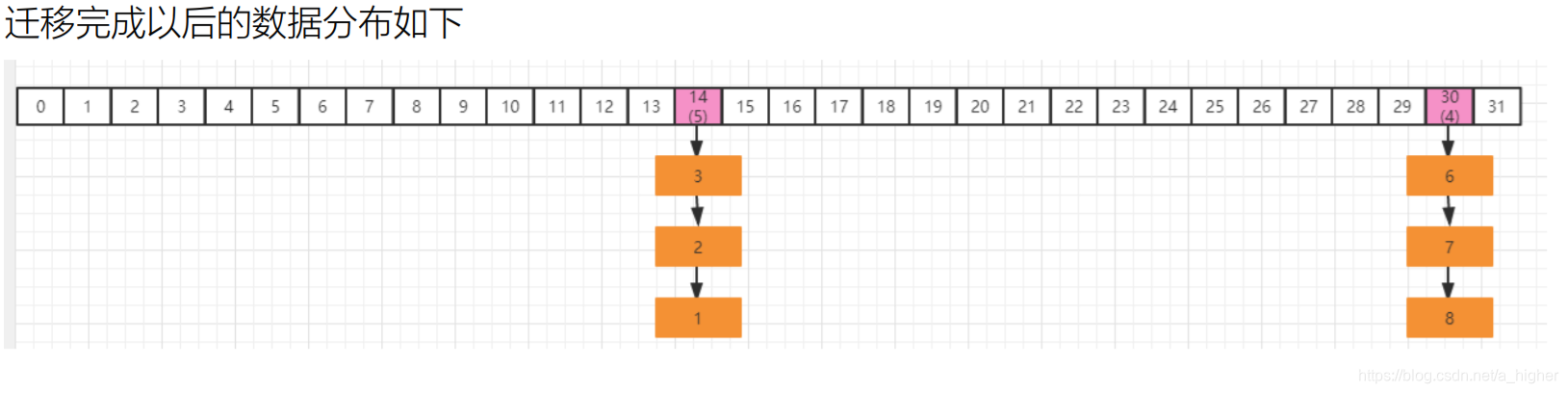

}图解:假如我们有这样一个队列

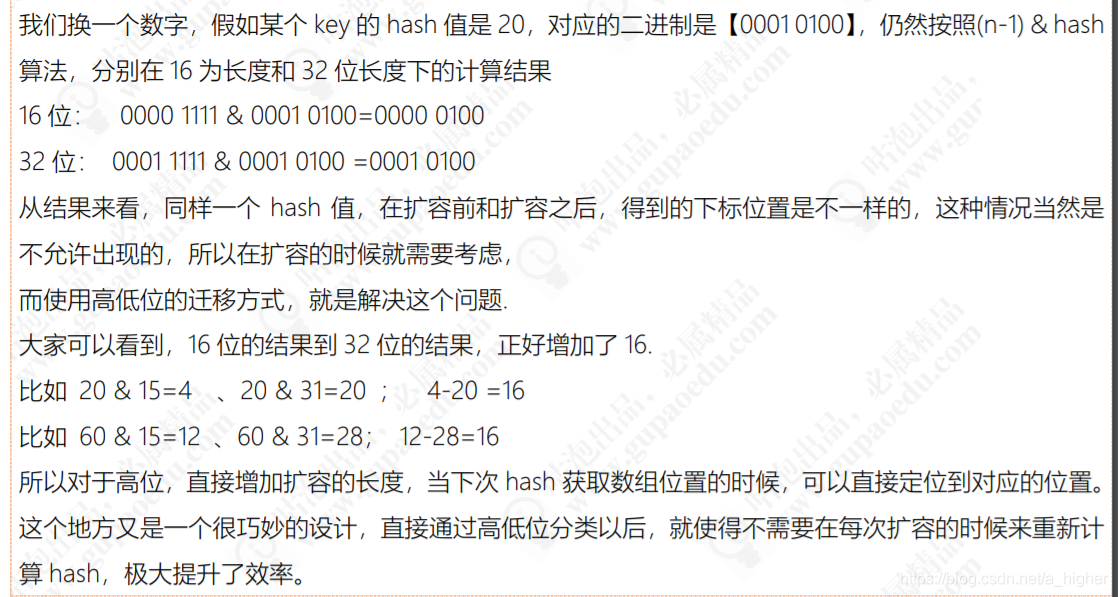

第 14 个槽位插入新节点之后,链表元素个数已经达到了 8,且数组长度为 16,优先通过扩容 来缓解链表过长的问题,扩容这块的图解稍后再分析,先分析高低位扩容的原理 假如当前线程正在处理槽位为 14 的节点,它是一个链表结构,在代码中,首先定义两个变量 节点 ln 和 hn,实际就是 lowNode 和 HighNode,分别保存 hash 值的第 x 位为 0 和不等于 0 的节点

通过 fn&n 可以把这个链表中的元素分为两类,A 类是 hash 值的第 X 位为 0,B 类是 hash 值 的第 x 位为不等于 0(至于为什么要这么区分,稍后分析),并且通过 lastRun 记录最后要处 理的节点。最终要达到的目的是,A 类的链表保持位置不动,B 类的链表为 14+16(扩容增加 的长度)=30

我们把 14 槽位的链表单独伶出来,我们用蓝色表示 fn&n=0 的节点,假如链表的分类是这 样

==============================扩容 transfer()=========================

fullAddCount()

主要是用来初始化 CounterCell,来记录元素个数,里面包含扩容,初始化等 操作

// See LongAdder version for explanation

private final void fullAddCount(long x, boolean wasUncontended) {

int h;

//获取当前线程的 probe 的值,如果值为 0,则初始化当前线程的 probe 的值,probe 就是随机数

if ((h = ThreadLocalRandom.getProbe()) == 0) {

ThreadLocalRandom.localInit(); // force initialization

h = ThreadLocalRandom.getProbe();

wasUncontended = true; ; // 由于重新生成了 probe,未冲突标志位设置为 true

}

boolean collide = false; // True if last slot nonempty

for (;;) { //自旋

CounterCell[] as; CounterCell a; int n; long v;

//说明 counterCells 已经被初始化过了

if ((as = counterCells) != null && (n = as.length) > 0) {

if ((a = as[(n - 1) & h]) == null) {

if (cellsBusy == 0) { // Try to attach new Cell

CounterCell r = new CounterCell(x); // Optimistic create

if (cellsBusy == 0 &&

U.compareAndSwapInt(this, CELLSBUSY, 0, 1)) {

boolean created = false;

try { // Recheck under lock

CounterCell[] rs; int m, j;

if ((rs = counterCells) != null &&

(m = rs.length) > 0 &&

rs[j = (m - 1) & h] == null) {

rs[j] = r;

created = true;

}

} finally {

cellsBusy = 0;

}

if (created)

break;

continue; // Slot is now non-empty

}

}

collide = false;

}

else if (!wasUncontended) // CAS already known to fail

wasUncontended = true; // Continue after rehash

else if (U.compareAndSwapLong(a, CELLVALUE, v = a.value, v + x))

break;

else if (counterCells != as || n >= NCPU)

collide = false; // At max size or stale

else if (!collide)

collide = true;

else if (cellsBusy == 0 &&

U.compareAndSwapInt(this, CELLSBUSY, 0, 1)) {

try {

if (counterCells == as) {// Expand table unless stale

CounterCell[] rs = new CounterCell[n << 1]

for (int i = 0; i < n; ++i)

rs[i] = as[i];

counterCells = rs;

}

} finally {

cellsBusy = 0;

}

collide = false;

continue; // Retry with expanded table

}

h = ThreadLocalRandom.advanceProbe(h);

}

//------------------初始化------------

//cellsBusy=0 表示没有在做初始化,通过 cas 更新 cellsbusy 的值标注当前线程正

//在做初始化操作

else if (cellsBusy == 0 && counterCells == as &&

U.compareAndSwapInt(this, CELLSBUSY, 0, 1)) {

boolean init = false;

try { // Initialize table

if (counterCells == as) {

//初始化CounterCell数量为2

CounterCell[] rs = new CounterCell[2];

//将 x 也就是元素的个数放在指定的数组下标位置,h & 1取h的最右边一位

//&"是"与运算"的意思,1&1=1,其他情况(1 & 0,0 & 1,0 & 0)都=0

//例如h是0011,h & 1得到0001,如果h是0110,h & 1得到0000.

rs[h & 1] = new CounterCell(x);

counterCells = rs; //赋值给 counterCells

init = true; ;//设置初始化完成标识

}

} finally {

cellsBusy = 0; ;//恢复标识

}

if (init)

break;

}

//竞争激烈,其它线程占据 cell 数组,直接累加在 base 变量中

else if (U.compareAndSwapLong(this, BASECOUNT, v = baseCount, v + x))

break; // Fall back on using base

}

}

小小总结

本文解析了ConcurrentHashMap的put方法中涉及的数组扩容、节点迁移以及volatile的使用,重点讲解了helpTransfer和treeifyBin方法,探讨了并发扩容策略与扩容戳的作用。

本文解析了ConcurrentHashMap的put方法中涉及的数组扩容、节点迁移以及volatile的使用,重点讲解了helpTransfer和treeifyBin方法,探讨了并发扩容策略与扩容戳的作用。

636

636

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?