非本地配置,记录一下,后面在更新

前置安装 jdk1.8 scala-2.13.8

linux 解压命令 tar -zxvf spark-3.3.2-bin-hadoop3-scala2.13.tgz

进去 conf , 复制 spark-env.sh.template 重命名 spark-env.sh

cp spark-env.sh.template spark-env.sh

修改 spark-env.sh 增加 主要配置

JAVA_HOME="/usr/local/wildfly/openjdk/openjdk-1.8.0_92"

SCALA_HOME="/usr/local/scala-2.13.8"

#绑定ip访问 保证链接都是ip 而不是主机名。

SPARK_PUBLIC_DNS=10.XXX.141.168

SPARK_MASTER_HOST=10.XXX.141.168

#保证work的端口

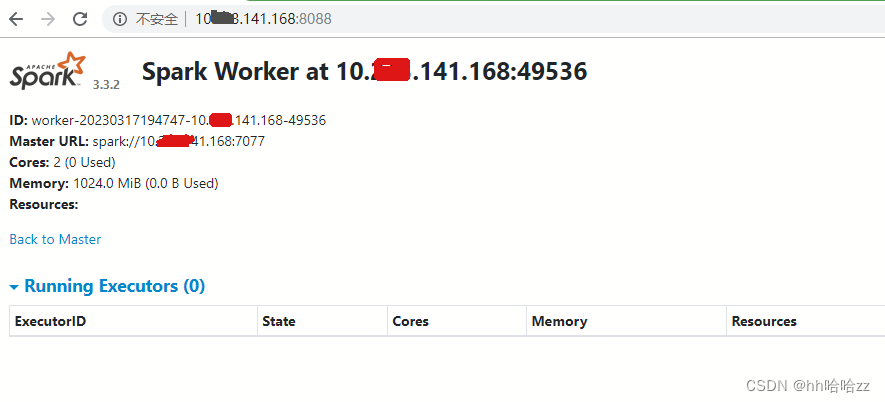

SPARK_WORKER_WEBUI_PORT=8088

SPARK_WORKER_MEMORY=1GB

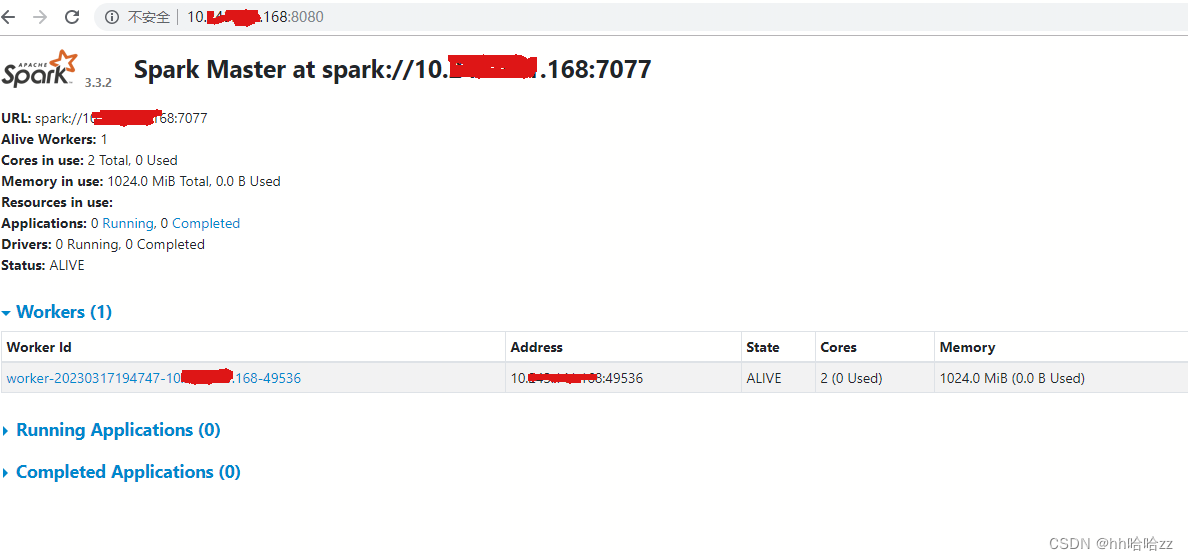

在Linux环境下,已安装了JDK1.8和Scala2.13.8,对Spark3.3.2进行解压并配置环境。修改spark-env.sh文件,设置了JAVA_HOME、SCALA_HOME,以及SPARK_MASTER_HOST、SPARK_PUBLIC_DNS等关键参数,确保Spark工作节点使用指定IP和端口。

在Linux环境下,已安装了JDK1.8和Scala2.13.8,对Spark3.3.2进行解压并配置环境。修改spark-env.sh文件,设置了JAVA_HOME、SCALA_HOME,以及SPARK_MASTER_HOST、SPARK_PUBLIC_DNS等关键参数,确保Spark工作节点使用指定IP和端口。

847

847

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?