Spark 的运行流程

1、Spark 的基本运行流程

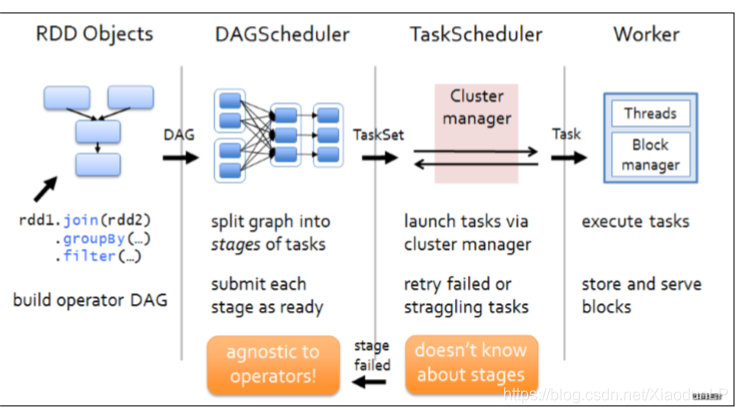

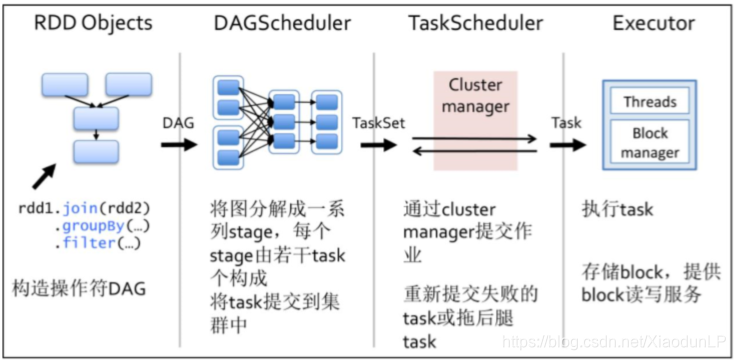

1、构建 DAG

使用算子操作 RDD 进行各种 transformation 操作,最后通过 action 操作触发 Spark 作业运行。 提交之后 Spark 会根据转换过程所产生的 RDD 之间的依赖关系构建有向无环图。

2、DAG 切割

DAG 切割主要根据 RDD 的依赖是否为宽依赖来决定切割节点,当遇到宽依赖就将任务划分 为一个新的调度阶段(Stage)。每个 Stage 中包含一个或多个 Task。这些 Task 将形成任务集 (TaskSet),提交给底层调度器进行调度运行。

3、任务调度

每一个 Spark 任务调度器只为一个 SparkContext 实例服务。当任务调度器收到任务集后负责 把任务集以 Task 任务的形式分发至 Worker 节点的 Executor 进程中执行,如果某个任务失败, 任务调度器负责重新分配该任务的计算。

4、执行任务

当 Executor 收到发送过来的任务后,将以多线程(会在启动 executor 的时候就初始化好了 一个线程池)的方式执行任务的计算,每个线程负责一个任务,任务结束后会根据任务的类 型选择相应的返回方式将结果返回给任务调度器。

2、运行流程图解

1、构建 Spark Application 的运行环境(初始化 SparkContext),SparkContext 向资源管理器(可 以是 Standalone、Mesos 或 YARN)注册并申请运行 Executor 资源

2、资源管理器分配 Executor 资源并启动 StandaloneExecutorBackend,Executor 运行情况将 随着心跳发送到资源管理器上

3、SparkContext 构建成 DAG 图,将 DAG 图分解成 Stage,并把 Taskset 发送给 TaskScheduler。 Executor 向 SparkContext 申请 Task,TaskScheduler 将 Task 发放给 Executor 运行同时 SparkContext 将应用程序代码发放给 Exec

本文详细介绍了Spark的运行流程,包括DAG的构建、Stage划分、任务调度和Executor的执行过程。SparkContext作为核心,初始化DAGScheduler、TaskScheduler和SchedulerBackend。Executor以多线程方式执行任务,并通过SchedulerBackend与资源管理器交互。此外,还探讨了Spark的资源隔离特性和数据本地性优化策略。

本文详细介绍了Spark的运行流程,包括DAG的构建、Stage划分、任务调度和Executor的执行过程。SparkContext作为核心,初始化DAGScheduler、TaskScheduler和SchedulerBackend。Executor以多线程方式执行任务,并通过SchedulerBackend与资源管理器交互。此外,还探讨了Spark的资源隔离特性和数据本地性优化策略。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

6294

6294

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?