分享人:宋凯 博士

整理者:林宜蓁

导读:

本文从广告主的角度,分享联邦学习实践的经验跟思考。

先介绍业务与技术选型背景:团队项目为用户增长及成本控制,方式为广告渠道投放,投放目标分为拉新、拉活两类。

-

拉新时,微视侧端内用户特征稀疏,而广告平台积累大量信息,但仅有有限性的oCPX标准化数据回传。

-

拉活时,微视侧具备用户行为序列等宝贵画像数据,与广告平台特征有互补性,但又无法直接粗暴的与广告平台共享数据。

所以,希望微视侧能与广告平台侧利用双方数据,实现收益共赢,但保证数据的安全不出域。在这种背景下我们团队选择了“联邦学习”,其为多方安全合作提供了一种解决方案。

文章围绕下面五点展开:

-

联邦学习

-

腾讯联邦学习平台 PowerFL

-

微视广告投放整体业务

-

广告投放联邦学习架构

-

建模实践和细节介绍

一、联邦学习

首先,简介联邦学习(Federated Learning,FL)的先导知识。

1. 联邦学习背景

机器学习模型都是 data-driven,但现实里数据皆为孤岛:公司与公司之间、甚至部门与部门之间无法共享数据;直接的共享会侵犯用户的隐私,也损伤公司的利益。2016年 Google 的文章以输入法 NLP 为背景,提出用安卓手机终端在本地更新模型,这篇文章一般被认为是联邦学习的开端。随即,我国微众银行、腾讯等公司也做了许多开创性的工作。

联邦学习的基本定义为:在进行机器学习的过程中,各参与方可借助其他方数据进行联合建模。各方无需直接触达他方数据资源,即数据不出本地的情况下,安全进行数据联合训练,建立共享的机器学习模型。

2. 联邦学习的两种架构

-

中心化联邦架构:早期发展包括 Google、微众银行,皆是此类架构。由可信赖的第三方(中央服务器)负责加密策略、模型分发、梯度聚合等。

-

去中心化联邦架构:有时双方合作,找不到可信赖的第三方,各方需参与对等计算。此架构需要更多的加解密和参数传输操作,比如:n方参与时,需进行2n(n-1)次传输。这里可以认为加解密算法实际上扮演了第三方的角色。

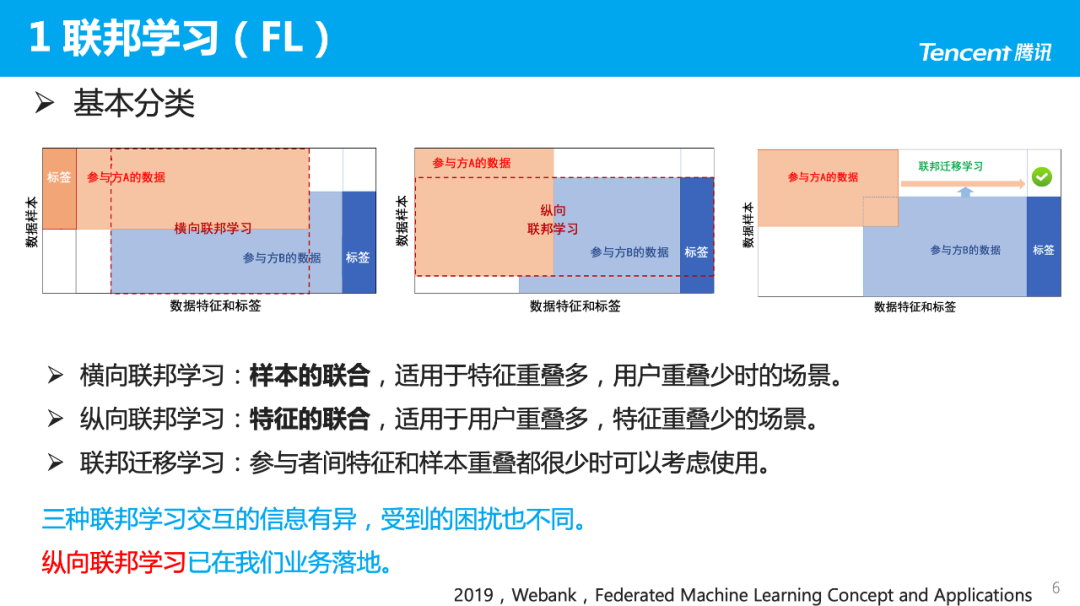

3. 联邦学习的三种分类

-

横向联邦学习:样本的联合,适用于特征重叠多,用户重叠少时的场景。比如:两个业务相似的公司,用户正交多但画像相似,可进行横向联邦学习,更像是一种数据变形的分布式机器学习。

-

纵向联邦学习:特征的联合,适用于用户重叠多,特征重叠少时的场景。比如:广告主与广告平台,希望结合两方的特征进行训练。

-

联邦迁移学习:参与者间的特征和样本重叠都很少时,可以考虑使用,但难度较高。

三种联邦学习交互的信息有异,受到的困扰也不同;比如:横向联邦学习时,各参与方数据异构,因此数据非独立同分布,也是联邦学习的研究热点。

目前纵向联邦学习已在我们业务中落地,也在探索联邦迁移学习、横向纵向的结合。

4. 联邦学习与分布式机器学习比较

精度上界:联邦学习不像优化其他具体的排序、召回模型,更像是在数据安全限制下,去推动整个建模。所以,理论上把共享数据下分布式机器学习(Distributed Machine Learning,DML)的结果作为上限。

联邦学习(FL)与分布式机器学习(DML)比较

虽然有人把联邦学习作为一种分布式机器学习的特殊情况,但是与一般的DML相比,联邦学习仍存在如下区别:

-

存在数据不共享的限制;

-

各server节点对worker节点控制弱;

-

通讯频率和成本较高。

二、腾讯联邦学习平台Angel PowerFL

从联邦学习发展开始,腾讯参与度就非常高。包括:制定发布《联邦学习白皮书2.0》、《腾讯安全联邦学习应用服务白皮书》等;基建方面,基于腾讯开源的智能学习平台Angel(https://github.com/Angel-ML/angel),构建PowerFL,目前内部开源;实践方面,在金融、广告、推荐场景,有多次尝试和落地。

1. 工程特色

腾讯联邦学习平台PowerFL除了易部署、兼容性好等机器学习平台基本要求,还有以下五个工程特色:

-

学习架构:使用去中心化联邦架构,不依赖第三方;

-

加密算法:实现并改进了各种常见的同态加密、对称和非对称加密算法;

-

分布式计算:基于 Spark on Angel 的分布式机器学习框架;

-

跨网络通信:利用 Pulsar 对跨网通信优化,增强稳定性,提供多方跨网络传输接口;

-

可信赖执行环境:TEE(SGX等)的探索和支持。

2. 算法优化

另外,针对算法侧也做了许多优化:

-

密文运算重写:基于 C++ GMP 重写密文运算库;

-

数据求交优化:分别就双方和多方优化,特别是多方侧进行了理论上的改造(改进的 FNP 协议);

-

GPU支持:密文运算部分可用GPU并行;

-

模型扩展支持:支持模型灵活扩展,可使用Tensorflow、Pytorch开发DNN模型嵌入。

值得提到的是,除了基于同态加密方案,PowerFL还支持秘

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

643

643

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?