实验介绍

本节实验将对 Apache Hadoop 进行介绍。

知识点

- Hadoop 生态系统

- Hadoop 环境搭建

Hadoop 介绍

Apache Hadoop 软件库是一个框架,允许在集群服务器上使用简单的编程模型对大数据集进行分布式处理。Hadoop 被设计成能够从单台服务器扩展到数以千计的服务器,每台服务器都有本地的计算和存储资源。Hadoop 的高可用性并不依赖硬件,其代码库自身就能在应用层侦测并处理硬件故障,因此能基于服务器集群提供高可用性的服务。

Hadoop 生态系统

经过多年的发展形成了 Hadoop1.X 生态系统,其结构如下图所示:

HDFS: Hadoop 生态圈的基本组成部分是 Hadoop 分布式文件系统(HDFS)。HDFS 是一种分布式文件系统,数据被保存在计算机集群上,HDFS 为 HBase 等工具提供了基础。

MapReduce:Hadoop 的主要执行框架是 MapReduce,它是一个分布式、并行处理的编程模型,MapReduce 把任务分为 map(映射)阶段和 reduce(化简)阶段。由于 MapReduce 工作原理的特性,Hadoop 能以并行的方式访问数据,从而实现快速访问数据。

Hbase: HBase 是一个建立在 HDFS 之上,面向列的 NoSQL 数据库,用于快速读 / 写大量数据,HBase 使用 Zookeeper 进行管理。

Zookeeper: 用于 Hadoop 的分布式协调服务。Hadoop 的许多组件依赖于 Zookeeper,它运行在计算机集群中,用于管理 Hadoop 集群。

Pig: 它是 MapReduce 编程的复杂性的抽象。Pig 平台包括运行环境和用于分析 Hadoop 数据集的脚本语言 (Pig Latin),其编译器将 Pig Latin 翻译成 MapReduce 程序序列。

Hive: 类似于 SQL 高级语言,用于运行存储在 Hadoop 上的查询语句,Hive 让不熟悉 MapReduce 的开发人员也能编写数据查询语句,然后这些语句被翻译为 Hadoop 上面的 MapReduce 任务。像 Pig 一样,Hive 作为一个抽象层工具,吸引了很多熟悉 SQL 而不是 Java 编程的数据分析师。

Sqoop: 一个连接工具,用于在关系数据库、数据仓库和 Hadoop 之间转移数据。Sqoop 利用数据库技术描述架构,进行数据的导入 / 导出;利用 MapReduce 实现并行化运行和容错技术。

Flume: 提供了分布式、可靠、高效的服务,用于收集、汇总大数据,并将单台计算机的大量数据转移到 HDFS。它基于一个简单而灵活的架构,利用简单的可扩展的数据模型,将企业中多台计算机上的数据转移到 Hadoop 中。

Apache 版本衍化

Apache Hadoop 版本分为两代,我们将第一代 Hadoop 称为 Hadoop 1.0,第二代 Hadoop 称为 Hadoop 2.0。

第一代 Hadoop 包含三个大版本,分别是 0.20.x,0.21.x 和 0.22.x。其中,0.20.x 最后演化成 1.0.x,变成了稳定版,而 0.21.x 和 0.22.x 则包括 NameNode HA 等新的重大特性。

第二代 Hadoop 包含两个版本,分别是 0.23.x 和 2.x,它们完全不同于 Hadoop 1.0,是一套全新的架构,均包含 HDFS Federation 和 YARN 两个系统,相比于 0.23.x,2.x 增加了 NameNode HA 和 Wire-compatibility 两个重大特性。

Hadoop1.X 伪分布安装

Hadoop 安装有如下三种方式:

单机模式: 安装简单,几乎不用做任何配置,但仅限于调试用途。

伪分布模式: 在单节点上同时启动 NameNode、DataNode、JobTracker、TaskTracker、Secondary Namenode 等 5 个进程,模拟分布式运行的各个节点。

完全分布式模式: 正常的 Hadoop 集群,由多个各司其职的节点构成。

由于实验环境的限制,本节课程将讲解伪分布模式安装,并在随后的课程中以该环境为基础进行其他组件部署实验。以下为伪分布式环境下在 CentOS6 中配置 Hadoop-1.1.2,该配置可以作为其他 Linux 系统和其他版本的 Hadoop 部署参考。

软硬件环境说明

Hadoop 搭建环境:

虚拟机操作系统: CentOS6.6 64 位,单核,1G 内存

JDK: 1.7.0_55 64 位

Hadoop: 1.1.2

环境搭建

配置本地环境

设置机器名

使用 sudo vi /etc/sysconfig/network。

打开配置文件,根据实际情况设置该服务器的机器名,新机器名在重启后生效。

设置 Host 映射文件

1.设置 IP 地址与机器名的映射,设置信息如下:

# 配置主机名对应的IP地址

$ sudo vi /etc/hosts

设置:<IP 地址> <主机名>

例如: 192.168.42.2 55a95997af1c hadoop

注意:就是在打开的 /etc/hosts 文件的最后一行加上 hadoop,记得使用的是 tab 键而不是空格

2.使用 ping 命令验证设置是否成功。

ping hadoop

设置操作系统环境

关闭防火墙

在 Hadoop 安装过程中需要关闭防火墙和 SElinux,否则会出现异常。

1.使用 sudo service iptables status。

查看防火墙状态,如下所示表示 iptables 已经开启。

(注意:若弹出权限不足,可能防火墙已经关闭,请输入命令:chkconfig iptables --list 查看防火墙的状态。)

2.使用如下命令关闭 iptables。

sudo chkconfig iptables off

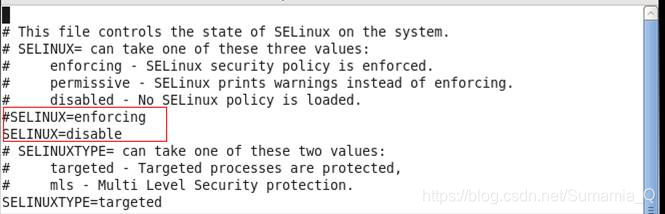

关闭 SElinux

1.使用 getenforce 命令查看是否关闭 。

2.修改 /etc/selinux/config 文件

将 SELINUX=enforcing 改为 SELINUX=disabled,执行该命令后重启机器生效。

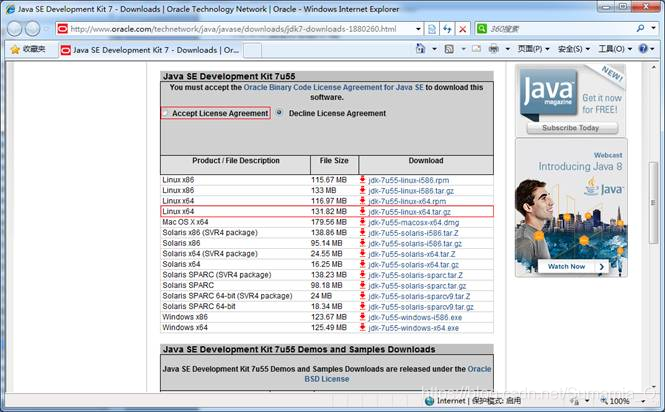

JDK 安装及配置

1.下载 JDK 64bit 安装包。

打开 JDK 64bit 安装包下载链接:

http://www.oracle.com/technetwork/java/javase/downloads/java-archive-downloads-javase7-521261.html。

打开界面之后,先选中 Accept License Agreement,然后下载 jdk-7u55-linux-x64.tar.gz,如下图所示:

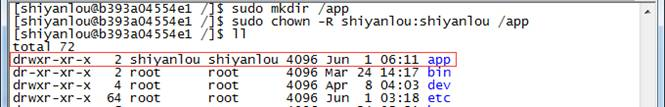

2.创建 /app 目录,把该目录的所有者修改为shiyanlou。

sudo mkdir /app

sudo chown -R shiyanlou:shiyanlou /app

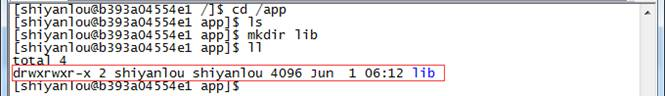

3.创建 /app/lib 目录,使用命令如下:

mkdir /app/lib

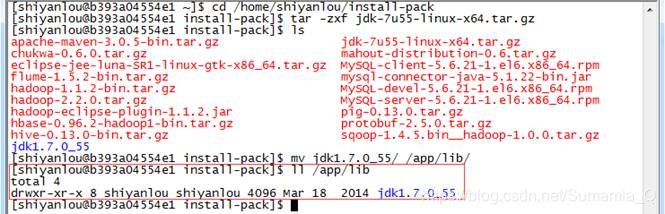

4.把下载的安装包解压并迁移到 /app/lib 目录下。

cd /home/shiyanlou/install-pack

tar -zxf jdk-7u55-linux-x64.tar.gz

mv jdk1.7.0_55/ /app/lib

ll /app/lib

5.使用 sudo vi /etc/profile 命令打开配置文件,设置 JDK 路径。

export JAVA_HOME=/app/lib/jdk1.7.0_55

export PATH=$JAVA_HOME/bin:$PATH

export CLASSPATH=.:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar

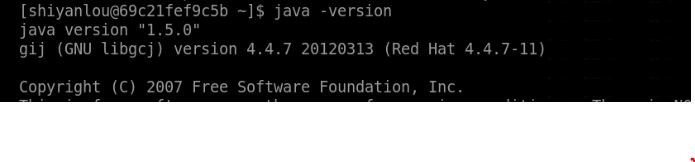

6.编译并验证

source /etc/profile

java -version

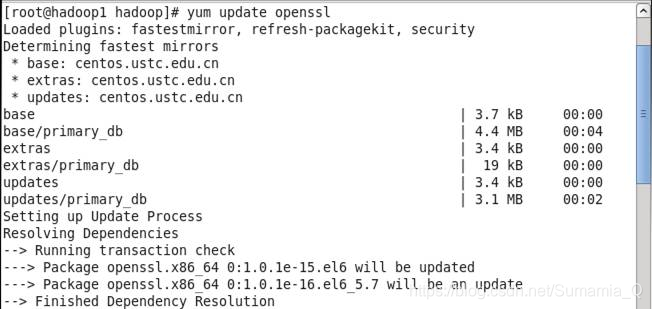

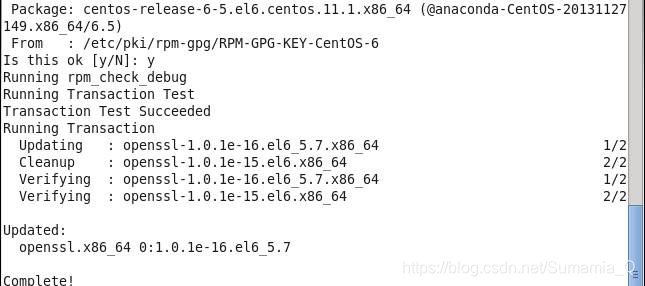

更新 OpenSSL

CentOS 自带的 OpenSSL 存在 bug,使用如下命令进行更新:

yum update openssl

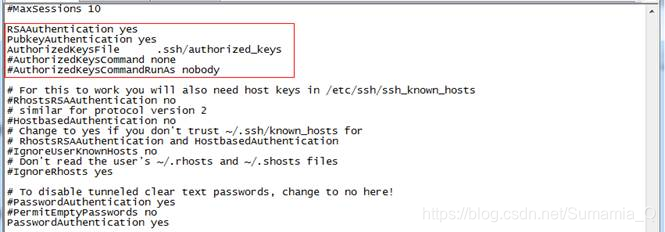

SSH 无密码验证配置

1.使用 sudo vi /etc/ssh/sshd_config,打开 sshd_config 配置文件,开放三个配置,如下图所示:

RSAAuthentication yes

PubkeyAuthentication yes

AuthorizedKeysFile .ssh/authorized_keys

2.配置后重启服务。

sudo service sshd restart

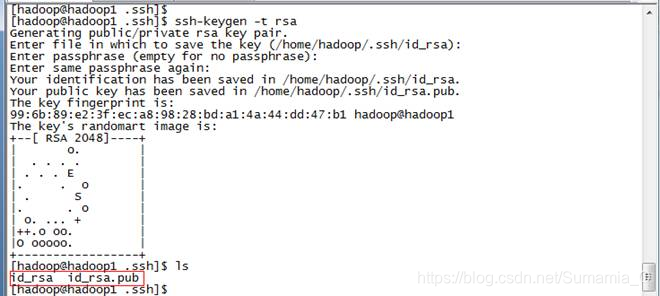

3.使用 shiyanlou 用户登录使用如下命令生成私钥和公钥。

ssh-keygen -t rsa

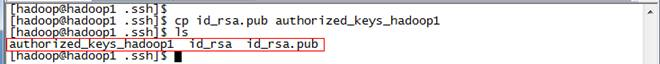

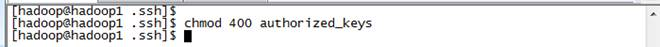

4.进入 /home/shiyanlou/.ssh 目录把公钥命名为 authorized_keys,使用命令如下:

cp id_rsa.pub authorized_keys

5.使用如下设置 authorized_keys 读写权限。

sudo chmod 400 authorized_keys

6.测试 ssh 免密码登录是否生效。

Hadoop 环境搭建

下载并解压 hadoop 安装包

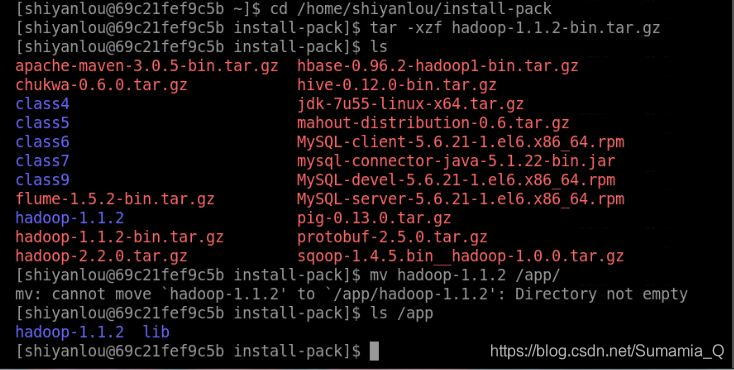

在 Apache 的归档目录中下载 hadoop-1.1.2-bin.tar.gz 安装包,也可以在 /home/shiyanlou/install-pack 目录中找到该安装包,解压该安装包并把该安装包复制到 /app 目录中。

cd /home/shiyanlou/install-pack

tar -xzf hadoop-1.1.2-bin.tar.gz

rm -rf /app/hadoop-1.1.2

mv hadoop-1.1.2 /app

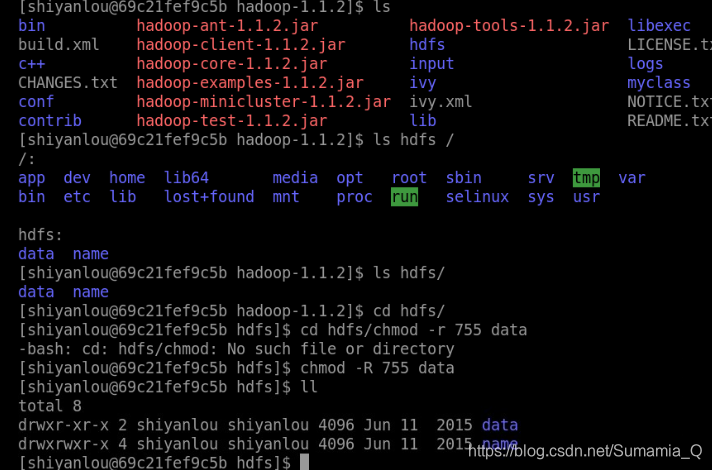

在 Hadoop-1.1.2 目录下创建子目录

cd /app/hadoop-1.1.2

mkdir -p tmp hdfs hdfs/name hdfs/data

ls

进入 hdfs 目录中,使用 chmod -R 755 data 命令把 hdfs/data 设置为 755,否则 DataNode 会启动失败。

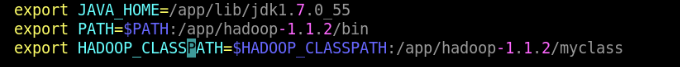

配置 hadoop-env.sh

1.进入 hadoop-1.1.2/conf 目录,打开配置文件 hadoop-env.sh。

cd /app/hadoop-1.1.2/conf

vi hadoop-env.sh

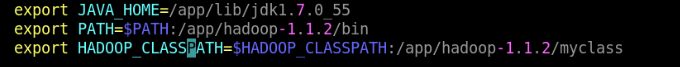

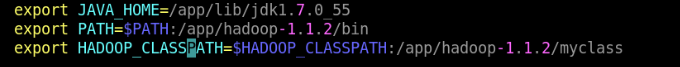

2.加入配置内容,设置 Hadoop 中 jdk 和 hadoop/bin 路径。

export JAVA_HOME=/app/lib/jdk1.7.0_55

export PATH=$PATH:/app/hadoop-1.1.2/bin

3.编译配置文件 hadoop-env.sh,并确认生效。

source hadoop-env.sh

hadoop version

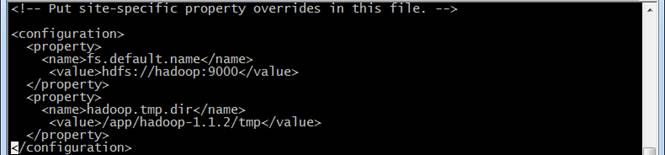

配置 core-site.xml

1.使用如下命令打开 core-site.xml 配置文件。

sudo vi core-site.xml

2.在配置文件中,按照如下内容进行配置。

<configuration>

<property>

<name>fs.default.name</name>

<value>hdfs://hadoop:9000</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/app/hadoop-1.1.2/tmp</value>

</property>

</configuration>

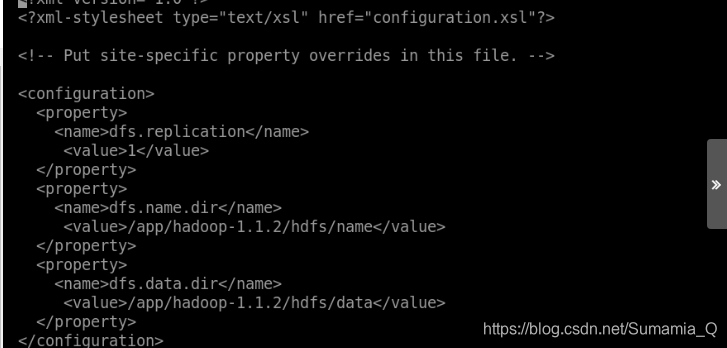

配置 hdfs-site.xml

1.使用如下命令打开 hdfs-site.xml 配置文件。

sudo vi hdfs-site.xml

2.在配置文件中,按照如下内容进行配置。

<configuration>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.name.dir</name>

<value>/app/hadoop-1.1.2/hdfs/name</value>

</property>

<property>

<name>dfs.data.dir</name>

<value>/app/hadoop-1.1.2/hdfs/data</value>

</property>

</configuration>

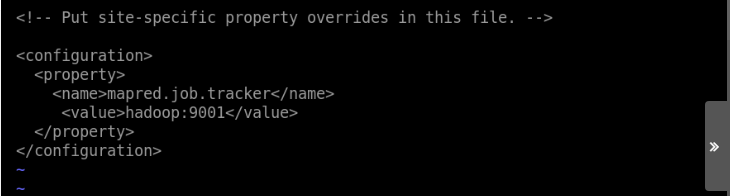

配置 mapred-site.xml

1.使用如下命令打开 mapred-site.xml 配置文件。

sudo vi mapred-site.xml

2.在配置文件中,按照如下内容进行配置。

<configuration>

<property>

<name>mapred.job.tracker</name>

<value>hadoop:9001</value>

</property>

</configuration>

配置 masters 和 slaves 文件

1.设子主节点。

vi masters

2.设置从节点。

vi slaves

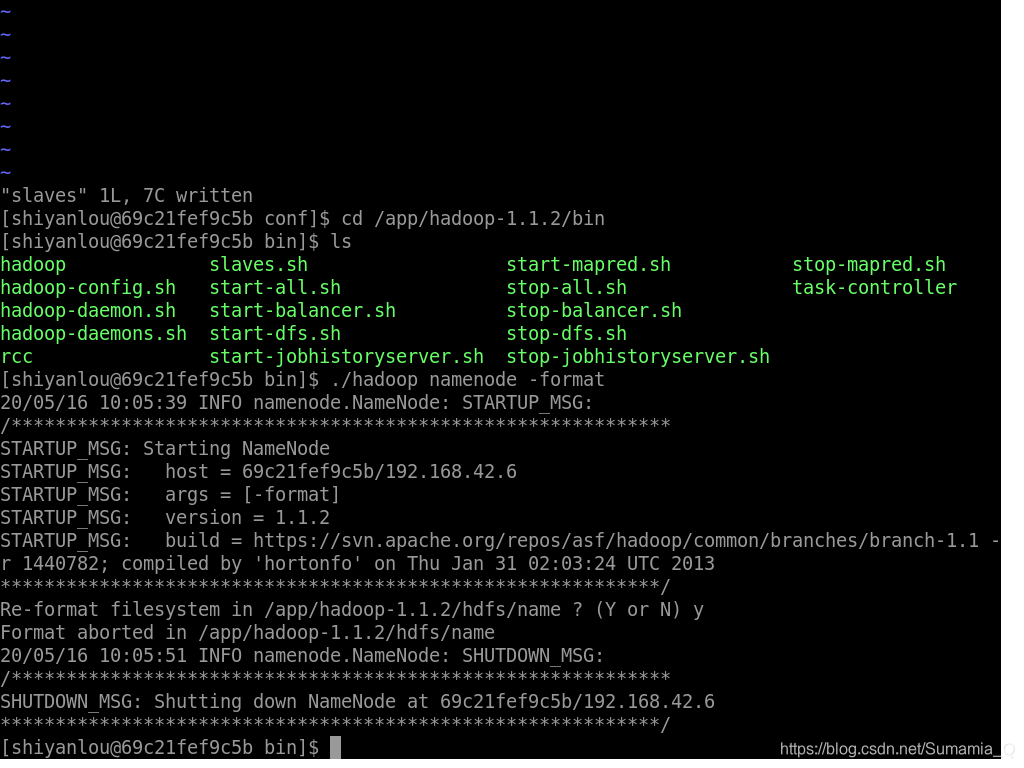

格式化 namenode

在 hadoop 机器上使用如下命令进行格式化 namenode。

cd /app/hadoop-1.1.2/bin

./hadoop namenode -format

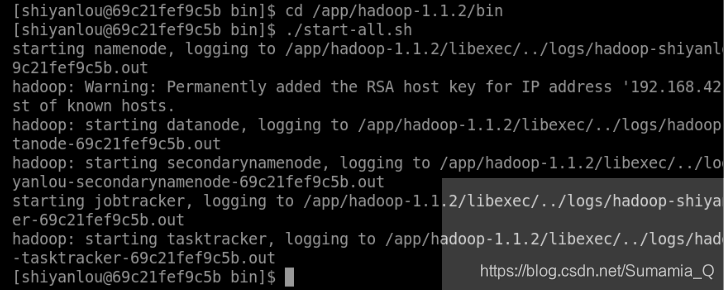

启动 hadoop

./start-all.sh

用 jps 检验各后台进程是否成功启动

使用 jps 命令查看 hadoop 相关进程是否启动。

本实验介绍了Apache Hadoop,一个用于分布式处理大数据的框架。Hadoop生态系统包括HDFS、MapReduce、HBase、Zookeeper等组件。重点讲解了Hadoop1.0的伪分布安装,包括配置本地环境、关闭防火墙、安装JDK、更新OpenSSL、SSH无密码验证以及Hadoop环境的详细配置步骤。

本实验介绍了Apache Hadoop,一个用于分布式处理大数据的框架。Hadoop生态系统包括HDFS、MapReduce、HBase、Zookeeper等组件。重点讲解了Hadoop1.0的伪分布安装,包括配置本地环境、关闭防火墙、安装JDK、更新OpenSSL、SSH无密码验证以及Hadoop环境的详细配置步骤。

392

392

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?