智谱新出的 GLM-4.6,编程能力大幅提升,较GLM-4.5提升27%,而且一如既往地开源。

现在大模型满天飞,个个都说自己强,尤其是在写代码这块,更是兵家必争之地。

代码这事,被 GLM-4.6 拿捏了

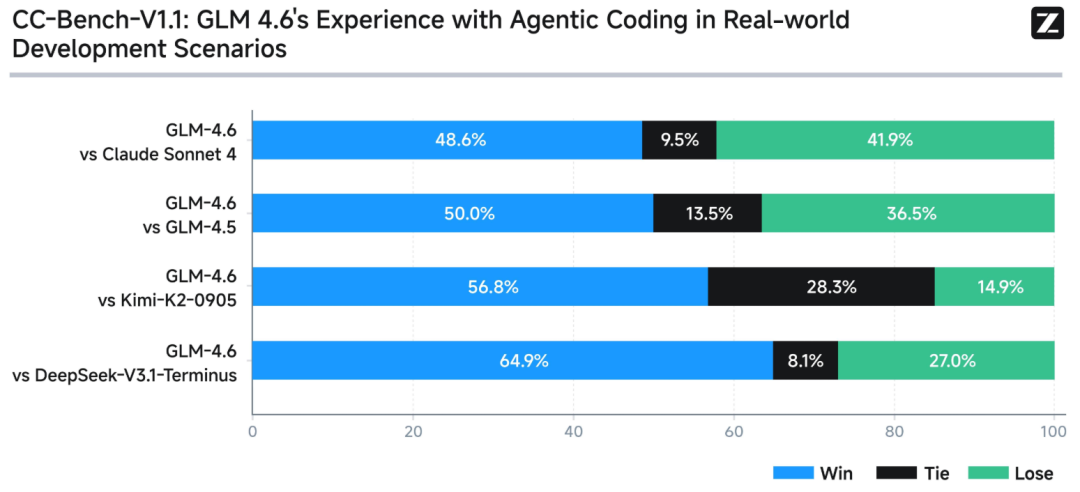

光跑分还是差点意思,是骡子是马,总得拉到真实场景里遛遛。智谱这次就在 Claude Code 环境下,真刀真枪地跑了 74 个现实世界里的编程任务。

结果 GLM-4.6 赢了。不光是超过了 Claude Sonnet 4,也把国内其他模型甩在了后面。

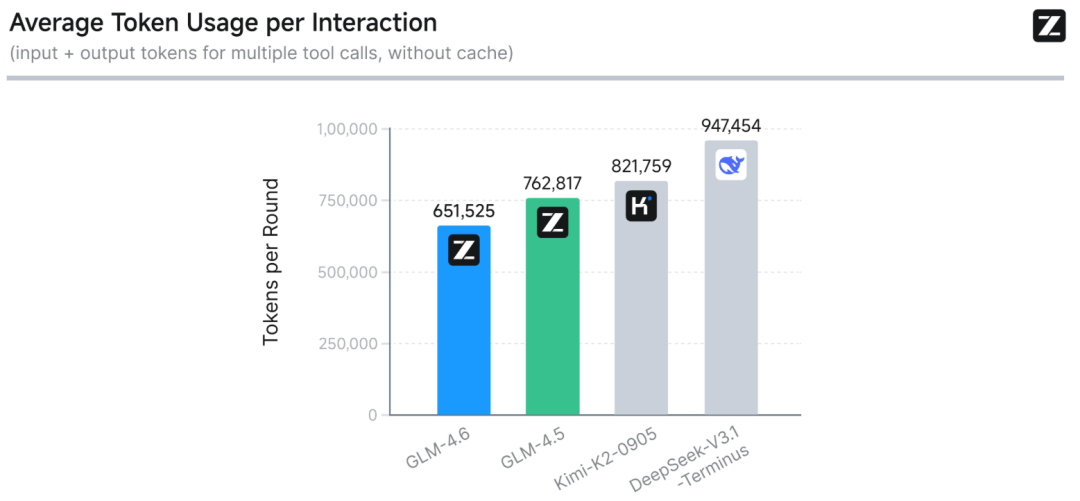

不光性能强,它还省token。

完成同样任务,GLM-4.6 平均消耗的 token 比上一代 GLM-4.5 少了 30% 还多。在同类模型里,这个消耗量是最低的。

效率高,成本低。对于天天跟代码打交道的开发者来说,用更少的钱,办更多的事。

智谱还把所有测试题、模型的每一步操作轨迹,都公开在了 Hugging Face 上。

https://huggingface.co/datasets/zai-org/CC-Bench-t

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

899

899

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?