在运行神经网络求梯度的时候遇到了这样的问题。

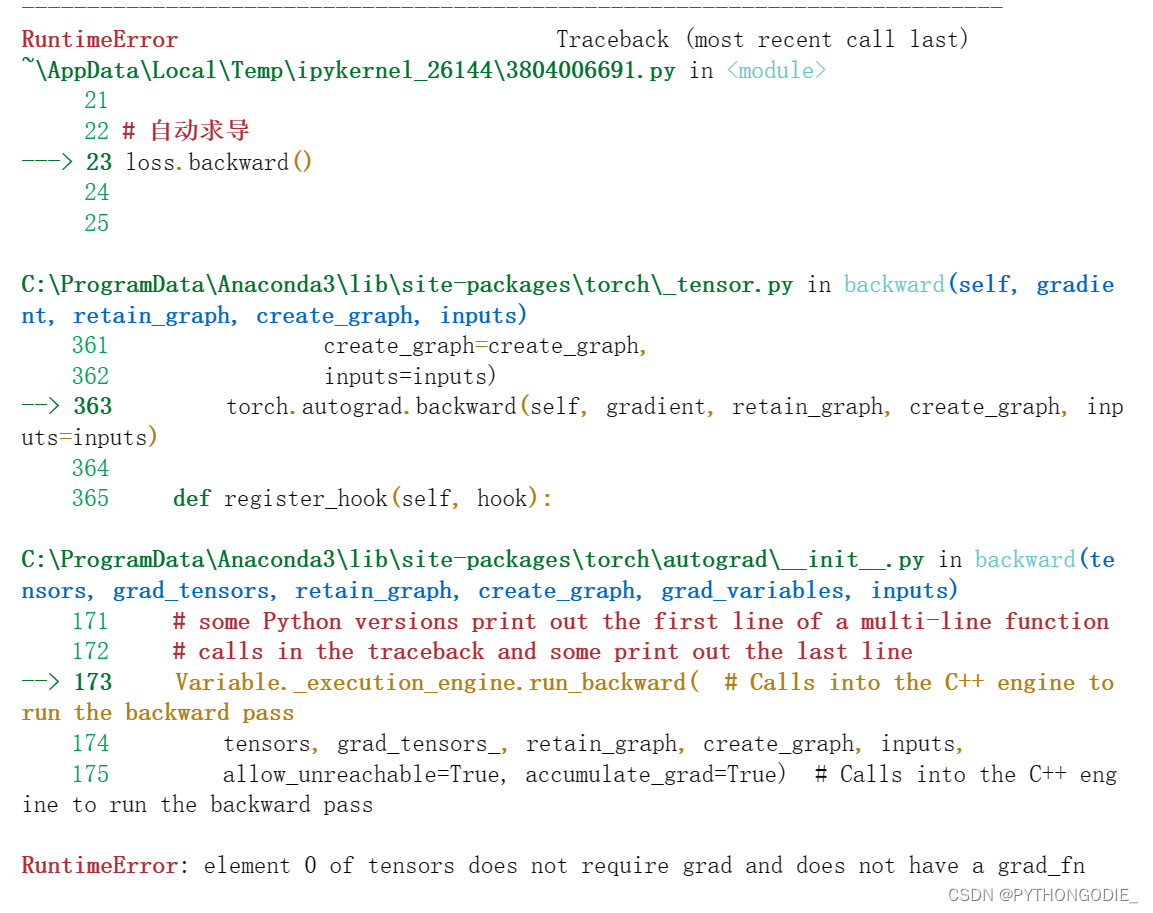

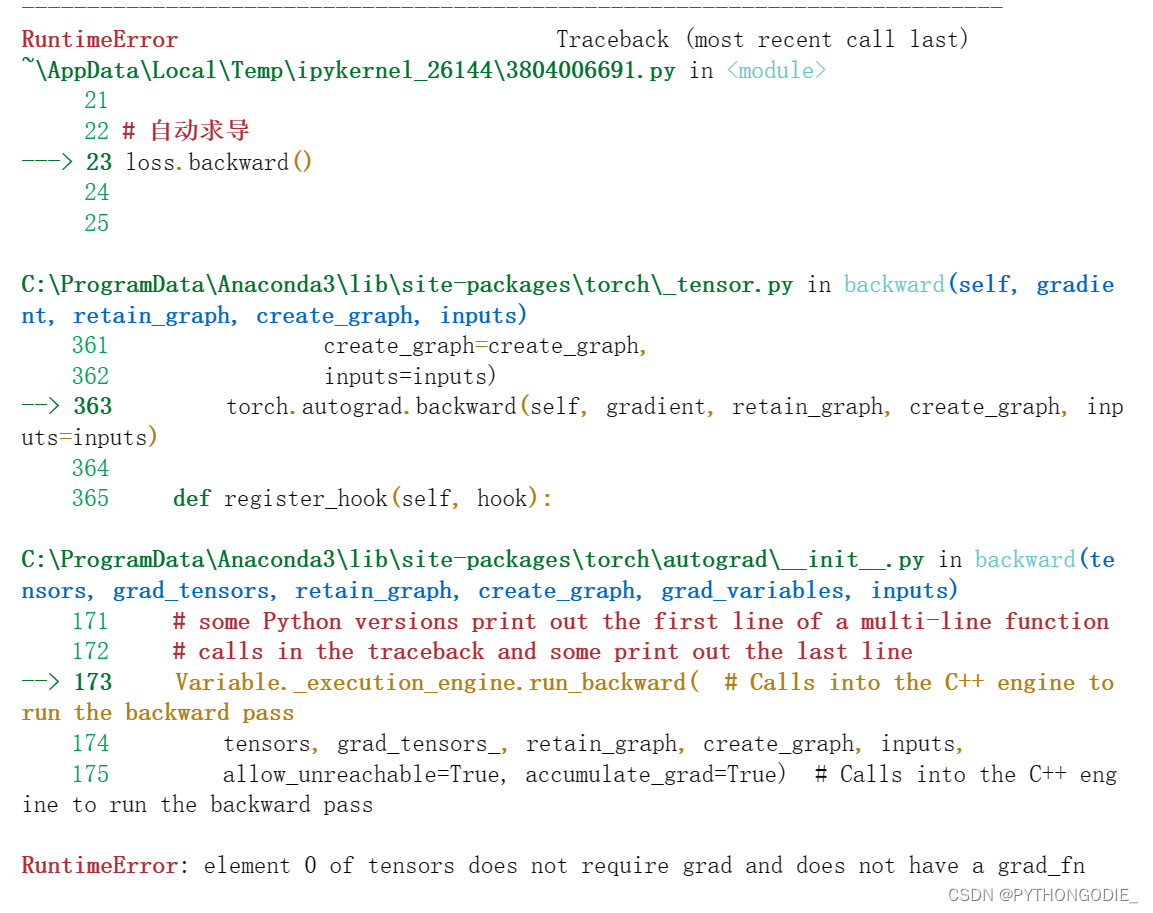

发现出错在

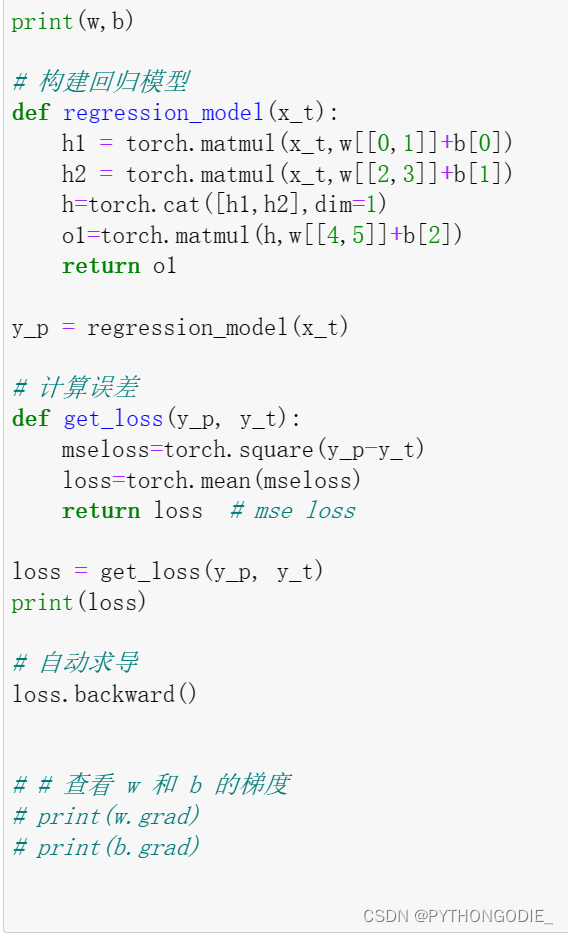

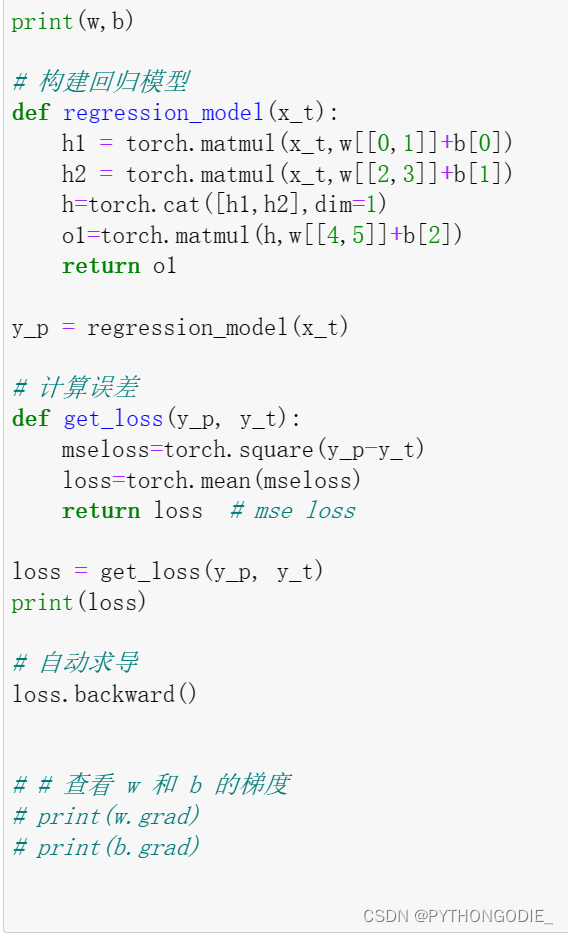

原因:这里的loss默认的requires_grad是False,因此在backward()处不会计算梯度,导致出错

方法:将loss的requires_grad属性设为True,如下所示:

文章讲述了在使用神经网络时遇到的错误,原因是loss默认的requires_grad属性为False,不计算梯度。解决方法是将loss的requires_grad属性设为True以便进行梯度反向传播。

文章讲述了在使用神经网络时遇到的错误,原因是loss默认的requires_grad属性为False,不计算梯度。解决方法是将loss的requires_grad属性设为True以便进行梯度反向传播。

在运行神经网络求梯度的时候遇到了这样的问题。

发现出错在

原因:这里的loss默认的requires_grad是False,因此在backward()处不会计算梯度,导致出错

方法:将loss的requires_grad属性设为True,如下所示:

5446

5446

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?