神经网络(Neural Networks)是现代人工智能的核心支柱。无论是图像识别、语言处理,还是推荐系统、自动驾驶,背后几乎都依赖深度神经网络的表达能力。从最初的感知机到如今的多层Transformer模型,神经网络的发展带来了AI的一次次跃迁。

如果你希望真正理解神经网络,而不仅仅是调用现成模型或库,这条学习路线将带你系统地掌握它的数学基础、结构原理、训练方法与实际应用。

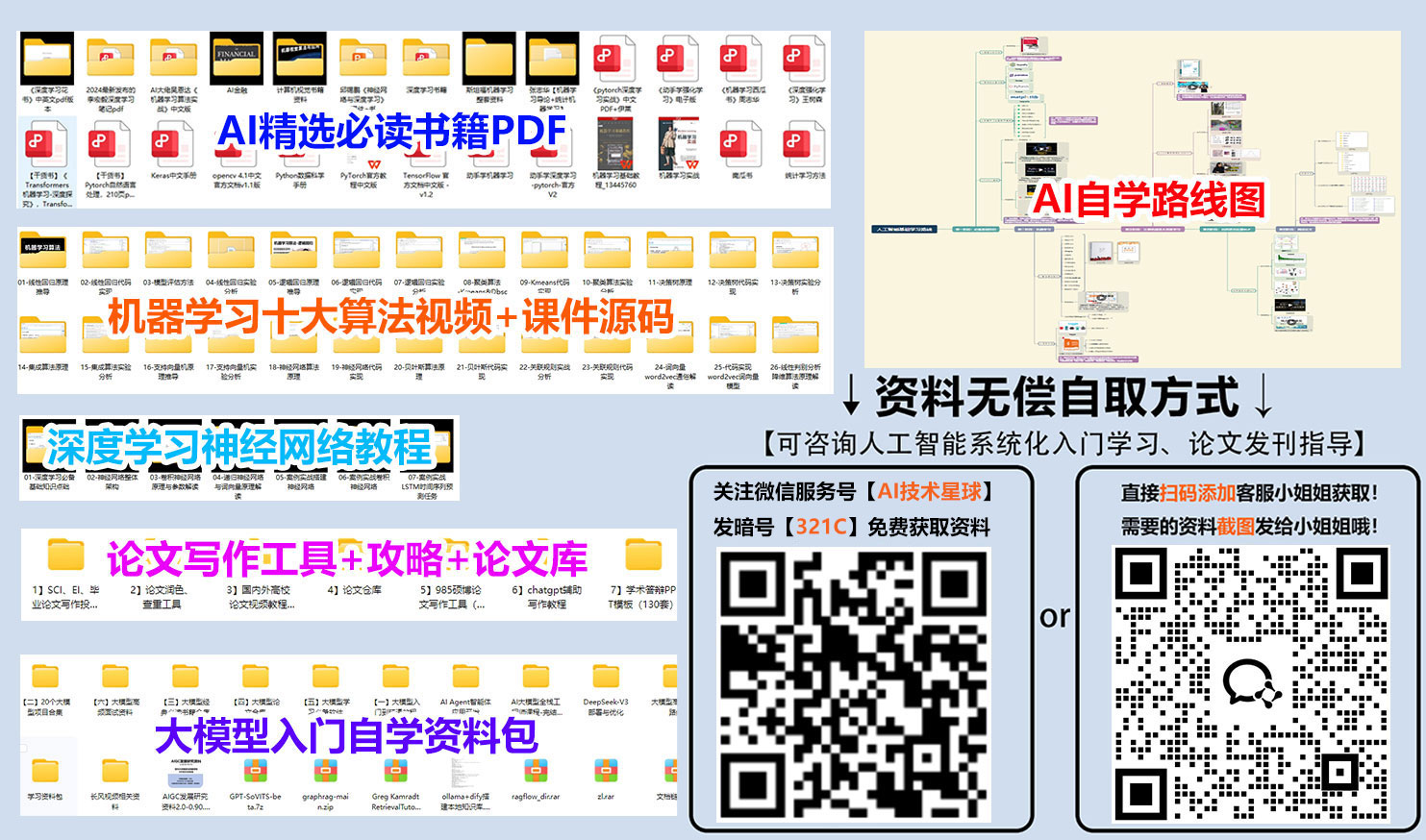

免费分享一套人工智能+大模型入门学习资料给大家,如果想自学,这套资料很全面!

关注公众号【AI技术星球】发暗号【321C】即可获取!

【人工智能自学路线图(图内推荐资源可点击内附链接直达学习)】

【AI入门必读书籍-花书、西瓜书、动手学深度学习等等...】

【机器学习经典算法视频教程+课件源码、机器学习实战项目】

【深度学习与神经网络入门教程】

【计算机视觉+NLP经典项目实战源码】

【大模型入门自学资料包】

【学术论文写作攻略工具】

一、数学与编程基础:神经网络的“土壤”

神经网络依赖大量数学概念来实现学习与优化,推荐掌握以下内容:

-

线性代数:矩阵乘法、向量空间、特征值,理解权重的传递与组合

-

微积分:链式法则、导数,关键在于理解反向传播(backpropagation)

-

概率统计:用于损失函数设计与模型评估(如交叉熵、KL散度)

-

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?