选择正确的LLM推理栈意味着选择适合你的任务的正确模型,并配以适当的推理代码在适当的硬件上运行。本文介绍了流行的LLM推理堆栈和设置,详细说明其推理的成本构成;并讨论当前的开源模型以及如何充分利用它们,同时还涉及当前开源服务栈中仍然缺失的功能,以及未来模型将解锁的新功能。

本文源自Mistral AI首席技术官Timothée Lacroix的演讲。他于2015年在Facebook AI Research担任工程师,于2016年至2019年间与École des Ponts合作完成了关于推荐系统的张量分解的论文。2023年他成为Mistral AI的联合创始人。Mistral AI于近期发布了业内首个开源MoE大模型Mixtral-8x7B。

(以下内容由OneFlow编译发布,转载请联系授权。地址:https://www.youtube.com/watch?v=mYRqvB1_gRk)

作者 | Timothée Lacroix

OneFlow编译

翻译|宛子琳、杨婷

本次演讲的很多内容都基于我在网上找到的信息或通过对第一个LLaMA版本模型进行实验时的发现。我认为,现在的Mistral更关注推理成本,而非训练成本。因此,我将分享推理成本的构成、吞吐、时延及其影响因素。

很多人想要部署语言大模型,我将分享如何使用开源工具部署自己的语言大模型。当然,你也可以使用一些出色的公共API,但我对开源工具更感兴趣,所以接下来我将深入讨论部署一个70亿参数模型的重要细节。我将分享的许多内容也同样适用于更大规模的模型,但那需要更多GPU。

1

影响推理的指标

我们将首先讨论有哪些重要指标,以及这些指标的影响因素,包括硬件和软件层面。接下来,我将介绍一些能够改善性能的技巧,据我所知,其中一些技巧还未获得广泛实现。我尝试在各种不同的硬件上运行了一系列模型,并尝试获得性能曲线,我认为实例非常重要,所以我将通过这些数据得出结论。

首先,我们该关注哪些指标?第一是吞吐量,以每秒查询数(Query/second)表示,我们希望在批处理作业中将这一指标最大化,或者希望允许更多用户使用我们的服务。第二是时延,以每词元每秒(seconds/token)表示,即输出下一个词元所需的时间,这决定了你的应用程序的速度和灵敏度。在ChatGPT中,这一速度相当快。对于较小的模型,可以更轻松地实现快速响应,因此我们希望将这个值最小化以提升用户体验。较为优秀的阈值是每分钟输出250个单词,我认为这是人类的平均阅读速度,只要你的时延低于这个值,用户就不会感到无聊。第三是成本,毫无疑问,这一数值越低越好。

2

影响推理指标的因素

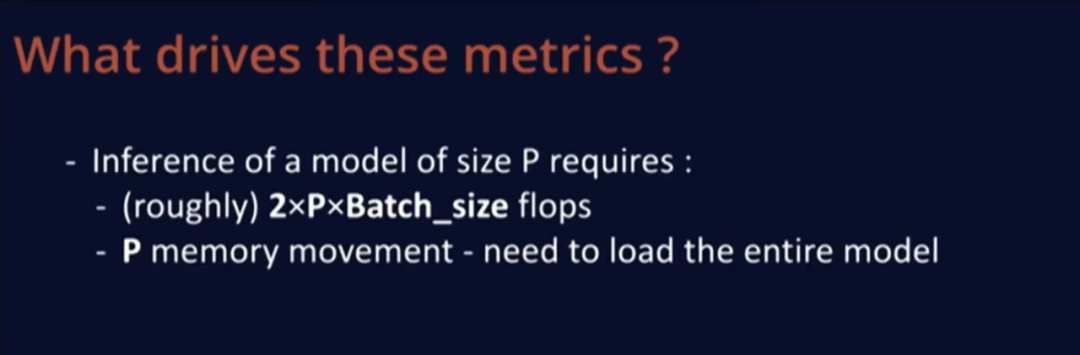

现在我将深入探讨这些指标的影响因素。我只会谈论自回归解码,即基于一批批词元通过神经网络确定下一批词元,这部分不包括处理查询的第一部分。提示处理有时被称为预填充(prefill)部分,我们会一次性将大量词元输入到神经网络中,这部分处理通常已经经过充分优化,挑战性相对较低。

考虑到这一点,我们对大小为P的模型的推理感兴趣。可以假设P是7B,为执行一步推理,大约需要2xPxBatch_size的FLOPs(浮点运算数)。在进行这些浮点运算时,我们需要将整个模型加载到实际运行计算的GPU,并且需要一次性加载整个模型,即大致上需要的内存搬运(memory movement)量等于模型的参数数量。

本文介绍了如何选择适合的LLM推理堆栈,关注推理成本、吞吐量、时延等因素,并分享了开源工具部署大模型的细节,包括影响性能的关键指标、优化技巧和未来发展趋势。MistralAI的MoE模型和OneDiff等工具也在文中被提及。

本文介绍了如何选择适合的LLM推理堆栈,关注推理成本、吞吐量、时延等因素,并分享了开源工具部署大模型的细节,包括影响性能的关键指标、优化技巧和未来发展趋势。MistralAI的MoE模型和OneDiff等工具也在文中被提及。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

941

941

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?