Spark on yarn

环境:基于CDH的大数据组件平台。

yarn服务有resource manager和node manager组成,在yarn上运行的任务,由一个ApplicationMaster和多个container组成。

Spark 运行由一个driver和多个executor组成,Spark on Yarn时,Spark的driver和executor分别运行在yarn的container中。

在Spark任务运行过程中,我们时常需要查看Spark的运行日志,来定位问题,所以我们需要知道如何查看Spark on Yarn的运行日志。

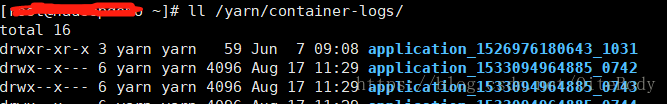

日志存放路径

nodemanager存放container日志的本地路径

<property>

<name>yarn.nodemanager.log-dirs</name>

<value>/yarn/container-logs/</value>

</property>

container日志在hdfs存放的路径

<property>

<description>Where to aggregate logs</description>

<!-- hdfs路径,container日志在hdfs存放的路径-->

<name>yarn.nodemanager.remote-app-log-dir</name>

<value>/tmp/logs</value>

</property>

日志查看举例

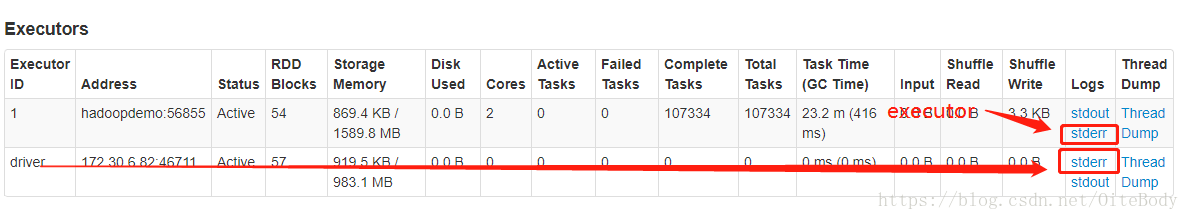

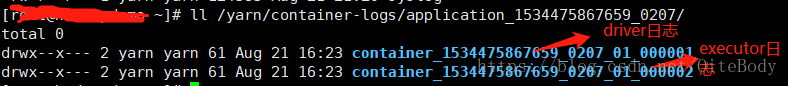

driver日志与executer日志

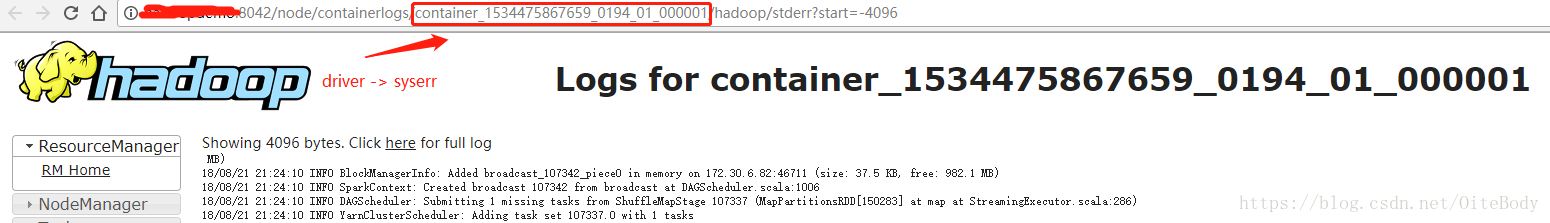

打开driver -> stderr的日志链接,可以看到所在yarn上的对应container日志:

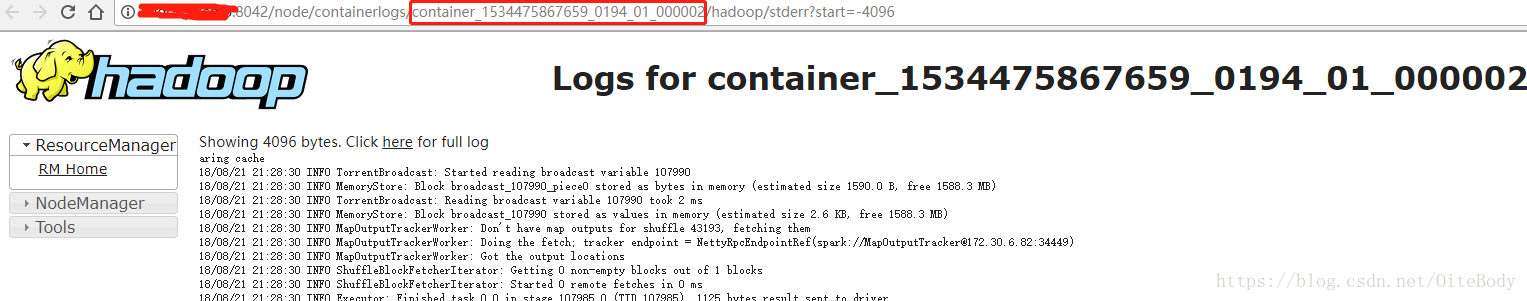

打开executor -> stderr的日志链接,可以看到对应container日志:

container日志的本地路径

保留Spark stage执行历史

Spark任务完成后,查看执行历史,可能会发现无法查看history。这是由于Spark任务执行完之后,把stage相关的文件删除了。有参数可以控制任务执行完成后,stage文件依旧被保留(在spark-env.sh中设置):

|

属性名 |

说明 |

默认值 |

|

spark.yarn.applicationMaster.waitTries |

RM等待Spark AppMaster启动次数,也就是SparkContext初始化次数。超过这个数值,启动失败。 |

10 |

|

spark.yarn.submit.file.replication |

应用程序上载到HDFS的文件的复制因子 |

3 |

|

spark.yarn.preserve.staging.files |

设置为true,在job结束后,将stage相关的文件保留而不是删除。 |

false |

|

spark.yarn.scheduler.heartbeat.interval-ms |

Spark AppMaster发送心跳信息给YARN RM的时间间隔 |

5000 |

|

spark.yarn.max.executor.failures |

导致应用程序宣告失败的最大executor失败数 |

2倍于executor数 |

|

spark.yarn.historyServer.address |

Spark history server的地址(不要加http://)。这个地址会在应用程序完成后提交给YARN RM,使得将信息从RM UI连接到history server UI上。 |

无 |

本文介绍在基于CDH的大数据组件平台中如何查看Spark on Yarn的运行日志,包括日志存放路径及查看实例,并提供配置参数用于保留Spark stage执行历史。

本文介绍在基于CDH的大数据组件平台中如何查看Spark on Yarn的运行日志,包括日志存放路径及查看实例,并提供配置参数用于保留Spark stage执行历史。

654

654

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?