首先介绍一下AI绘画的过程,AI绘画的整个流程可以简化作为将图片信息或者文字信息转化为潜空间的信息,然后通过采样转换为目标的图片信息,最终再转换出来成为图片信息的流程。

那么其中转换的每个环节之间需要的也就是各种的功能性节点。整个节点链接在一起的也就是comfyUI的工作流。

通俗的来讲,整体过程就是:

比喻一下,将一个面团放入烤箱里,经过烤箱的烘焙,它变成了香喷喷的面包。

同样地,当我们提供描述文字或图片作为需求,将其放入ComfyUI这个"烤箱"中,经过精巧的处理和创造力的火焰,最终呈现出我们所需的AI图片,就像面包一样美味可口。

这个过程就像一场魔法,将想象变成了现实,带给我们视觉上的满足与愉悦。

👇👇👇想要进一步咨询学习规划及更多相关领域资料,请文末扫🐎咨询老师👇👇👇

Tips

本篇主要关注于ComfyUI的快速搭建和AI图片的生成过程,而并非深入解析其生成原理。着眼于能够迅速上手使用,先体验其功能和效果,然后再逐步学习其背后的运行原理。

接下来就以Windows系统和NVIDIA独立显卡为例,简单搭建一个ComfyUI工作流。

安装与配置相关

推荐配置:

>8GB的显存,推荐独立显卡。

* 1

安装:

1. 下载百度网盘中的压缩包(百度网盘链接在文末)

2. 下载完成后,将压缩包解压,点击

* 1

* 2

* 3

ComfyUI_windows_portable_nvidia_cu121_or_cpu

/ComfyUI_windows_portable目录下名为run_nvidia_gpu(或者为run_nvidia_gpu.bat)的文件,出现的黑框不要关闭,稍等一会就会打开一个网页界面,如果没有自动跳转,可以在网页的地址栏中输入http://127.0.0.1:8188/来打开ComfyUI的页面

)

使用ComfyUI正式画一张图

点击最左边的框内(即上图红色圈圈出的位置)的箭头,直到出现"官方模组:Stable Diffusion 1.4.ckpt"

在绿色圈圈出的位置中输入以下内容:(复制即可)

(worstquality,lowquality:1.4,(((simplebackground))),monochrome,lowres,bad

anatomy, bad hands, text, error, missing fingers, extra digit, fewer digits,

cropped, worst quality, low quality, normal quality, jpeg artifacts,

signature, watermark, username, blurry, lowres, bad anatomy, bad hands, text,

error, extra digit, fewer digits, cropped, worst quality, low quality, normal

quality, jpeg artifacts, signature, watermark, username,

blurry,ugly,pregnant,vore,duplicate,morbid,mutilated,tran nsexual,

hermaphrodite,long neck,mutated hands,poorly

drawnhands,poorlydrawnface,mutation,deformed,blurry,badanatomy,badproportions,malformedlimbs,extralimbs,clonedface,disfigured,gross

proportions, (((missing arms))),(((missinglegs))),(((extra arms))),(((extra

legs))), plump,bad legs,error legs,username,blurry,bad feet, blur,

在蓝色圈内,输入任意你想画的内容,例如:猫

点击最右边紫色框圈出的内容,即Queue Prompt

按照这个流程,你就可以得到你绘画的第一次AI图片了!

AI绘画例图:

现在AI绘画还是发展初期,大家都在摸索前进。

但新事物就意味着新机会,我们普通人要做的就是抢先进场,先学会技能,这样当真正的机会来了,你才能抓得住。

如果你对AI绘画感兴趣,我可以分享我在学习过程中收集的各种教程和资料。

学完后,可以毫无问题地应对市场上绝大部分的需求。

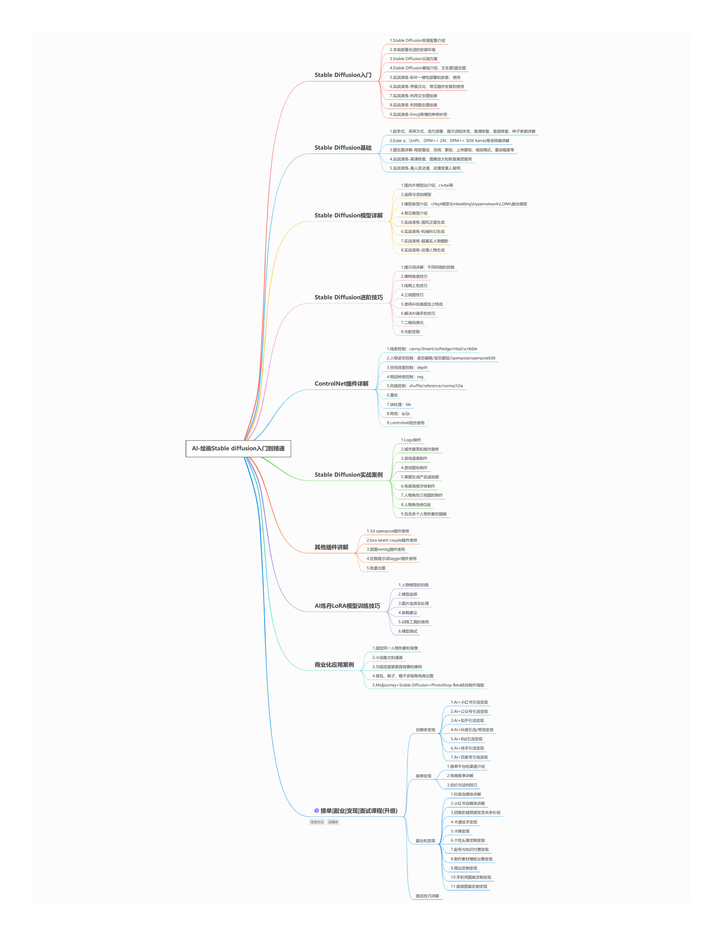

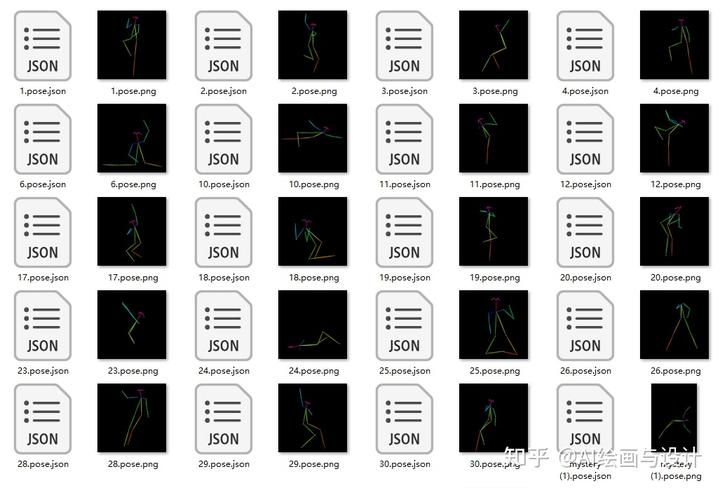

这份AI绘画资料包整理了Stable Diffusion入门学习思维导图、Stable Diffusion安装包、120000+提示词库,800+骨骼姿势图,Stable Diffusion学习书籍手册、AI绘画视频教程、AIGC实战等等。

完整版资料我已经打包好,点击下方卡片即可免费领取!

【Stable Diffusion学习路线思维导图】

【Stable Diffusion安装包(含常用插件、模型)】

【AI绘画12000+提示词库】

【AI绘画800+骨骼姿势图】

【AI绘画视频合集】

这份完整版的stable diffusion资料我已经打包好,点击下方卡片即可免费领取!

6137

6137

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?