分布式数据库:原理、架构、使用场景与实现技术

分布式数据库是一种将数据分散存储在多个物理节点(如服务器)上的数据库系统,通过协同工作提供高并发、高可用性和可扩展性。它解决了传统单机数据库在处理海量数据和高并发请求时的性能瓶颈。以下我将从原理、架构、使用场景和实现技术四个方面逐步解析,内容基于权威引用确保真实可靠。

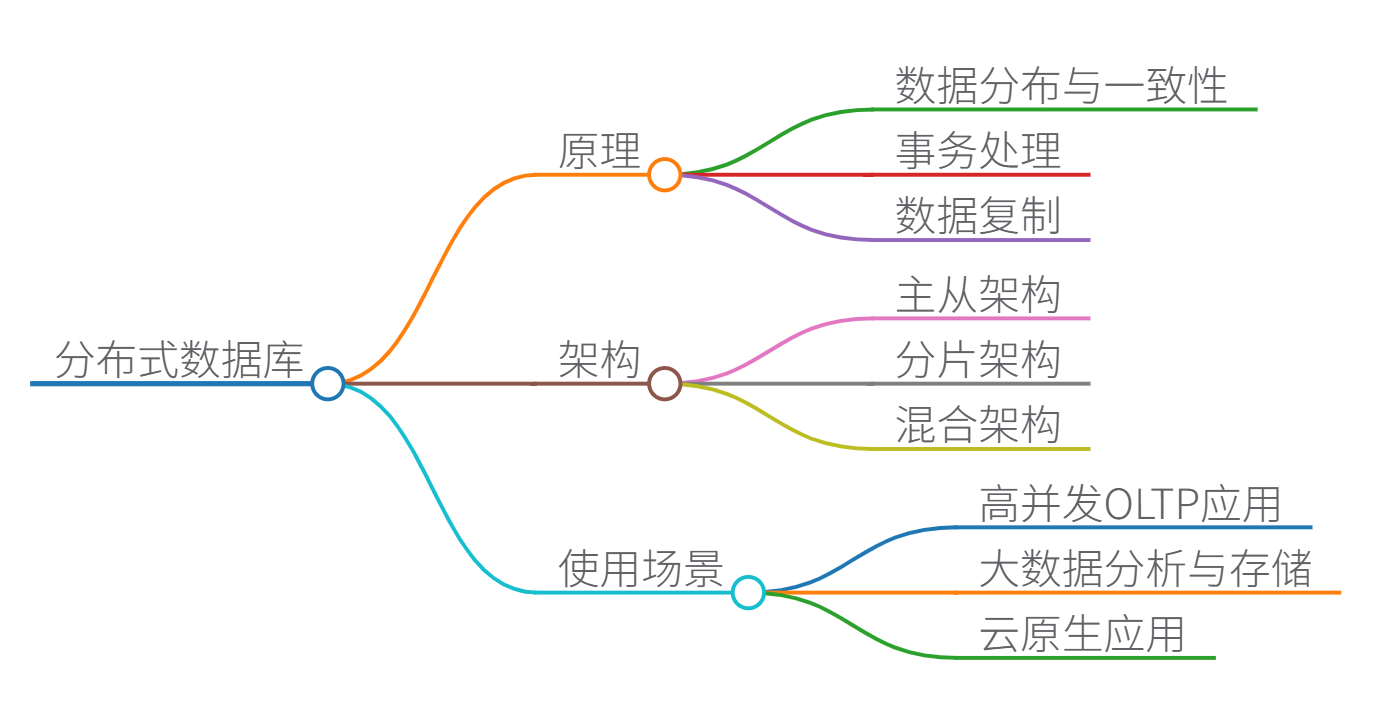

1. 原理

分布式数据库的核心原理是通过数据分布和协同处理实现高效操作。数据被分割成多个片段(分片),存储在不同节点上,系统通过一致性协议确保数据同步。关键原理包括:

- 数据分布与一致性:数据分片后,系统需保证所有节点数据一致。例如,基于CAP定理,分布式系统无法同时满足一致性(Consistency)、可用性(Availability)和分区容忍性(Partition tolerance),需根据业务需求权衡。在OLTP(联机事务处理)场景中,系统优先保证ACID事务(原子性、一致性、隔离性、持久性),例如TiDB通过分布式事务机制确保数据一致性。

- 事务处理:分布式事务采用两阶段提交(2PC)或Paxos等协议协调节点操作,确保跨节点操作的原子性。但网络延迟可能导致性能下降,需优化协议减少开销。

- 数据复制:数据在多个节点复制以提高可用性。复制分为同步(数据写入需所有节点确认,保证强一致性)和异步(写入后异步同步,提高性能但弱一致性)。

2. 架构

分布式数据库的架构设计决定了其扩展性和可靠性,常见类型包括:

- 主从架构:一个主节点负责写入操作,多个从节点负责读取和备份。主节点故障时,从节点可选举新主节点,适合读写分离场景。例如,MySQL集群采用此架构。

- 分片架构:数据按键值(如用户ID)水平分片,每个分片独立存储在不同节点。查询时,系统路由请求到对应分片,支持线性扩展。但跨分片查询需额外协调,增加延迟。

- 混合架构:结合主从和分片,例如TiDB的分片加多副本设计,既支持高并发写入,又通过Raft协议保证数据一致性。

3. 使用场景

分布式数据库适用于高并发、大数据量场景,具体包括:

- 高并发OLTP应用:如电商交易系统或金融支付平台,需处理大量实时事务。分布式数据库通过分片和负载均衡支持每秒数万次读写操作,确保低延迟响应。

- 大数据分析与存储:在数据仓库或日志分析中,系统需存储PB级数据。分布式数据库如HBase支持水平扩展,适合海量数据存储和批处理查询。

- 云原生应用:云环境中,分布式数据库提供弹性伸缩,例如Amazon DynamoDB可根据负载自动调整资源,满足突发流量需求。

- 全球化服务:跨地域部署时,数据复制减少网络延迟,例如内容分发网络(CDN)使用分布式数据库缓存用户数据。

4. 实现技术

实现分布式数据库的关键技术聚焦于数据管理、性能优化和容错:

- 数据分片与路由:数据按哈希或范围分片,路由层(如代理或协调器)将查询定向到正确节点。分片策略需避免热点问题,例如一致性哈希算法均匀分布负载。

- 复制与一致性模型:采用多副本机制,结合强一致性(如Paxos)或最终一致性(如Dynamo风格)。同步复制保证数据安全,但异步复制提升吞吐量。

- 负载均衡与故障恢复:负载均衡器动态分配请求,避免单点过载。故障时,系统自动检测并切换节点,例如通过心跳检测和自动故障转移。

- 索引优化:使用局部索引(针对单个分片)和全局索引(跨分片查询),但全局索引维护成本高。优化策略包括布隆过滤器加速查询。

- 挑战应对技术:针对网络延迟,采用批处理或压缩减少传输量;针对一致性权衡,实现可调一致性级别(如Cassandra的QUORUM机制)。

总结

分布式数据库通过分布式架构解决了单机数据库的扩展瓶颈,在电商、金融和云服务中广泛应用。其核心优势包括高并发支持、弹性伸缩和容错能力,但面临一致性权衡、网络延迟和运维复杂性等挑战。未来趋势包括云原生集成和AI驱动的自动化优化,这将进一步提升分布式数据库的实用性。

思维导图

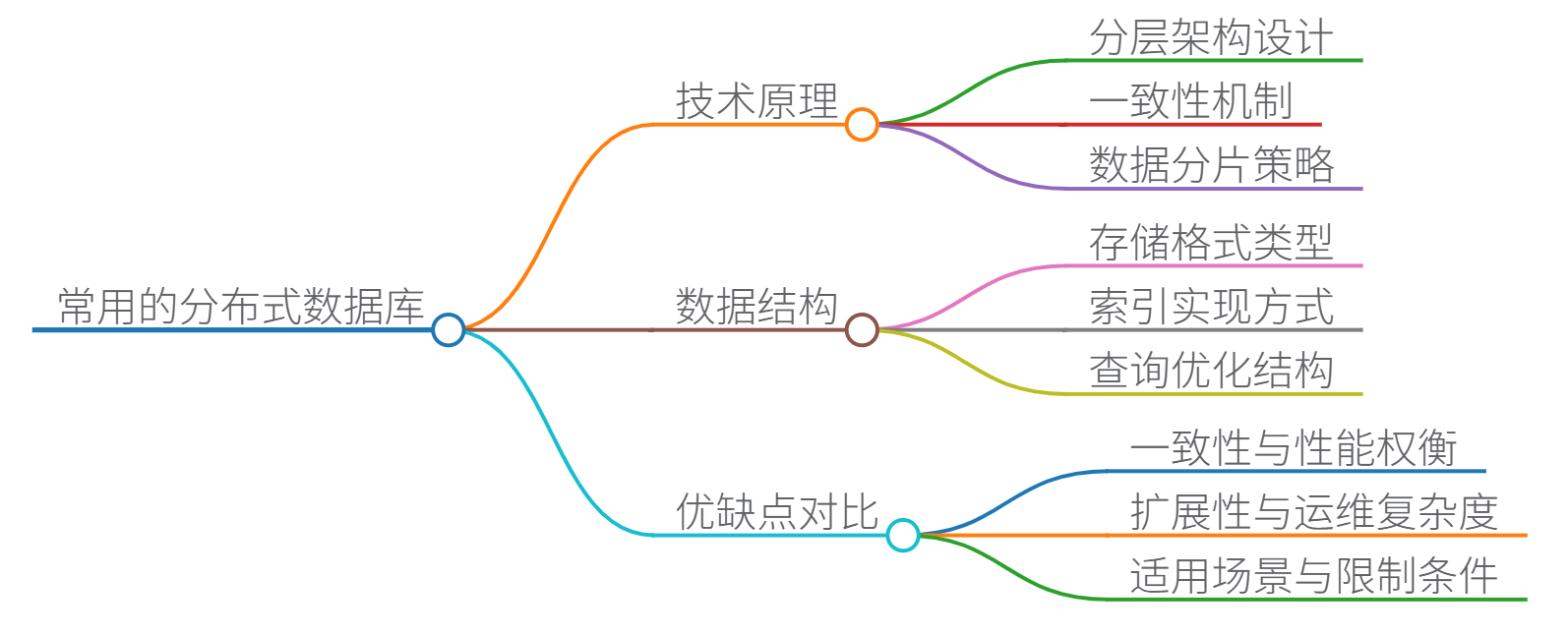

以下是主流分布式数据库的技术解析,涵盖核心原理、数据结构、算法实现及优缺点对比:

常见的分布式数据库

1. TiDB(NewSQL 代表)

技术原理:

- 分层架构:

- TiKV(存储层):基于 RocksDB(LSM-Tree)存储分片数据,通过 Raft 协议实现多副本强一致性。

- TiDB(计算层):无状态 SQL 解析层,将查询下推至存储节点。

- Placement Driver (PD):中央调度器,管理分片位置与负载均衡(基于 Raft + 心跳检测)。

- 事务模型:

- 采用 Percolator 事务算法(基于 2PC + 乐观锁),通过全局时间戳(TSO)保证分布式事务的 ACID。

数据结构:

- 数据按 Range 分片(连续键值区间),支持动态分裂合并。

- 索引:全局二级索引通过异步写入避免跨节点事务。

优点:

- 强一致性,兼容 MySQL 协议

- 水平扩展性(PB 级数据)

- 支持 HTAP(混合事务/分析处理)

缺点:

- 跨分片事务延迟较高(2PC 开销)

- 中央调度器 PD 可能成为瓶颈

2. Apache Cassandra(宽列存储)

技术原理:

- 分布式模型:

- P2P 架构:无中心节点,通过 Gossip 协议同步节点状态。

- 分区策略:一致性哈希(

Token Ring)分配数据分片,虚拟节点(VNode)避免热点。

- 一致性机制:可调一致性级别(如

QUORUM = (N/2)+1),基于 Last-Write-Wins(LWW)解决冲突。

数据结构:

- SSTable(Sorted String Table):磁盘存储结构,配合 MemTable 实现高速写入。

- 布隆过滤器:加速 SSTable 的键值查询。

优点:

- 高写入吞吐(百万级/秒)

- 无单点故障,跨数据中心复制

- 灵活的一致性权衡

缺点:

- 范围查询效率低(需扫描多个节点)

- 无跨分片事务支持

3. MongoDB Sharding(文档数据库)

技术原理:

- 分片架构:

- 路由层(mongos):解析查询并路由到分片(基于分片键哈希或范围)。

- 配置服务器:存储分片元数据(基于 Raft 选主)。

- 数据分布:分片键(Shard Key)决定数据分布,支持自动分片分裂(Chunk Migration)。

数据结构:

- BSON(Binary JSON):文档存储格式,支持嵌套结构。

- WiredTiger 引擎:B+树索引,支持文档级并发控制。

优点:

- 灵活的数据模型(JSON 文档)

- 自动化分片平衡

- 地理空间索引等高级查询

缺点:

- 分片键设计不当易导致热点

- 跨分片事务需 v4.2+ 且性能受限

4. CockroachDB(兼容 PostgreSQL)

技术原理:

- 全局有序键值存储:数据按范围分片,每分片构成 Raft 组(默认 3 副本)。

- 分布式 SQL 引擎:查询计划拆解为跨节点并行执行。

- 事务模型:

- 并行提交(Parallel Commits):优化 2PC 延迟,结合 HLC(混合逻辑时钟)保证一致性。

优点:

- 强一致性 + 高容错(自动数据重分布)

- 支持地理分布式部署

缺点:

- 复杂查询性能依赖本地化执行

- 运维复杂度高

5. Amazon DynamoDB(云托管 KV 存储)

技术原理:

- 分区管理:

- 数据按哈希键自动分片,分区键(Partition Key)决定物理位置。

- 通过 虚拟节点(VNode) 动态调整分区数量。

- 一致性模型:

- 可选强一致性(读最新副本)或最终一致性(读任意副本)。

数据结构:

- LSM-Tree 引擎:高写入吞吐,后台 Compaction 合并数据。

优点:

- 自动扩缩容(按请求量付费)

- 毫秒级延迟(SSD 后端)

缺点:

- 查询灵活性差(仅主键/索引查询)

- 成本随规模线性增长

对比总结

| 数据库 | 一致性模型 | 分片策略 | 适用场景 |

|---|---|---|---|

| TiDB | 强一致(Raft) | Range | OLTP + 实时分析 |

| Cassandra | 最终一致/可调 | 一致性哈希 | 高写入、低查询延迟 |

| MongoDB | 最终一致 | 哈希/范围 | JSON 文档处理 |

| CockroachDB | 强一致(Raft) | Range | 全球化部署 |

| DynamoDB | 可调一致性 | 哈希 | 云原生无运维 |

关键取舍:

- 强一致系统(如 TiDB)牺牲部分写入延迟换取数据安全;

- 最终一致系统(如 Cassandra)用更高吞吐换取潜在数据冲突。

思维导图

788

788

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?