(一)Spark SQL基础简介

• Spark SQL是Apache Spark大数据框架一部分,主要用于处理结构化数据和对spark数据执行类sql的查询• Spark为其提供了一个称为DataFrame的编程抽象,充当分布式SQL查询引擎

• Spark SQL功能:

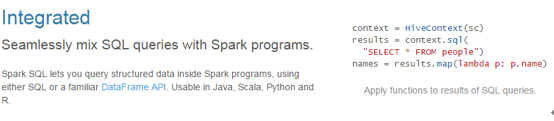

– 集成:无缝将SQL查询与Spark程序混合

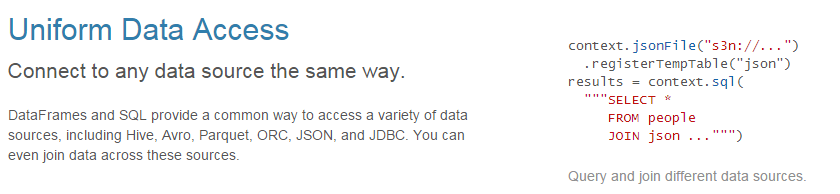

– 统一数据访问:加载来自各种来源的数据

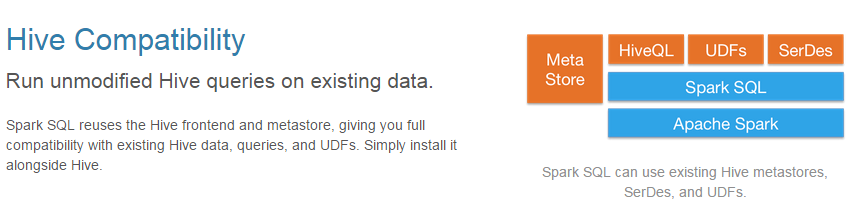

– 兼容性:Spark SQL重用Hive前端和MetaStore,与现有Hive数据、查询和UDF的安全兼容,只需要和Hive一起安装即可

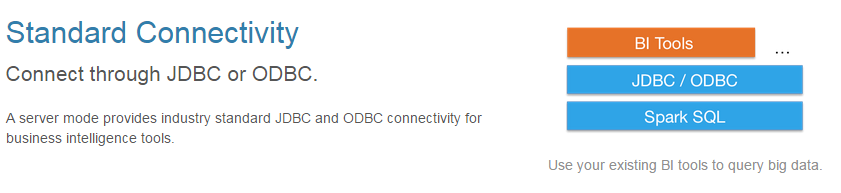

– 标准连接:JDBC和ODBC

– 扩展性:对交互式查询和长查询使用相同的引擎,Spark SQL利用RDD模型来支持查询容错,使其扩展大大型作业

(二)Spark SQL框架

– 把数据读入到SparkSQL中,SparkSQL进行数据处理或算法实现,然后再把处理后的数据输出到相应的输出源

– Input:

• 数据源丰富:Hive、json、txt、JDBC等

• Spark SQL存在两个类进行对接:HiveContext和SQLContext,其中HiveContext继承了SQLContext的所有方法,同时又进行扩展

• SQLContext用于对接绝大多类型数据源, HiveContext是SQLContext的超集

• Spark SQL处理读入的数据,采用的是DataFrame中提供的方法

(三)DataFrame

1 什么是DataFrames

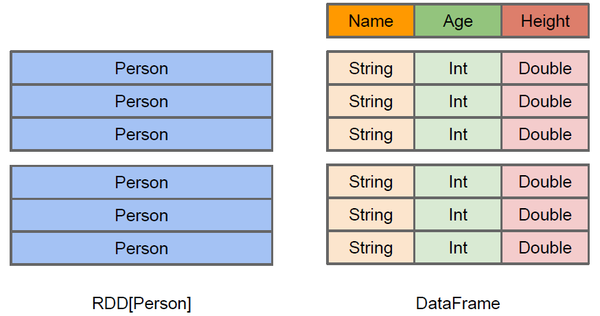

与RDD类似,DataFrame也是一个分布式数据容器。然而DataFrame更像传统数据库的二维表格,除了数据以外,还记录数据的结构信息,即schema。同时,与Hive类似,DataFrame也支持嵌套数据类型(struct、array和map)。从API易用性的角度上 看,DataFrame API提供的是一套高层的关系操作,比函数式的RDD API要更加友好,门槛更低。由于与R和Pandas的DataFrame类似,SparkDataFrame很好地继承了传统单机数据分析的开发体验。

• 作为2014–2015年Spark最大的API改动,DataFrame能够使得大数据更为简单• 之前Spark SQL API的SchemaRDD已经更名为DataFrame

• 分布式的数据集合,按照命名列的形式组织数据

• 通过调用将DataFrame的内容作为行RDD(RDD of Rows)返回的rdd方法,可以将DataFrame转换成RDD

• 通过如下方式创建DataFrame:

– 已有RDD

– 结构化数据文件

– Json数据

– Hive表

– 外部数据库

• RDD以record为单位,spark优化时无法洞悉record内部的细节,无法深度优化,限制sparkSQL性能的提升;DataFrame包含了每个record的metadata元数据信息,DataFrame的优化可以对列内部优化

• DataFrame是一个以命名列方式组织的分布式数据集,等同于关系型数据库中的一个表

• DataFrame是基于RDD的抽象

• DataFrame的底层结构是RDD. Spark在你使用DataFrame时会优化你的代码

• Spark对于DataFrame在执行时间和内存使用上对于RDD有极大的优化

– Catalyst优化引擎:使得执行时间减少75%

– Project Tungsten Off-heap内存管理:是内存使用量减少75%,无垃圾回收器

• 使用python及scala执行RDD的速度明显比DataFrame慢

• 但同样对于DataFrame,两种语言没有区别,两者性能均优于普通Python RDD实现的4倍,也达到了Scala RDD实现的两倍

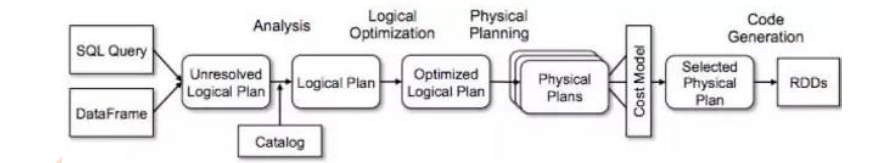

2、优化引擎 Catalyst

• SQL优化器核心执行策略两个方向:规则和代价• 基于规则:经验式、启发式地优化思路,更多地依靠前辈总结出来的优化规则,简单易行且能够覆盖到大部分优化逻辑

• 基于代价:核心算子优化

两个表执行Join应该使用BroadcastHashJoin还是SortMergeJoin?

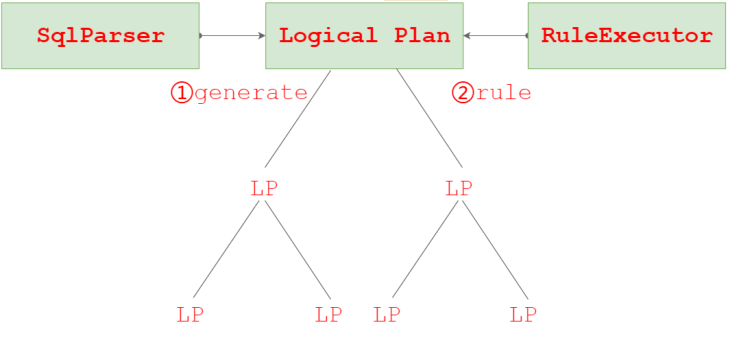

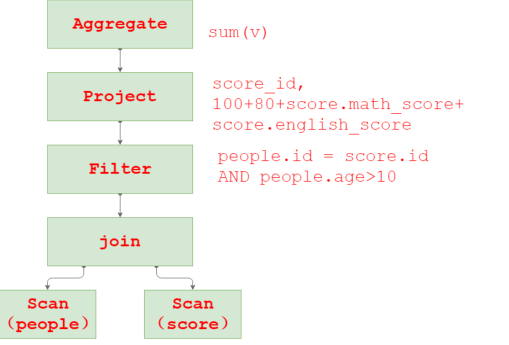

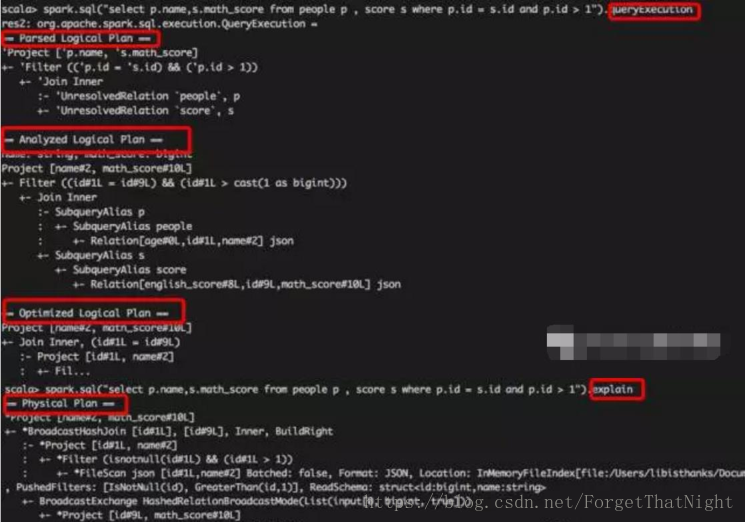

3、实现分析 Parser(解析器)

SqlParser生成LogicPlan Tree– 主要先进行词法分析,再进行语法分析

• 词法分析:讲输入的sql语句串解析为一个一个的token

• 语法分析:再词法分析基础上,将单词序列组合成各类语法短语,组成各个LogicPlan

– 例子:将生成如图所示的解析树

• SELECT sum(v)

• FROM(

• SELECT score.id,

• 100+80+score.math_score+score.english_score AS v

• FROM people JOIN score

• WHERE people.id=score.id

• AND people.age>10

• )tmp

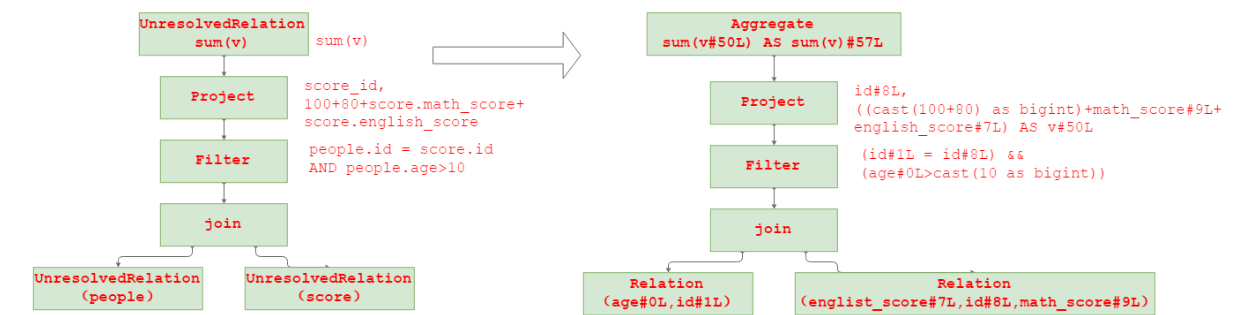

4、实现分析• Analyzer

遍历整个语法树,对树上的每个节点进行数据类型绑定以及函数绑定– 根据元数据表解析为包含必要列的表,并且相应字段解析为相应的数据类型,相应的计算逻辑解析为对应的函数

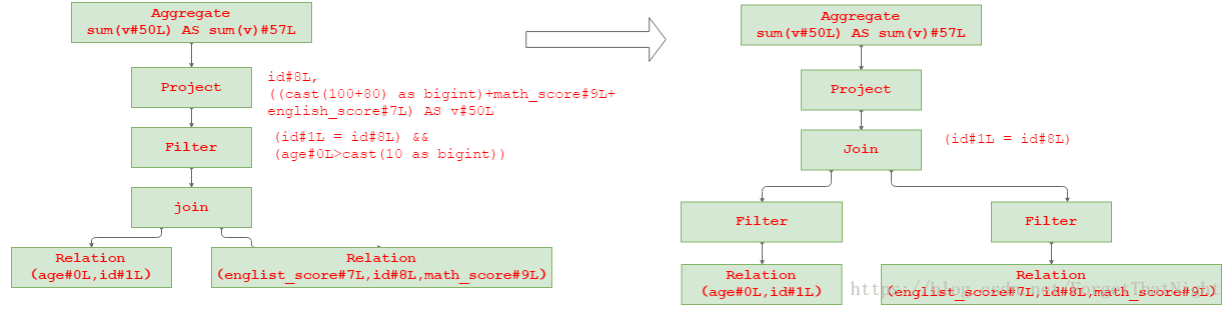

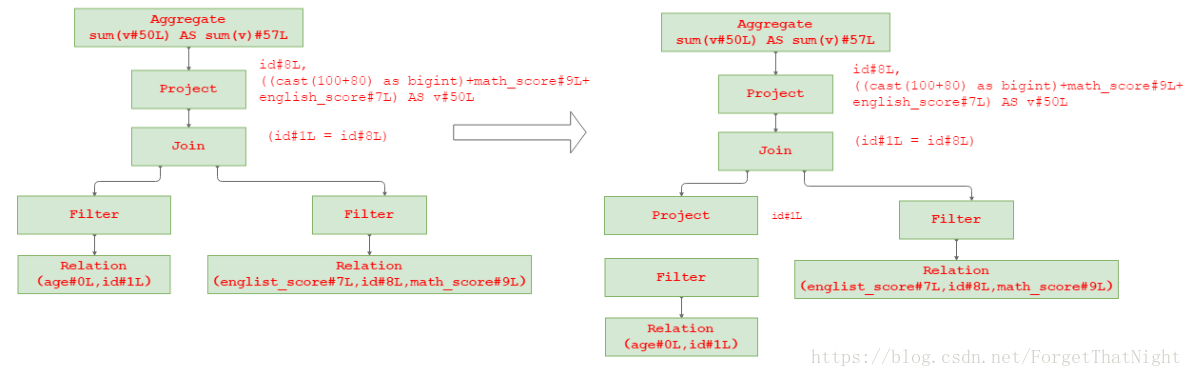

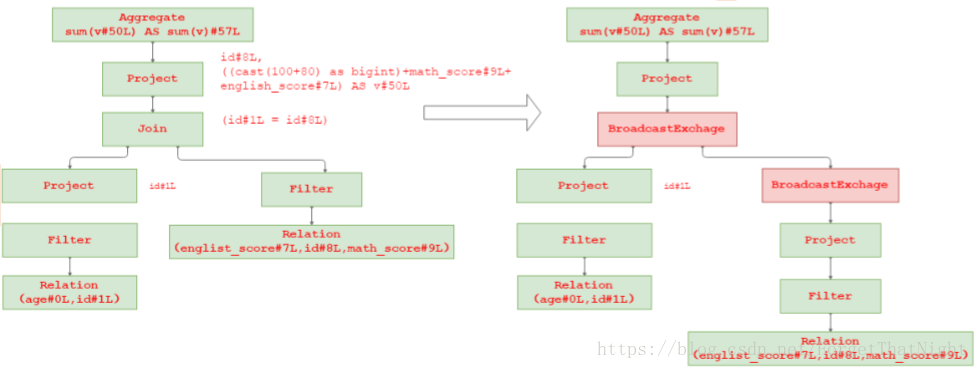

5 、实 现 分 析• Optimizer

是Catalyst的核心– 基于规则优化实际上对语法树再做一次遍历,模式匹配能够满足特定细节的节点,再进行相应的等价变变换

– 经典规则:谓词下推(Predicate Pushdown)、常量累加(Constant Folding)和列值裁剪(Column Pruning)

6、实 现 分 析• Physical Planning

物理计划层– 用物理操作算子产生一个或者多个物理计划。然后用cost模型选择一个物理计划。目前基于cost-based的优化仅仅用于选择join算法:对已知的很小的relations,sparksql会选择使用spark的提供的点对点的广播功能实现Broadcastjoin

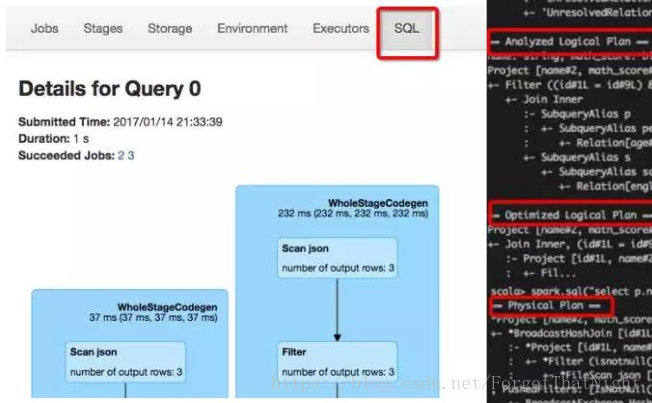

7、实 现 分 析• Spark SQL执行计划

• 使用queryExecution方法查看

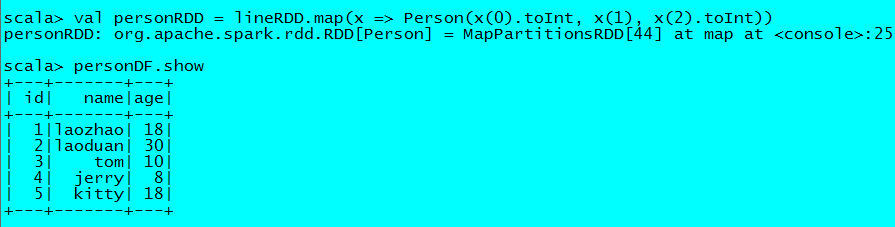

8、创建DataFrame

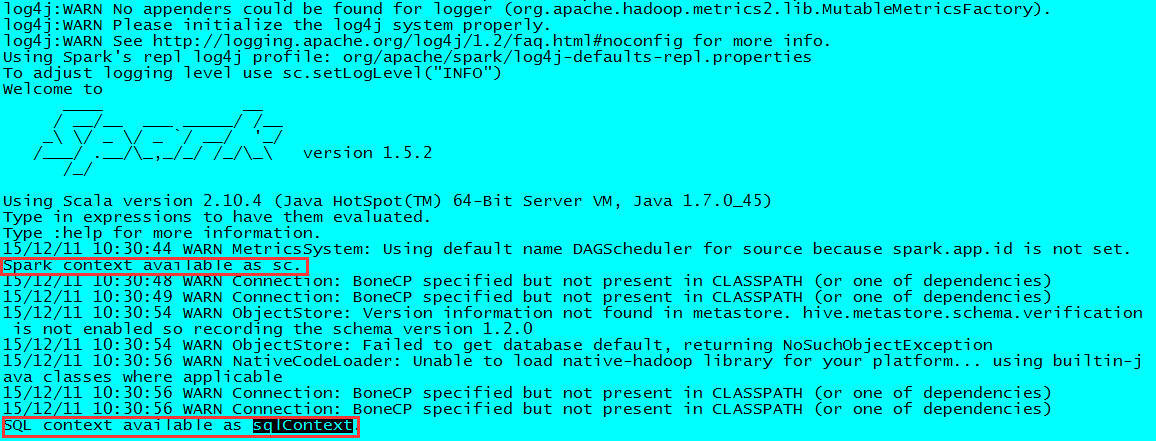

在Spark SQL中SQLContext是创建DataFrames和执行SQL的入口

hdfs dfs -putperson.txt /

2.在spark shell执行下面命令,读取数据,将每一行的数据使用列分隔符分割

val lineRDD =sc.textFile("hdfs://node1.itcast.cn:9000/person.txt").map(_.split(""))

3.定义case class(相当于表的schema)

case classPerson(id:Int, name:String, age:Int)

4.将RDD和case class关联

val personRDD =lineRDD.map(x => Person(x(0).toInt, x(1), x(2).toInt))

5.将RDD转换成DataFrame

val personDF =personRDD.toDF

6.对DataFrame进行处理

personDF.show

9 DataFrame常用操作

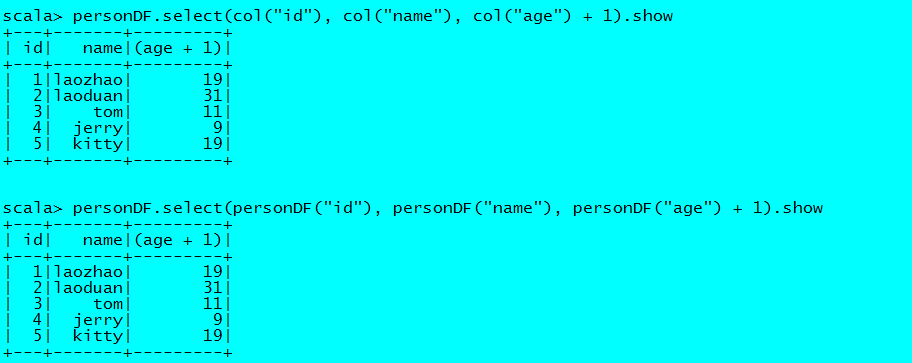

9.1. DSL风格语法

//查看DataFrame中的内容

personDF.show//查看DataFrame部分列中的内容

personDF.select(personDF.col("name")).show

personDF.select(col("name"),col("age")).show

personDF.select("name").show//打印DataFrame的Schema信息

personDF.printSchema//查询所有的name和age,并将age+1

personDF.select(col("id"),col("name"), col("age") + 1).show

personDF.select(personDF("id"),personDF("name"), personDF("age") + 1).show

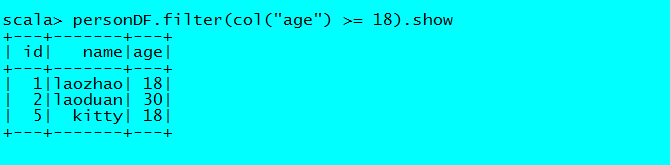

//过滤age大于等于18的

personDF.filter(col("age")>= 18).show

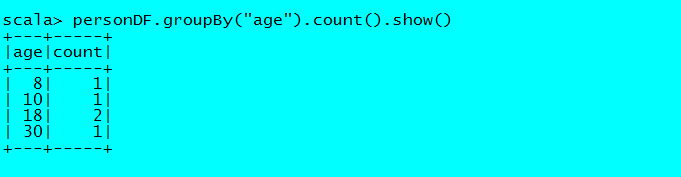

//按年龄进行分组并统计相同年龄的人数

personDF.groupBy("age").count().show()

9.2. SQL风格语法

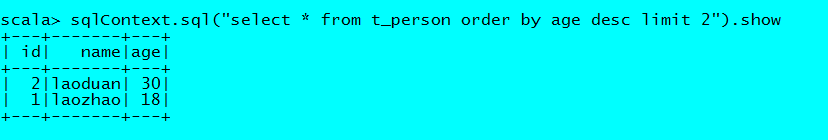

如果想使用SQL风格的语法,需要将DataFrame注册成表personDF.registerTempTable("t_person")sqlContext.sql("select* from t_person order by age desc limit 2").show

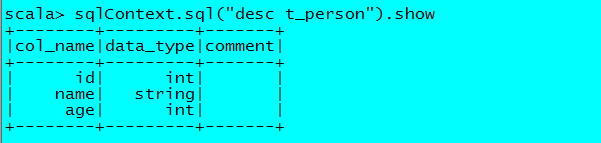

//显示表的Schema信息

sqlContext.sql("desct_person").show

(四) 以编程方式执行Spark SQL查询

1. 编写Spark SQL查询程序

前面我们学习了如何在Spark Shell中使用SQL完成查询,现在我们来实现在自定义的程序中编写Spark SQL查询程序。首先在maven项目的pom.xml中添加Spark SQL的依赖

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-sql_2.10</artifactId>

<version>1.5.2</version>

</dependency>

1.1. 通过反射推断Schema

创建一个object为cn.itcast.spark.sql.InferringSchema

package cn.itcast.spark.sql

import org.apache.spark.{SparkConf, SparkContext}

import org.apache.spark.sql.SQLContext

object InferringSchema {

def main(args: Array[String]) {

//创建SparkConf()并设置App名称

val conf = new SparkConf().setAppName("SQL-1")

//SQLContext要依赖SparkContext

val sc = new SparkContext(conf)

//创建SQLContext

val sqlContext = new SQLContext(sc)

//从指定的地址创建RDD

val lineRDD = sc.textFile(args(0)).map(_.split(" "))

//创建case class

//将RDD和case class关联

val personRDD = lineRDD.map(x => Person(x(0).toInt, x(1), x(2).toInt))

//导入隐式转换,如果不到人无法将RDD转换成DataFrame

//将RDD转换成DataFrame

import sqlContext.implicits._

val personDF = personRDD.toDF

//注册表

personDF.registerTempTable("t_person")

//传入SQL

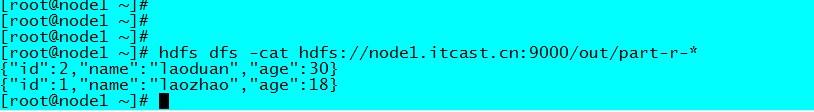

val df = sqlContext.sql("select * from t_person order by age desc limit 2")

//将结果以JSON的方式存储到指定位置

df.write.json(args(1))

//停止Spark Context

sc.stop()

}

}

//case class一定要放到外面

case class Person(id: Int, name: String, age: Int)

/usr/local/spark-1.5.2-bin-hadoop2.6/bin/spark-submit \

--class cn.itcast.spark.sql.InferringSchema \

--master spark://node1.itcast.cn:7077 \

/root/spark-mvn-1.0-SNAPSHOT.jar \

hdfs://node1.itcast.cn:9000/person.txt \

hdfs://node1.itcast.cn:9000/out

hdfs dfs -cat hdfs://node1.itcast.cn:9000/out/part-r-*

1.2. 通过StructType直接指定Schema

创建一个object为cn.itcast.spark.sql.SpecifyingSchema

package cn.itcast.spark.sql

import org.apache.spark.sql.{Row, SQLContext}

import org.apache.spark.sql.types._

import org.apache.spark.{SparkContext, SparkConf}

/**

* Created by ZX on 2015/12/11.

*/

object SpecifyingSchema {

def main(args: Array[String]) {

//创建SparkConf()并设置App名称

val conf = new SparkConf().setAppName("SQL-2")

//SQLContext要依赖SparkContext

val sc = new SparkContext(conf)

//创建SQLContext

val sqlContext = new SQLContext(sc)

//从指定的地址创建RDD

val personRDD = sc.textFile(args(0)).map(_.split(" "))

//通过StructType直接指定每个字段的schema

val schema = StructType(

List(

StructField("id", IntegerType, true),

StructField("name", StringType, true),

StructField("age", IntegerType, true)

)

)

//将RDD映射到rowRDD

val rowRDD = personRDD.map(p => Row(p(0).toInt, p(1).trim, p(2).toInt))

//将schema信息应用到rowRDD上

val personDataFrame = sqlContext.createDataFrame(rowRDD, schema)

//注册表

personDataFrame.registerTempTable("t_person")

//执行SQL

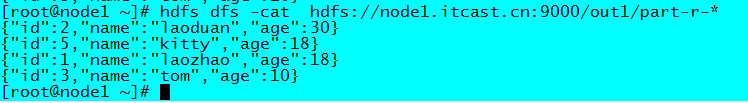

val df = sqlContext.sql("select * from t_person order by age desc limit 4")

//将结果以JSON的方式存储到指定位置

df.write.json(args(1))

//停止Spark Context

sc.stop()

}

}

将程序打成jar包,上传到spark集群,提交Spark任务

/usr/local/spark-1.5.2-bin-hadoop2.6/bin/spark-submit \

--class cn.itcast.spark.sql.InferringSchema \

--master spark://node1.itcast.cn:7077 \

/root/spark-mvn-1.0-SNAPSHOT.jar \

hdfs://node1.itcast.cn:9000/person.txt \

hdfs://node1.itcast.cn:9000/out1

查看结果

hdfs dfs -cat hdfs://node1.itcast.cn:9000/out1/part-r-*

(五)数据源

1. JDBC

Spark SQL可以通过JDBC从关系型数据库中读取数据的方式创建DataFrame,通过对DataFrame一系列的计算后,还可以将数据再写回关系型数据库中。

1.1. 从MySQL中加载数据(Spark Shell方式)

1.启动Spark Shell,必须指定mysql连接驱动jar包/usr/local/spark-1.5.2-bin-hadoop2.6/bin/spark-shell\

--masterspark://node1.itcast.cn:7077 \

--jars/usr/local/spark-1.5.2-bin-hadoop2.6/mysql-connector-java-5.1.35-bin.jar \

--driver-class-path/usr/local/spark-1.5.2-bin-hadoop2.6/mysql-connector-java-5.1.35-bin.jarval jdbcDF = sqlContext.read.format("jdbc").options(Map("url"-> "jdbc:mysql://192.168.10.1:3306/bigdata", "driver"-> "com.mysql.jdbc.Driver", "dbtable" ->"person", "user" -> "root","password" -> "123456")).load()jdbcDF.show()

1.2. 将数据写入到MySQL中(打jar包方式)

1.编写Spark SQL程序

package cn.itcast.spark.sql

import java.util.Properties

import org.apache.spark.sql.{SQLContext, Row}

import org.apache.spark.sql.types.{StringType, IntegerType, StructField, StructType}

import org.apache.spark.{SparkConf, SparkContext}

object JdbcRDD {

def main(args: Array[String]) {

val conf = new SparkConf().setAppName("MySQL-Demo")

val sc = new SparkContext(conf)

val sqlContext = new SQLContext(sc)

//通过并行化创建RDD

val personRDD = sc.parallelize(Array("1 tom 5", "2 jerry 3", "3 kitty 6")).map(_.split(" "))

//通过StructType直接指定每个字段的schema

val schema = StructType(

List(

StructField("id", IntegerType, true),

StructField("name", StringType, true),

StructField("age", IntegerType, true)

)

)

//将RDD映射到rowRDD

val rowRDD = personRDD.map(p => Row(p(0).toInt, p(1).trim, p(2).toInt))

//将schema信息应用到rowRDD上

val personDataFrame = sqlContext.createDataFrame(rowRDD, schema)

//创建Properties存储数据库相关属性

val prop = new Properties()

prop.put("user", "root")

prop.put("password", "123456")

//将数据追加到数据库

personDataFrame.write.mode("append").jdbc("jdbc:mysql://192.168.10.1:3306/bigdata", "bigdata.person", prop)

//停止SparkContext

sc.stop()

}

}

2.用maven将程序打包

3.将Jar包提交到spark集群

/usr/local/spark-1.5.2-bin-hadoop2.6/bin/spark-submit\

--classcn.itcast.spark.sql.JdbcRDD \

--masterspark://node1.itcast.cn:7077 \

--jars/usr/local/spark-1.5.2-bin-hadoop2.6/mysql-connector-java-5.1.35-bin.jar \

--driver-class-path /usr/local/spark-1.5.2-bin-hadoop2.6/mysql-connector-java-5.1.35-bin.jar\

/root/spark-mvn-1.0-SNAPSHOT.jar

709

709

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?