安装:pip install pyspark

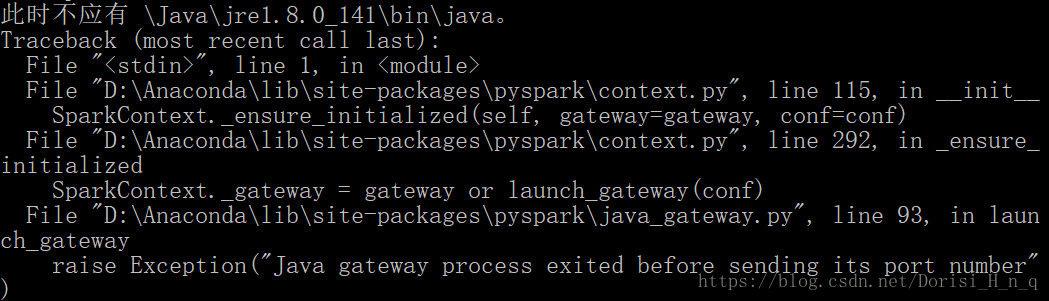

Windows下使用pycharm的spark库,直接在工具库下载即可,但发现运行报错:

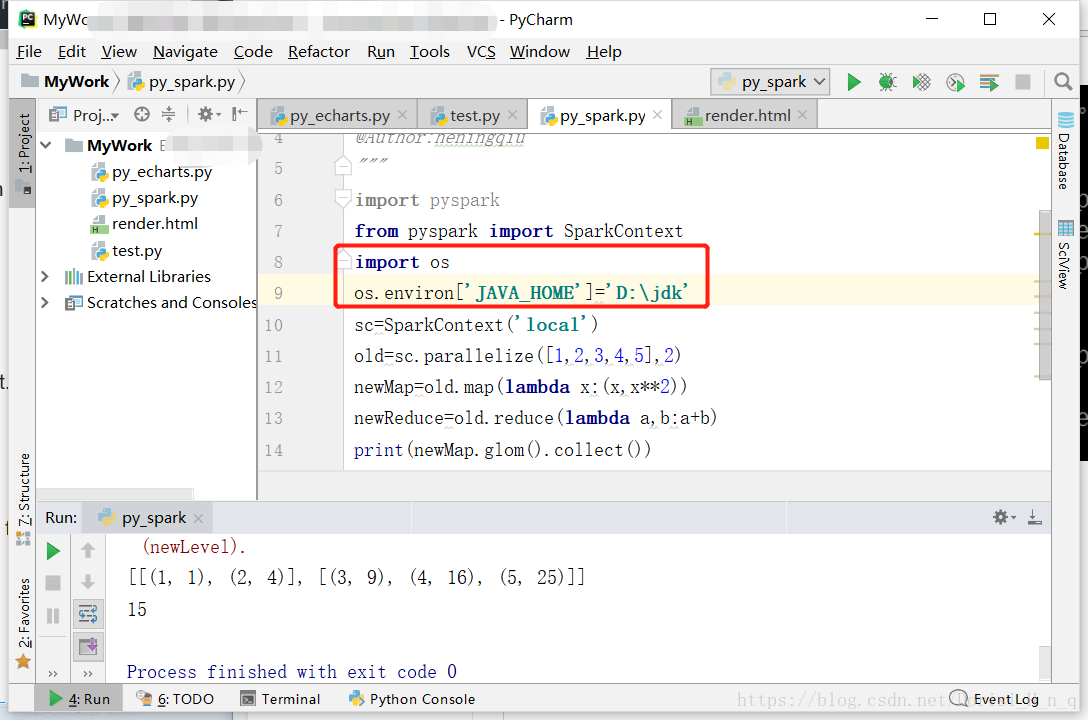

解决方案:

导入os模块,然后代码中添加,=号后面的地址主要看你JDK的地址,按个人地址为主,我的地址只做参考:

import os

os.environ['JAVA_HOME']='D:\jdk'

import pyspark

from pyspark import SparkContext

import os

os.environ['JAVA_HOME']='D:\jdk'

sc=SparkContext('local')

old=sc.parallelize([1,2,3,4,5],2)

newMap=old.map(lambda x:(x,x**2))

newReduce=old.reduce(lambda a,b:a+b)

print(newMap.glom().collect())

print(newReduce)

315

315

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?