DeepSeek作为一款功能强大的AI工具,在处理各类信息与任务方面表现理想,深受广大用户喜爱。想要在电脑上安装DeepSeek,不少人却被复杂的流程难住。别着急,接下来不仅会为大家详细讲解DeepSeek的安装流程,让安装变得超简单,3分钟轻松搞定,彻底告别踩坑!

一、常规安装DeepSeek的步骤

(一)准备工作

基础级7B模型:需16GB内存、RTX 4060显卡;

高性能14B模型:需32GB内存、RTX 4090显卡;

极致32B模型:需64GB内存、RTX 5090 D(32GB显存)。

(二)安装方式

使用LM Studio部署

1. 官网下载对应系统版本,默认安装,在设置中切换中文界面;

2. 打开软件,选择并下载DeepSeek模型,加载后即可使用。

使用Ollama部署

1. 官网下载安装程序,按提示安装,通过终端命令验证安装成功;

2. 找到模型并复制命令行,在终端粘贴运行以下载激活模型;

3. 可安装Chrome扩展“PageAssist”获取可视化界面,设置语言后选择模型对话。

二、DS本地部署大师介绍

要是觉得常规安装步骤繁琐,DS本地部署大师也是你的救星之一。这是一款专门为AI模型本地化部署打造的工具,能把DeepSeek等模型部署到本地设备,让你摆脱对云端服务器的依赖。该软件操作界面简洁易懂,支持DeepSeek、豆包、文心一言等大模型。

三、DS本地部署大师安装操作步骤

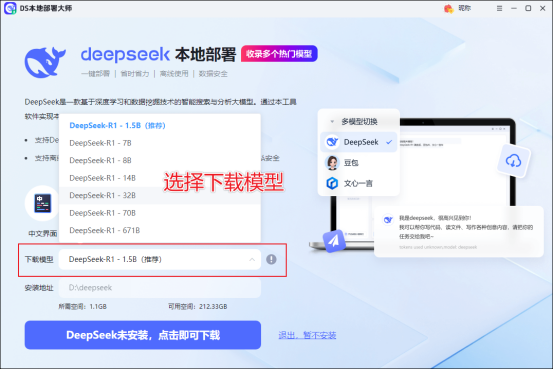

在官方网站上,下载安装成功后,打开软件,软件内部已经预置了多种DeepSeek模型选项。

在软件中,点击【模型】软件贴心地提供了不同版本供用户选择,用户可以根据自己电脑的硬件配置来挑选。找到合适的模型后,点击下方的“点击即可下载”。

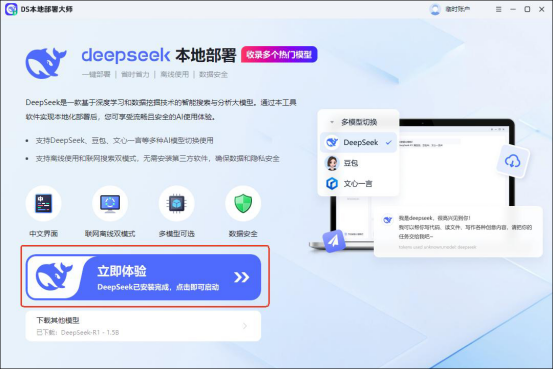

软件会自动完成DeepSeek模型在本地环境的配置和安装,部署完成后,页面下方会显示“立即体验”。

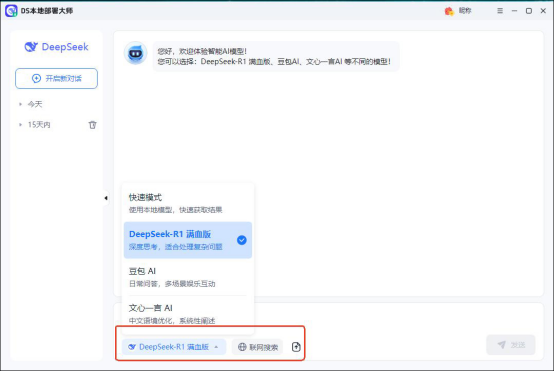

点击后就会进入到AI对话界面,此时就可以开始与DeepSeek进行提问、对话、创作啦,尽情享受它带来的便捷服务。

通过上述方法,无论是常规安装还是借助DS本地部署大师,都能顺利在电脑上安装DeepSeek。如果想要更轻松、便捷地完成安装,强烈推荐试试DS本地部署大师,让安装变得简单。

电脑安装DeepSeek全流程指南

电脑安装DeepSeek全流程指南

4130

4130

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?