1. 闻达语言模型平台介绍

闻达模型具体介绍参阅官方github地址:

闻达github地址:https://github.com/wenda-LLM/wenda

2. 环境准备

基于chatGLM-6B、text2vec-large-chinese两种模型部署闻达平台,并实现本地知识库搭建。

2.1. 依赖环境准备

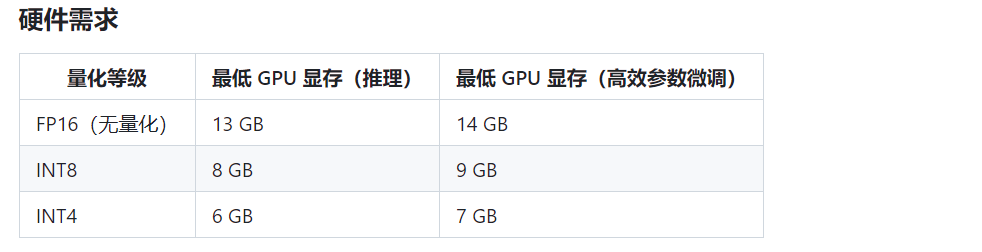

硬件:显存大于6g以上的显卡,chatGLM-6B在量化等级为INT4,最小可以在6g显存上运行

软件:

- 操作系统centos7.9

- python 3.9.16版本(安装文档,运维提供)

- pip包管理工具(安装文档,运维提供)

- git(安装文档,运维提供)

- 显卡驱动,cuda安装包会包含显卡驱动,也可以手动安装,版本需要到官网上查(下载 NVIDIA 官方驱动 | NVIDIA)

- cuda,11.8版本(CUDA Toolkit Archive | NVIDIA Developer)(安装文档,运维提供)

- 需要安装anaconda3

http://www.taodudu.cc/news/show-3892930.html?action=onClick

- pytorch,版本需要cuda配套(Previous PyTorch Versions,该页面是官方pythorch和cuda版本对应的下载地址,根据该页面安装)(安装文档,运维提供)

- 一定要下载这个版本不然不能用CUDA进行加速计算 (深坑)

pip install torch==2.0.0+cu118 torchvision==0.15.1+

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

396

396

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?