Windsurf快速上手项目

- 使用AI和相关工具快速理解项目架构和交互流程

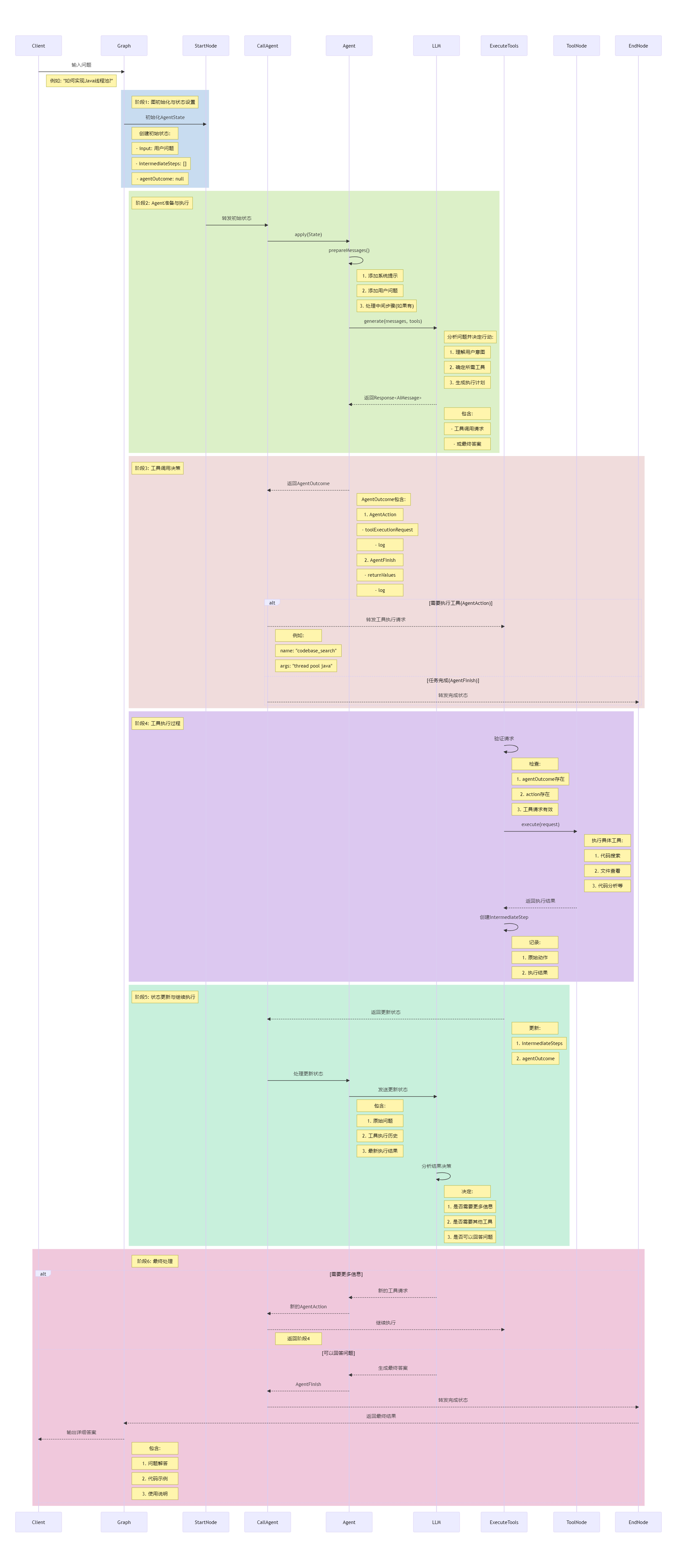

以开源LangGraph4j项目为示例: 使用windsurf根据项目输出项目时序图

- IDE工具: Windsurf Editor by Codeium

- mermaid在线生成工具: 中文Mermaid - 流程图、关系图在线画图、生成和编辑器

时序图:

- 阅读开源sdk源码, 辅助快速理解官方文档

- agent模式编写基础业务代码: 自动检索业务相关代码, 自动编辑多个相关文件, review代码变更后accept变更代码, 后续再到IDEA中进行调试修改.

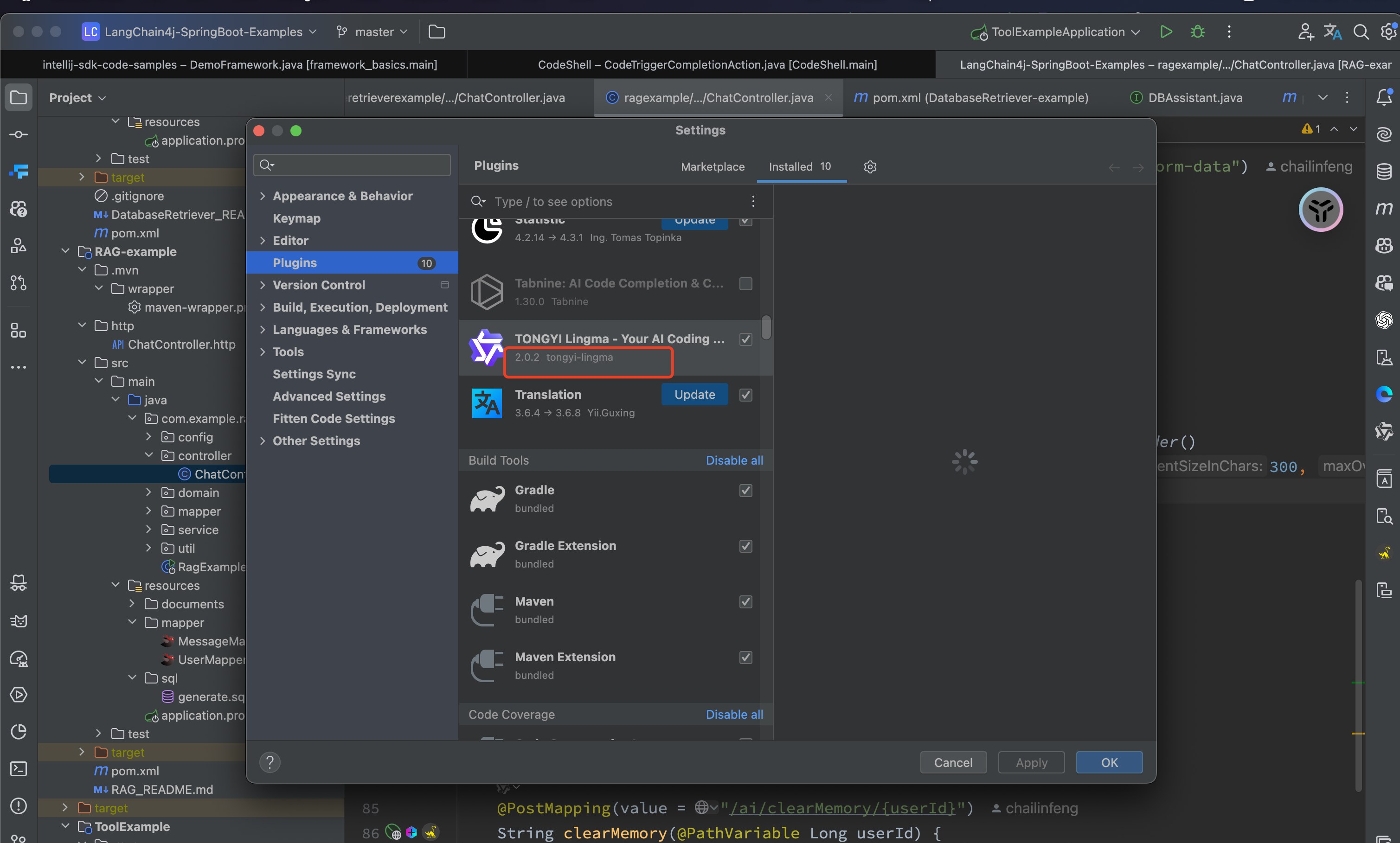

IDEA插件

IDEA代码补全的插件很多, 但是目前只有通义灵码2.0(AI程序员Beta版)具备tools的模式进行文件编辑形式自动填充代码.

通义灵码

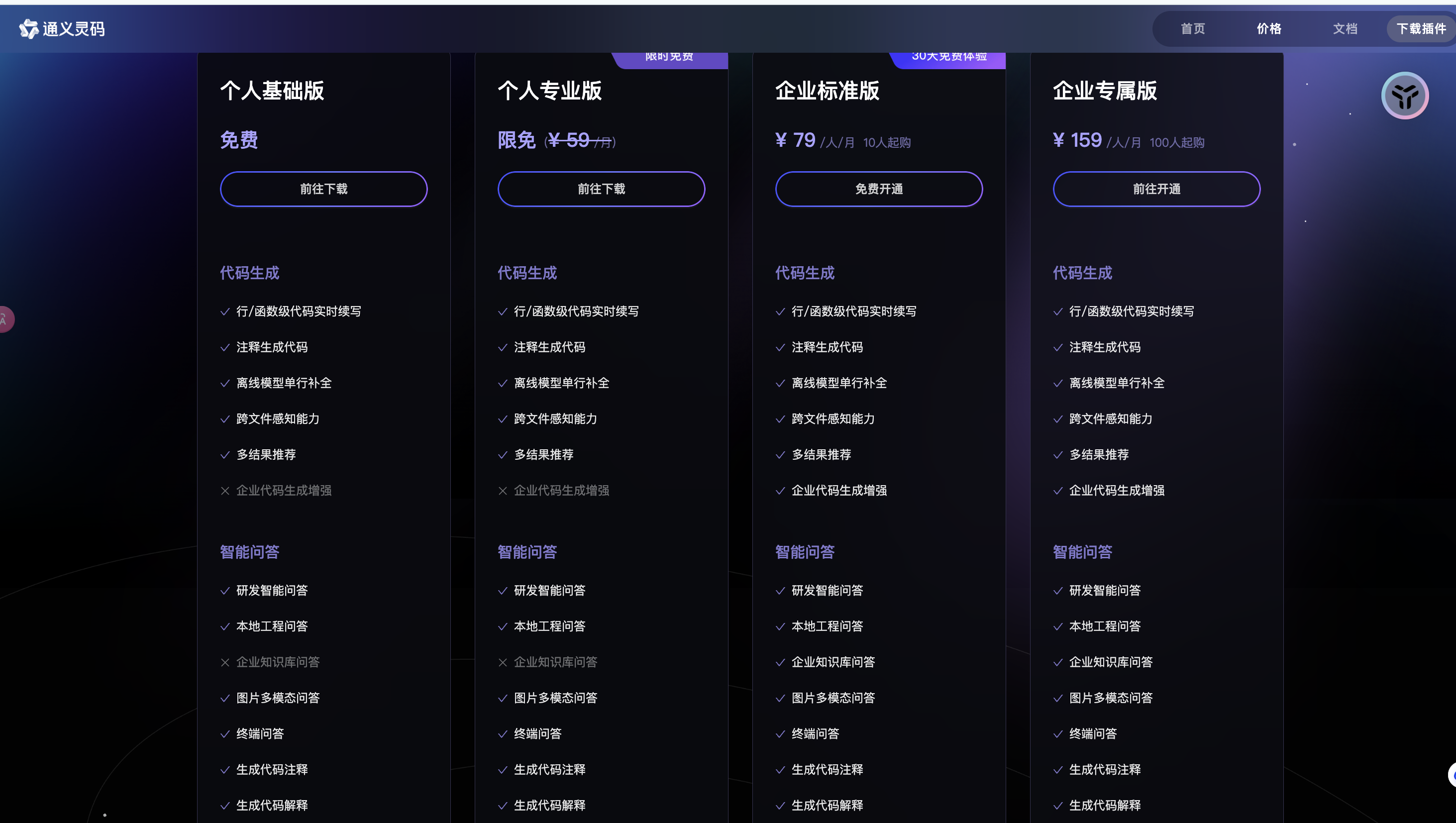

个人专业版

个人专业版目前是限免, 具备AI程序员功能, 推荐使用.其他AI插件具备的功能基本上都有, 代码补全, 智能问答等.

总体而言没有windsurf和cursor智能, 目前自动编辑文件生成的代码错误率比较高, 基本不可能一次性生成成功, 但是对于简单的增删改查和代码工具可以提升一定的效率.

更倾向于在cursor或windsurf中进行agent模式编辑需求完成后, 再到IDEA中进行review代码.

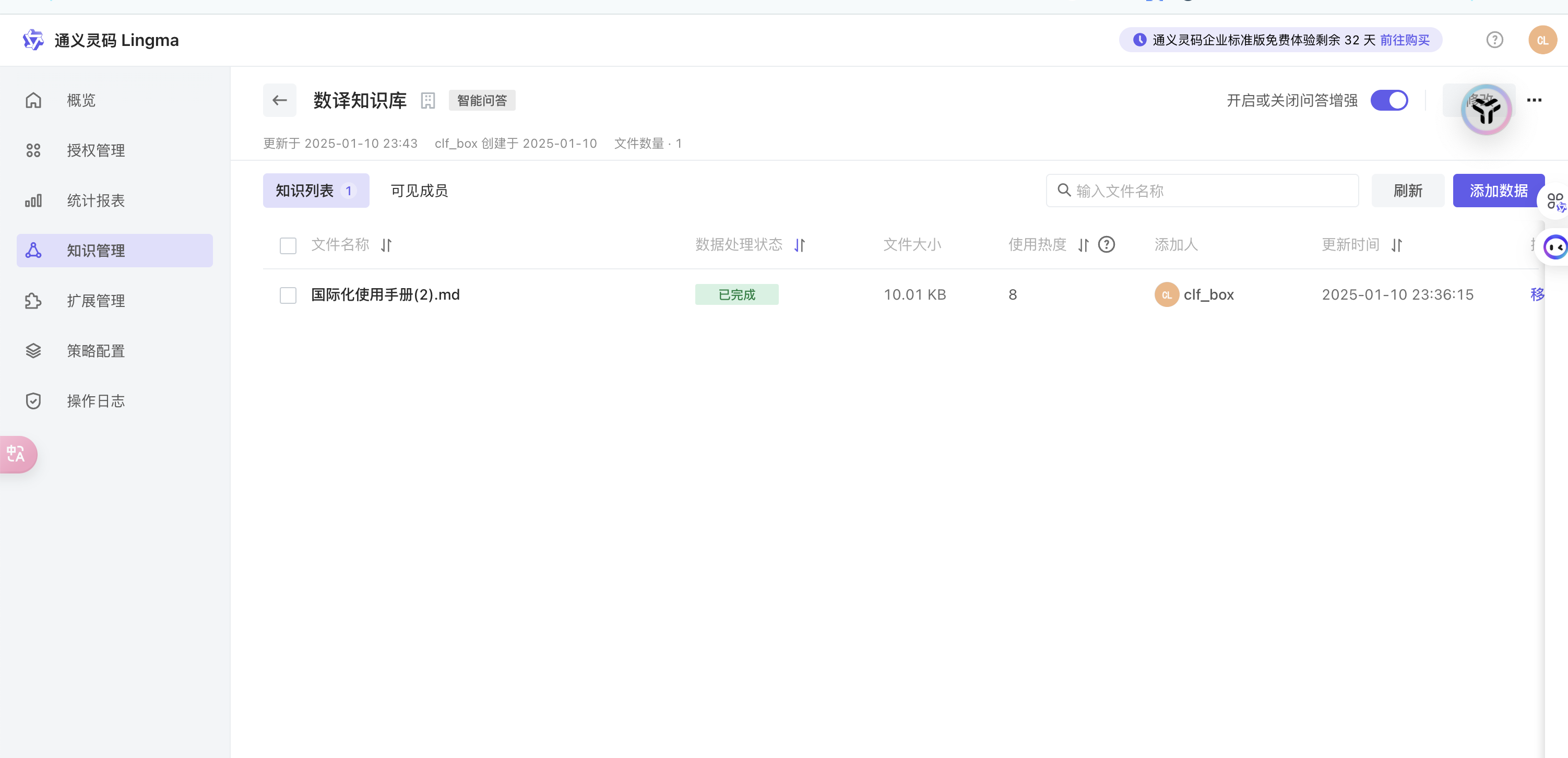

企业版账号

支持32天试用, 企业标准版可以适用构建自己的知识库, 方便内部的知识问答、工具包调用检索、代码规范等.

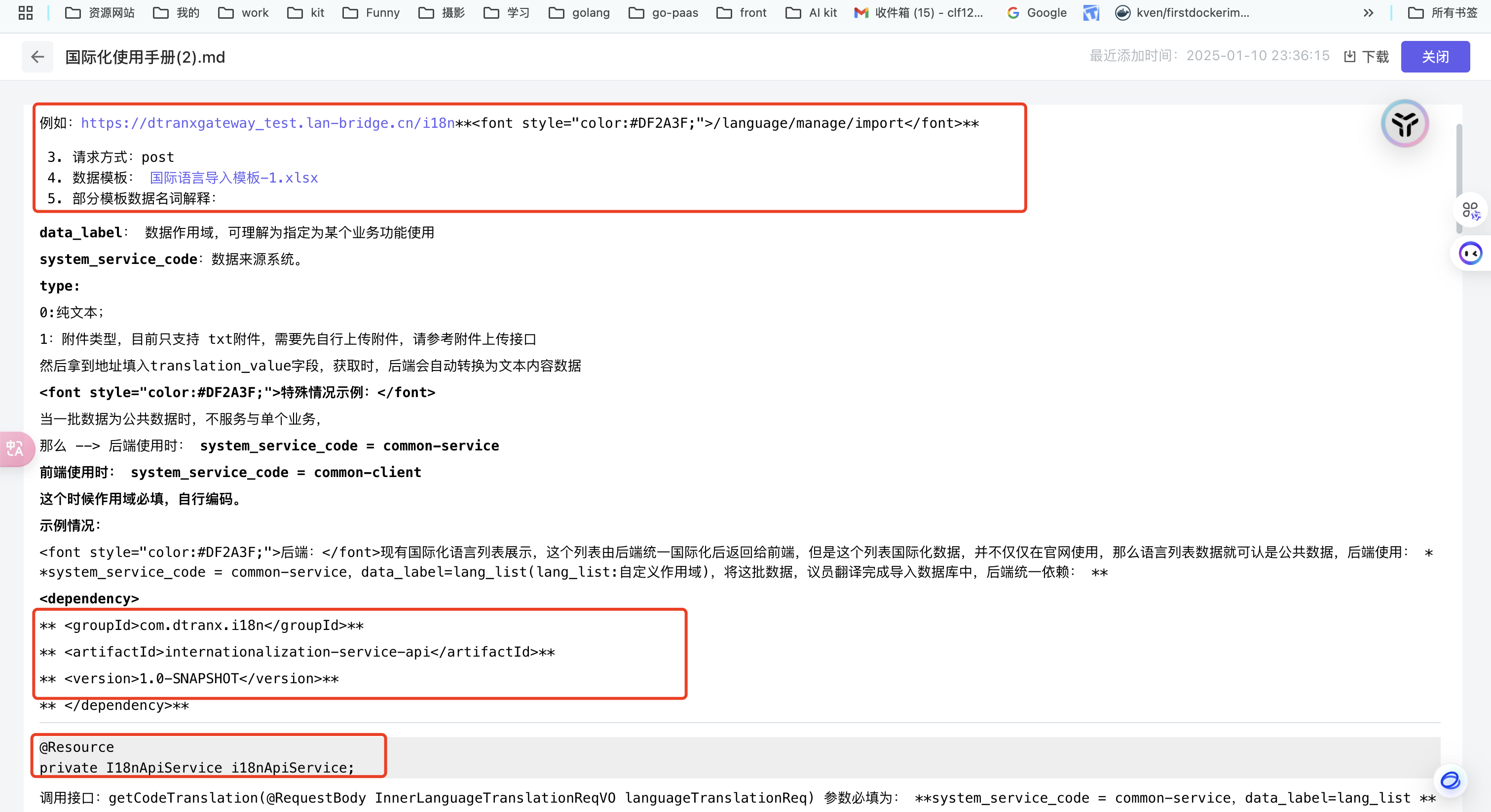

示例: 上传一份内部的国际化使用手册

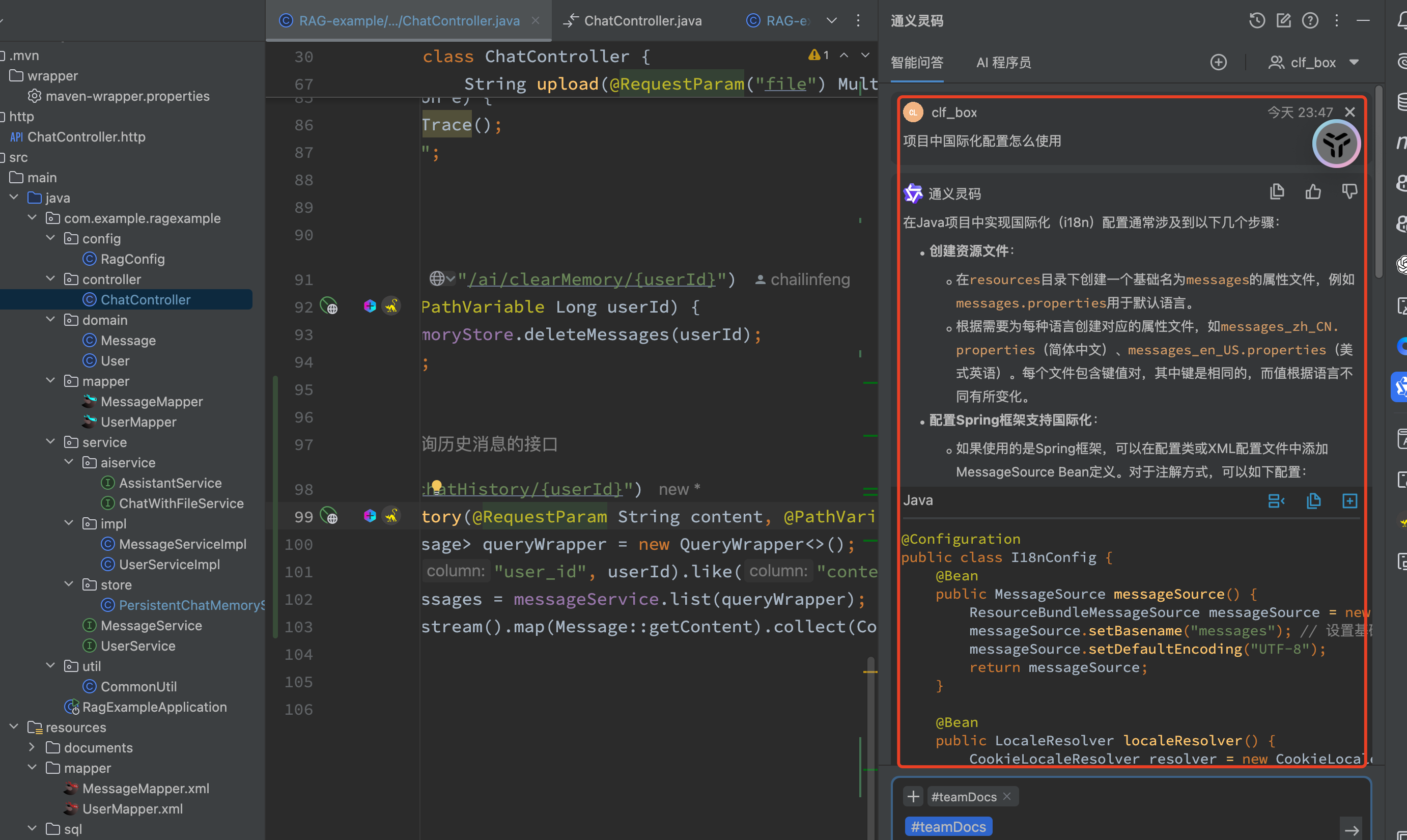

没有使用知识库效果, 最后给出的方案是通过自定义spring中的资源配置达到国际化处理的目的.

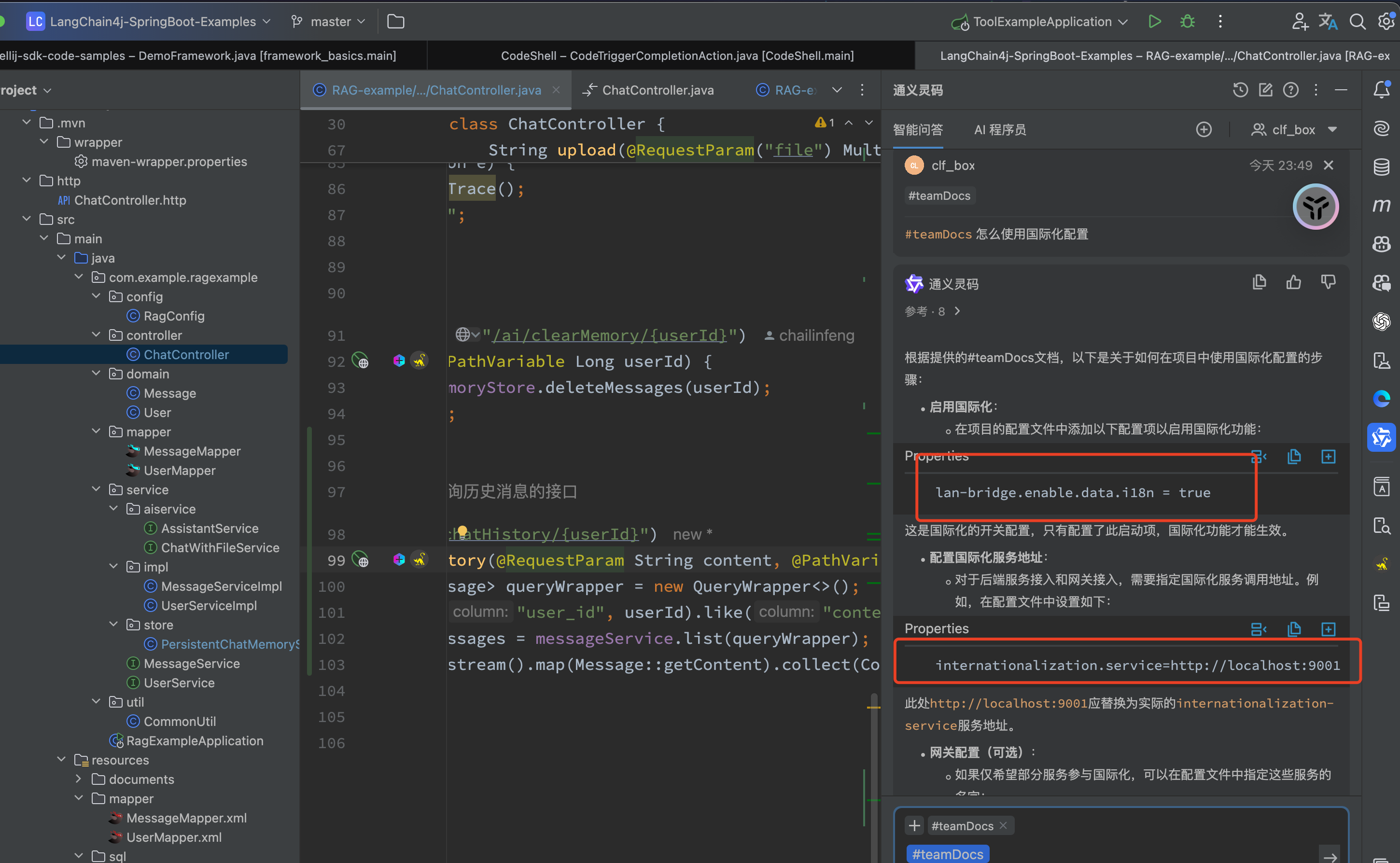

使用#teamDoc的方式, 通过RAG形式自动检索了知识库, 快速了解具体需要什么国际化配置.

可以通过添加自定义代码补全知识库来优化补全效果.

其他推荐插件

- copilot(免费次数限制)

- fitten(比较推荐, 最近升级之后代码补全的关联效果比较好)

- codeGPT(开源插件, 支持自定义模型)

3694

3694

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?