这个是因为Hive是依赖于HDFS和MapReduce相关进程的执行的,也就是说需要在启动Hive之前,应该把NameNode等一些节点进程进行开启

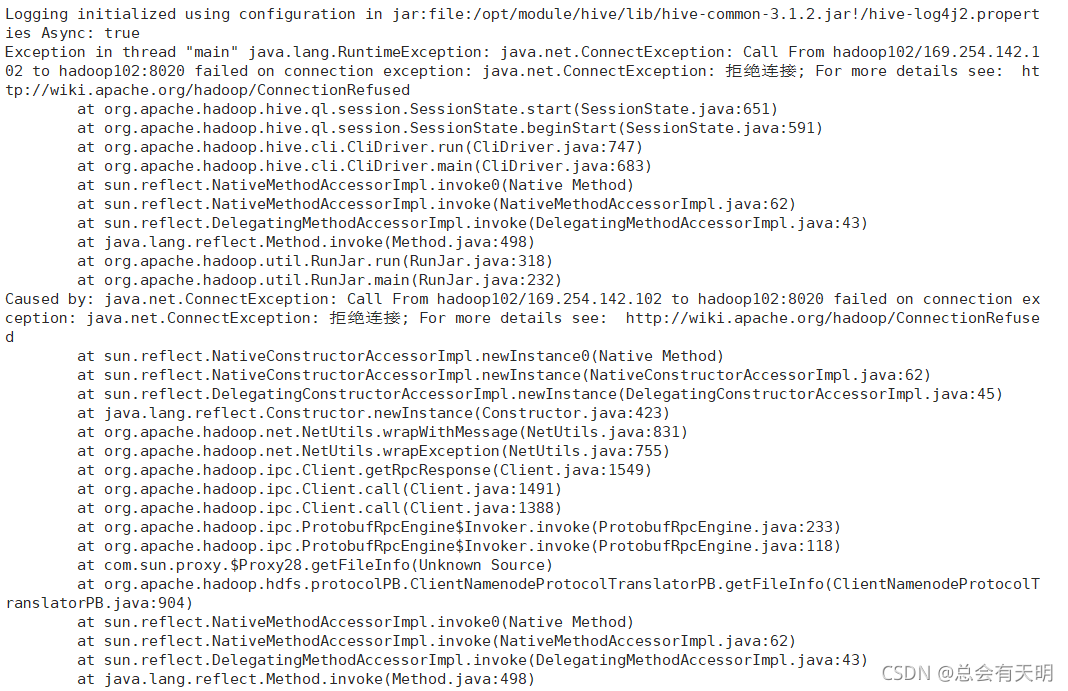

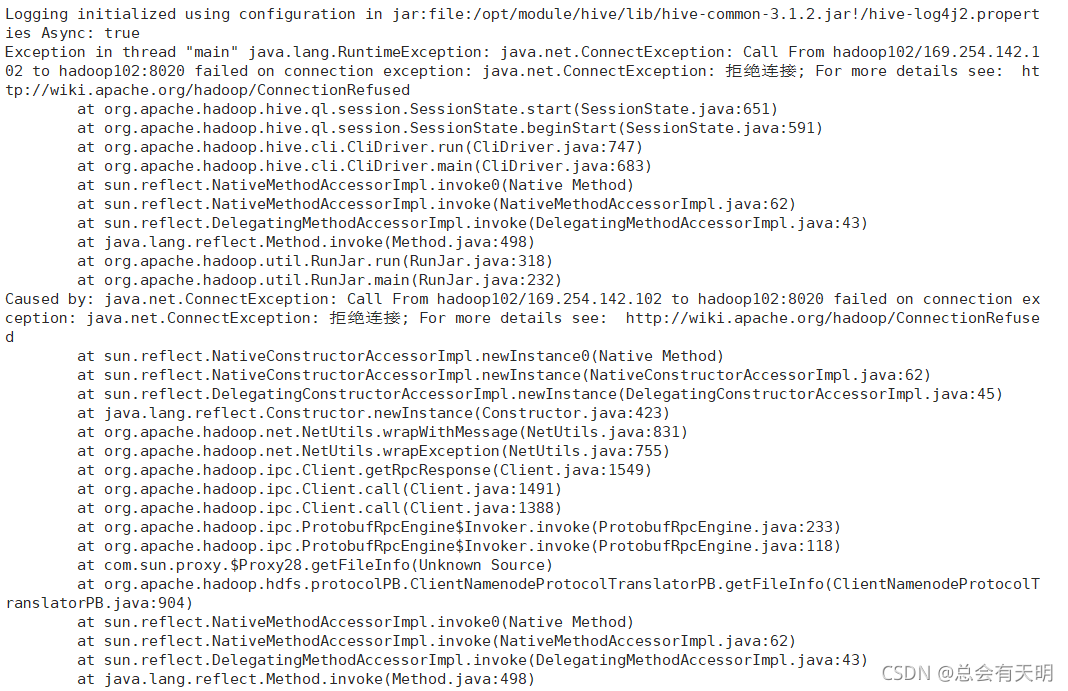

报错截图:

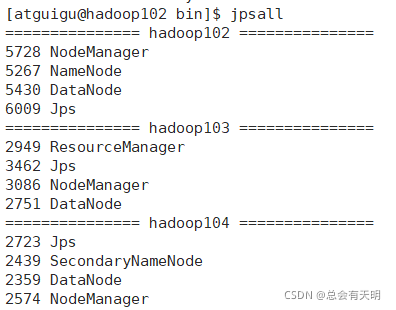

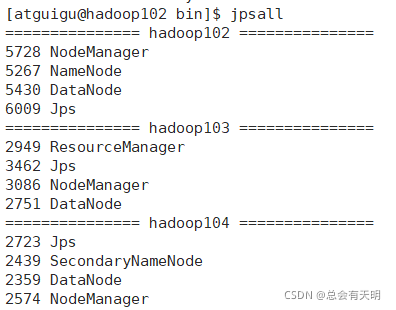

启动之后的节点进程

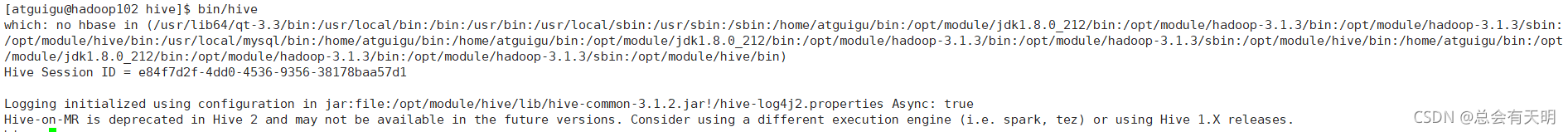

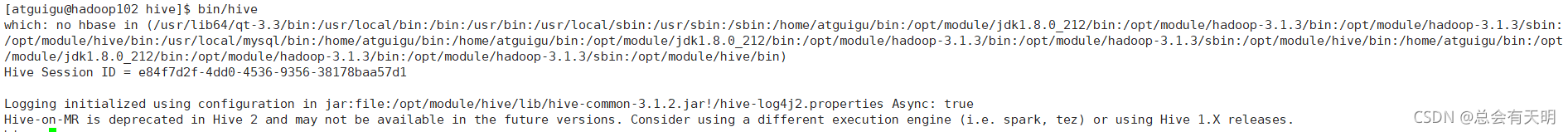

Hive启动成功

该博客介绍了Hive在启动前需要确保NameNode等HDFS和MapReduce相关节点已开启,以确保Hive能正常运行。在完成节点进程启动后,Hive成功启动。

该博客介绍了Hive在启动前需要确保NameNode等HDFS和MapReduce相关节点已开启,以确保Hive能正常运行。在完成节点进程启动后,Hive成功启动。

这个是因为Hive是依赖于HDFS和MapReduce相关进程的执行的,也就是说需要在启动Hive之前,应该把NameNode等一些节点进程进行开启

报错截图:

启动之后的节点进程

Hive启动成功

926

926

2087

2087

2022

2022

6万+

6万+

5001

5001

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?