在spark计算当中,我们日常有些简单需求,比如去重,比如有四列(appid、date、type、platform),我们只需要对appid,date进行去重,另外两列不关注。在spark中,distinct会对所有列执行去重操作,两行比较,只要有个一列有差异,就不算重复。

要解决,只对某几列进行去重,可以使用Top N 的思路,也就是先分组,分组后,我们只取row_num=1第一行就可以了。

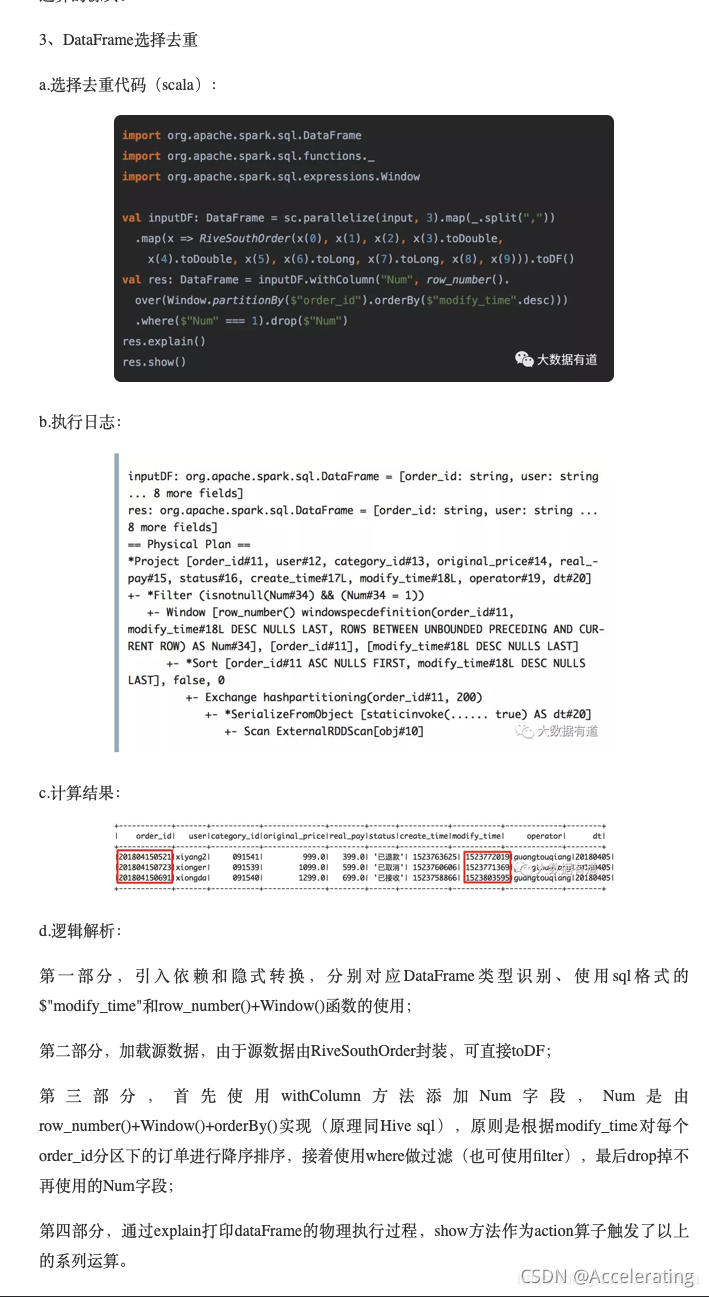

具体实现代码如下:

//选出某几列,去掉空值

Dataset dataset = input.select(

Consts.Fields.APPID,

Consts.Fields.EXTADID).na().drop(dropNulCol);dataset.persist();//设置窗口计算,可以指定多个列为partitionBy,其实就是多个groupby分组列WindowSpecw=Window.partitionBy(Consts.Fields.APPID).orderBy(col("count").desc());//只取rownum=1,那就是topN,如果window里有orderby排序的话。Dataset<Row>top=count.withColumn("rn",rownumber().over(w)).where(col("rn").ADID

).na().drop(dropNulCol);

dataset.persist();

//设置窗口计算,可以指定多个列为partitionBy,其实就是多个groupby 分组列

WindowSpec w=Window.partitionBy(Consts.Fields.APPID).orderBy(col("count").desc());

//只取row num=1,那就是top N,如果window里有orderby排序的话。

Dataset<Row> top = count.withColumn("rn",row_number().over(w)).where(col("rn").ADID).na().drop(dropNulCol);dataset.persist();//设置窗口计算,可以指定多个列为partitionBy,其实就是多个groupby分组列WindowSpecw=Window.partitionBy(Consts.Fields.APPID).orderBy(col("count").desc());//只取rownum=1,那就是topN,如果window里有orderby排序的话。Dataset<Row>top=count.withColumn("rn",rownumber().over(w)).where(col("rn").eqeqeqeqeq(1)).drop(“rn”);

在Spark中,当需要对特定列进行去重操作时,可以使用TopN的思路来实现。例如,针对appid和date两列去重,可以先选择这两列并去除空值,然后设置窗口函数按照appid分组并按某个排序标准(如出现次数)降序排列。通过row_number()函数获取每组内的第一行(即row_num=1),从而达到去重目的。这种方法避免了distinct对所有列的全局去重,提高了处理效率。

在Spark中,当需要对特定列进行去重操作时,可以使用TopN的思路来实现。例如,针对appid和date两列去重,可以先选择这两列并去除空值,然后设置窗口函数按照appid分组并按某个排序标准(如出现次数)降序排列。通过row_number()函数获取每组内的第一行(即row_num=1),从而达到去重目的。这种方法避免了distinct对所有列的全局去重,提高了处理效率。

2999

2999

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?