注意,本文只提供学习的思路,严禁违反法律以及破坏信息系统等行为,本文只提供思路

如有侵犯,请联系作者下架

本文识别已同步上线至OCR识别网站: http://yxlocr.nat300.top/ocr/other/15

亚马逊的滑动还原验证码数据集如下:

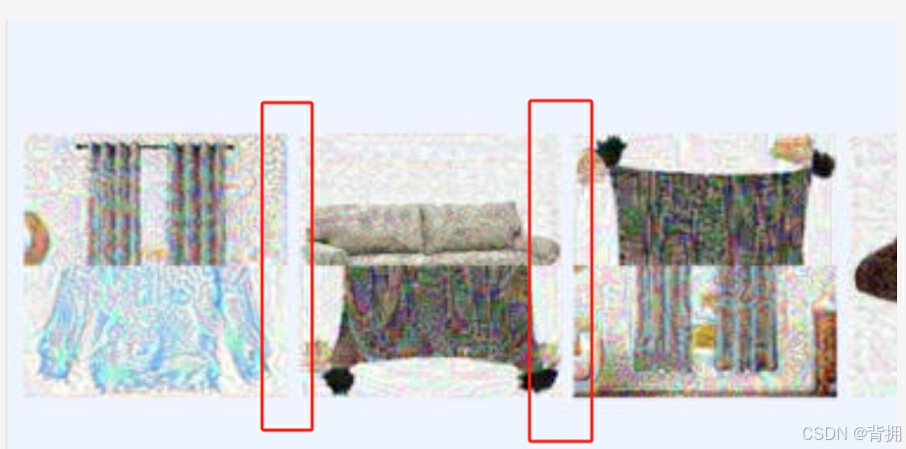

和某顶象的差不多,图片分割高度是中间固定的,需要注意的是,他并不是把五副图像还原就行,它需要根据题目,还原指定的物品种类,那么这里必然还是要训练分类模型,这里我们只采集上半张图,由于每张物品种类是有明显的分割间隙的,也就是白色区域的图案,放大如下

那么我们即可利用这个特性,将图案分割下来,并且,我们已知所有图像的种类,我们人工筛选种类部分数据集即可

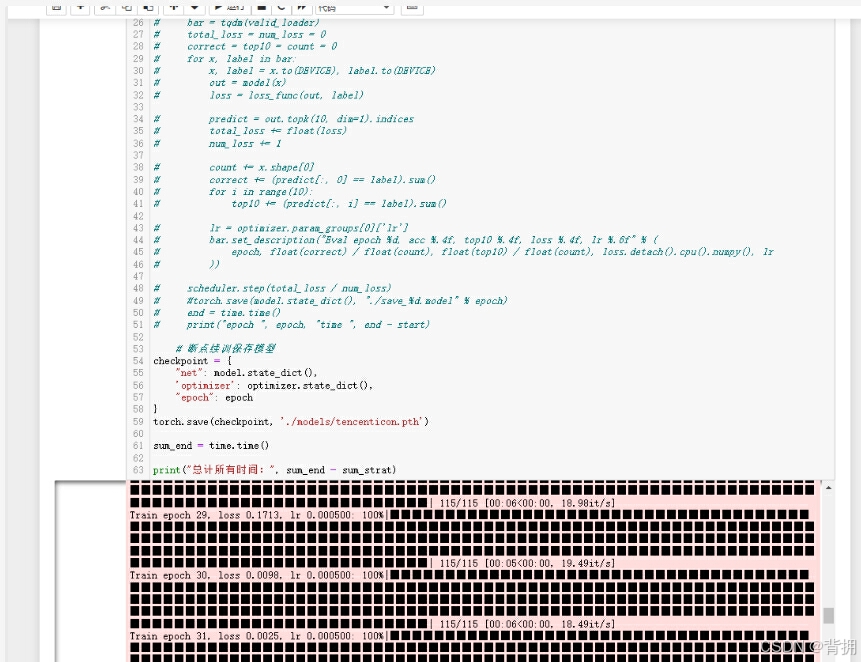

将种类筛选完成后,由于种类较少,使用resnet18训练即可,大概训练50个epoch左右即可

随后导出成onnx模型,为下一步做准备,由于分割的高度是固定的160,我们在计算分割每个物品后,需要将分割位置坐标计算出来

# 合并宽度大于200的分割线

merged_lines = []

i = 0

while i < len(vertical_lines):

start = vertical_lines[i]

while i + 1 < len(vertical_lines) and vertical_lines[i + 1] - vertical_lines[i] == 1:

i += 1

end = vertical_lines[i]

if end - start + 1 > 4:

merged_lines.append((start, end))

i += 1

输出

[(0, 28), (140, 147), (255, 270), (373, 377), (484, 504), (595, 639)]

将每个位置,例如28-140的宽度图片,逐一分类识别,与问题的种类对应后,只需要计算28-140上下像素的距离差即可,这里的距离差计算与之前的顶象滑动还原距离计算一模一样,将距离差最小的x移动距离算出来后,再次拼接即可得到完整的图片,具体可以去网站操作尝试,最后实测下来准确率可达95

1957

1957

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?